В начале 2026 года рынок AI-видеогенерации пережил настоящий тектонический сдвиг. То, что раньше было пространством экспериментальных инструментов, выдающих размытые ролики с артефактами, превратилось в жесткую конкурентную арену, где лидерство удерживают три модели: Happy Horse 1.0, Kling 3.0 и SkyReels V4. Каждая из них представляет собственную архитектурную философию, и каждая сильна в тех производственных сценариях, которые действительно важны для создателей контента, маркетологов и кинематографистов. В этом материале подробно разобраны их техническая основа, реальная производительность и практические области применения, чтобы помочь выбрать правильную модель под ваш workflow.

Новый ориентир: что изменилось в 2026 году

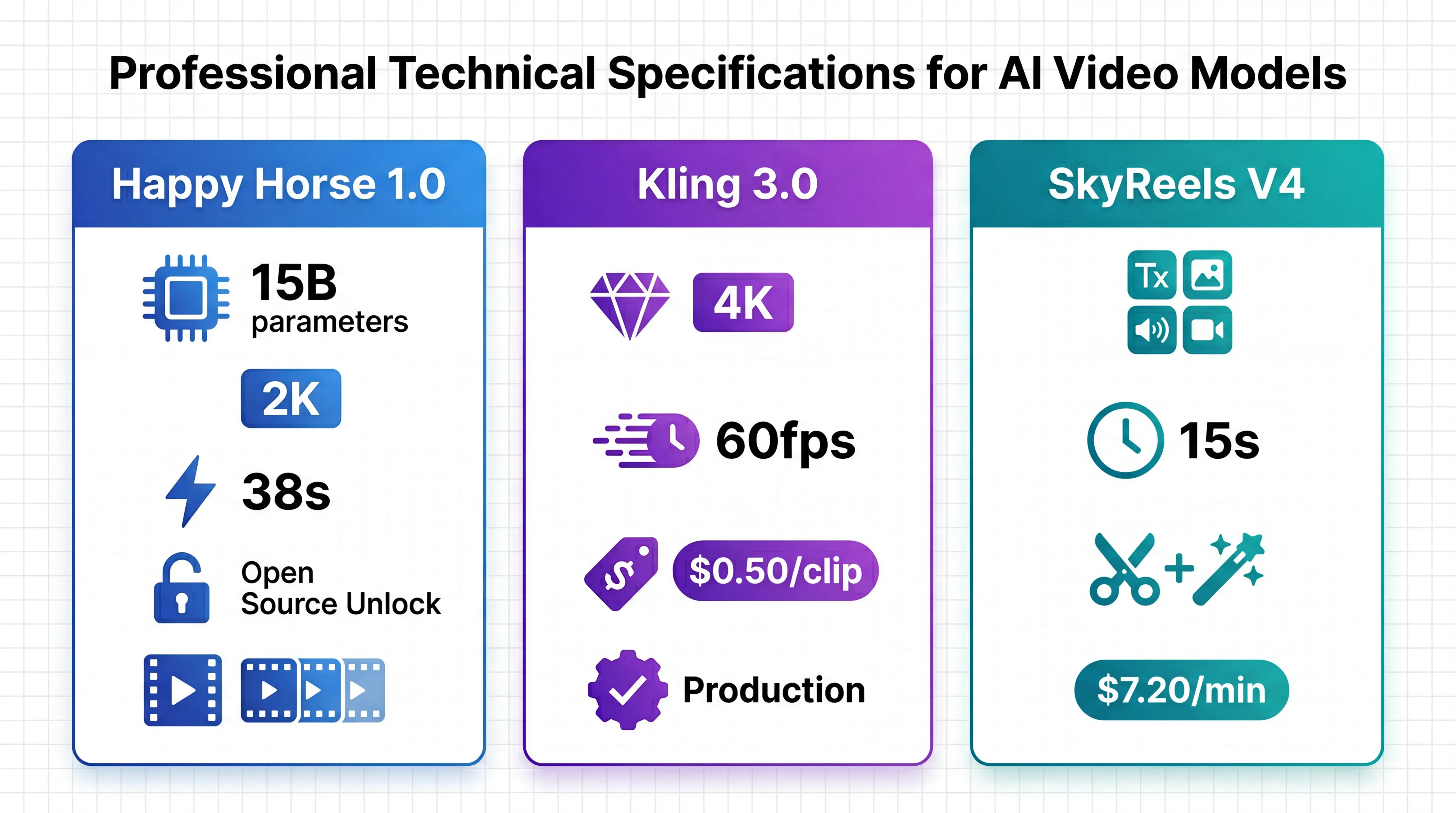

AI-видеогенерация в начале 2026 года перешла важный порог. Нативная совместная генерация аудио и видео, которая еще двенадцать месяцев назад существовала только в исследовательских публикациях, стала рабочей production-функцией у всех трех моделей. Существенно выросли и возможности по разрешению. Kling 3.0 уже выдает native 4K при 60fps, а Happy Horse 1.0 способен генерировать видео кинематографического качества в 2K примерно за 38 секунд на H100. Benchmark по качеству движения тоже стал гораздо более плотным: независимые оценщики дают Seedance 2.0 оценку 9,2 из 10 за реализм движения, а Kling 3.0 идет следом с 9,0.

Конкурентная динамика тоже изменилась фундаментально. Happy Horse 1.0 анонимно появился в Artificial Analysis Video Arena в начале апреля 2026 года и очень быстро поднялся на первое место с Elo 1 361 в категории text-to-video без аудио, обогнав Seedance 2.0 и Kling 3.0. Такая слепая оценка, где пользователи голосуют, не зная, какая модель сгенерировала результат, сегодня является самым объективным сигналом качества. То, что Happy Horse 1.0 последовательно обходит Kling 3.0 и SkyReels V4 в таких сравнениях, говорит о реальных архитектурных преимуществах, а не о маркетинговом эффекте.

Happy Horse 1.0: open-source-дестабилизатор рынка

Happy Horse 1.0 — это первый действительно серьезный вызов доминированию закрытых моделей в AI-видеогенерации. Он построен на единой Transformer-архитектуре с 15 миллиардами параметров и 40 слоями self-attention и нативно обрабатывает текст, изображения, видео и аудио в рамках одного прохода. Такой архитектурный выбор устраняет артефакты синхронизации, которые обычно возникают в многостадийных конвейерах, где видео и аудио создаются по отдельности и сводятся уже после.

Техническая архитектура и производительность

Модель использует DMD-2 distillation — технику, сокращающую denoising-процесс до восьми шагов без classifier-free guidance. Это дает впечатляющую скорость инференса: около двух секунд для пятисекундного клипа в 256p и примерно 38 секунд для полного 1080p на H100. В прямом сравнении Happy Horse 1.0 генерирует 2K-видео на 30 процентов быстрее Seedance 1.5 Pro и на 29 процентов быстрее Kling 2.1.

Особого внимания заслуживает архитектура Dual-Branch DiT. Одна ветка отвечает за визуальный синтез, другая — за аудио, временно согласованное с видео, при этом обе используют общий текстовый энкодер. Благодаря этому модель умеет удерживать идентичность персонажа на протяжении нескольких сцен. Именно это отличает ее от single-shot-генераторов вроде Sora, Runway или стандартных реализаций Kling. Если задать Happy Horse 1.0 повествовательный prompt, он будет создавать связные последовательности сцен, а не набор разрозненных клипов, тем самым существенно снижая объем ручного монтажа.

Мультиязычный lip-sync и аудиовозможности

Happy Horse 1.0 поддерживает native joint audio-video generation на семи языках: китайском, английском, японском, корейском, немецком, французском и кантонском. В документации это описывается как ultra-low WER lip-sync. WER — это Word Error Rate, метрика из области распознавания речи, описывающая точность соответствия движений губ произносимым фонемам. Хотя независимая количественная верификация этих утверждений еще впереди, открытые кейсы на Artificial Analysis по английскому и китайскому уже демонстрируют очень убедительную синхронизацию.

Аудиогенерация включает не только речь, но и атмосферные звуки и Foley-эффекты. Если генерировать сцену дождя на городской улице, модель создаст не только капли, мокрый асфальт и отражения, но и всю звуковую среду: шум дождя, далекий транспорт и нюансы того, как вода звучит на разных поверхностях. Такой уровень аудио-визуальной интеграции фактически убирает целый шаг постпродакшена, который раньше требовал отдельного sound design pipeline.

Преимущество открытого кода и текущие ограничения

Happy Horse 1.0 поставляется как полностью открытый пакет, включающий базовую модель, дистиллированную модель, модуль super-resolution и полный inference code. Такой формат лицензирования позволяет self-hosting и fine-tuning для кастомных сценариев, что особенно важно для компаний с жесткими бренд-гайдлайнами, собственным визуальным стилем или требованиями к суверенитету данных. На Artificial Analysis Video Arena модель обходит Seedance 2.0, Ovi 1.1 и LTX 2.3 и становится самым качественным open-weights-вариантом на середину апреля 2026 года.

Но между benchmark-результатом и production-доступностью остается критический разрыв. По состоянию на 18 апреля 2026 года публичной API у Happy Horse 1.0 еще нет. Официальная команда объявила в социальных сетях, что API access появится 30 апреля 2026 года, и одновременно предупредила о множестве мошеннических сайтов, уже выдающих себя за официальный доступ. Это означает, что модель номер один в глобальном рейтинге на тот момент все еще остается недоступной для production-workflow, а для команд, которые прямо сейчас оценивают свою инфраструктуру генерации видео, создает вполне реальную стратегическую дилемму.

Kling 3.0: эталон уровня production

Kling 3.0 от Kuaishou закрепился как production-grade-стандарт в AI-видео благодаря двум месяцам живой API, подробной документации и устойчивому качеству при масштабировании. Модель опирается на архитектуру Visual Chain-of-Thought, которая разбивает сложные prompts на последовательные шаги рассуждения и позволяет точнее интерпретировать сцены с множеством объектов, заданной камерой, светом и взаимодействием персонажей.

Нативный 4K-вывод и качество движения

Самая заметная особенность Kling 3.0 — native 4K output при 60 кадрах в секунду. На февраль 2026 года это было самое высокое native-разрешение среди основных AI-видеомоделей. Речь не идет о 1080p с последующим апскейлом: это полноценный рендер в 3840x2160, без размытия и артефактов, характерных для постобработочного upscale. Частота 60fps также убирает AI-stutter ранних моделей на 24fps и 30fps, из-за чего Kling 3.0 особенно хорош в быстрых action-сценах, спортивном контенте и профессиональных product demo, где чистота движения напрямую влияет на восприятие качества.

Независимые benchmark’и стабильно относят Kling 3.0 к лидерам по motion quality. Профессиональные видеографы называют его одним из самых способных general-purpose video model на текущий момент и state of the art с точки зрения естественного движения и физической симуляции. Особенно хорошо модель ведет себя там, где нужна правдоподобная физика: столкновения объектов, текущие жидкости, реакция ткани на ветер, то есть в тех областях, где предыдущие поколения часто выглядели неубедительно.

Экономика и масштабируемость производства

При цене около 0,50 доллара за клип Kling 3.0 является одним из самых cost-effective вариантов среди топовых моделей для производства в больших объемах. Через API-провайдеров вроде ModelsLab стоимость составляет примерно 0,12–0,15 доллара за секунду сгенерированного видео, то есть пятисекундный ролик обходится примерно в 0,60–0,75 доллара. Для пользователей с высоким объемом доступны bulk-тарифы, что делает Kling 3.0 особенно привлекательным для маркетинговых агентств, социальных команд и e-commerce-платформ, которым каждый месяц нужны десятки и сотни product video.

Пользовательские отчеты показывают генерацию от двух до пятнадцати минут в зависимости от сложности prompt’а и текущей серверной нагрузки. Это заметно медленнее, чем заявленные 38 секунд Happy Horse 1.0 для 1080p, но в batch-workflow эта разница менее критична, потому что ролики часто запускаются параллельно. На практике API-стабильность и предсказуемая ценовая модель уже превратили Kling 3.0 в инфраструктуру для многих production-сценариев.

Motion Control и продвинутые возможности

Kling 3.0 также предлагает функцию Motion Control, которая заслуживает отдельного внимания. Пользователь может загрузить reference video, извлечь из него шаблон движения и применить этот паттерн к совершенно другому объекту или сцене. Например, можно записать конкретный dolly movement в физическом пространстве и перенести его на AI-сгенерированный фэнтезийный пейзаж. Эта возможность связывает традиционную кинематографию и генеративное видео, позволяя режиссерам сохранять точный творческий контроль над работой камеры и одновременно использовать AI для создания визуального контента.

Вариант Kling 3.0 Omni расширяет базовую модель дополнительными multimodal-возможностями, включая voice cloning. Пользователи могут заранее привязать конкретный голос к персонажу, а затем сохранить его через несколько сцен. Для narrative content, branded character и обучающих серий это особенно ценно, потому что голосовая консистентность заметно улучшает понимание и вовлеченность аудитории.

SkyReels V4: единая мультимодальная основа

SkyReels V4 от Kunlun представляет принципиально иной архитектурный подход. Вместо того чтобы максимально оптимизировать один проход генерации, модель использует dual-stream Multimodal Diffusion Transformer. Один поток синтезирует видео, другой — временно согласованный аудиосигнал, а оба используют общий мощный текстовый энкодер на базе multimodal large language models. Благодаря этому SkyReels V4 принимает самый богатый набор multimodal instructions среди трех моделей: текст, изображения, видеофрагменты, маски и аудио-референсы можно комбинировать произвольно, добиваясь точного контроля над сценой, персонажем и звуковой атмосферой.

Единая генерация, inpainting и редактирование

Главная особенность SkyReels V4 — это единый подход к generation, inpainting и editing внутри одной архитектуры. Модель использует channel-concatenation formulation, которая позволяет под одной и той же оболочкой решать image-to-video conversion, video extension и surgical video editing. Это означает, что можно сначала сгенерировать базовую сцену, а затем с помощью mask-based inpainting заменить отдельные элементы: одежду героя, фон, watermark, не перегенерируя весь ролик целиком.

Практическое значение этого очень велико. Традиционные workflows обычно требуют одного инструмента для генерации и другого для редактирования. Сначала вы генерируете, затем экспортируете, потом редактируете в другой программе и надеетесь, что визуальная целостность сохранится. SkyReels V4 выполняет все это в пределах одного latent space, что дает более высокую визуальную согласованность и избегает format-conversion artifacts.

Разрешение, длительность и стратегия эффективности

SkyReels V4 поддерживает до 1080p, 32fps и 15 секунд длительности — это самый длинный single-generation-формат среди трех рассматриваемых моделей. Чтобы сделать длинную высокодетализированную генерацию реализуемой на текущем железе, модель применяет умную efficiency strategy: одновременно генерирует полную последовательность в низком разрешении и high-resolution keyframes, а затем использует отдельные модели super-resolution и frame interpolation для получения финального результата.

Этот keyframe-plus-superresolution-подход добавляет дополнительные шаги по сравнению с прямой генерацией, а значит, увеличивает общее время обработки. Однако он позволяет удерживать temporal consistency на более длинных отрезках, чем это было бы возможно при direct 1080p generation в рамках текущих hardware limitations. Для narrative content, explainers и tutorial sequences, где важны более длинные непрерывные куски, такой trade-off вполне оправдан.

Позиция в leaderboards и доступность

Сразу после релиза в марте 2026 года SkyReels V4 поднялся на второе место в Artificial Analysis Global Text-to-Video with Audio Leaderboard, что подтвердило его конкурентоспособное качество. В text-to-video without audio SkyReels V4 набирает Elo 1 244 — всего на один пункт выше, чем Kling 3.0 Pro с 1 243. Такая почти полная близость означает, что различия в качестве у топовых моделей уже настолько малы, что workflow integration, pricing и конкретный feature fit становятся первичными факторами выбора.

SkyReels V4 доступен через API-провайдеров по цене около 7,20 доллара за минуту сгенерированного видео. Это ставит его между PixVerse V6 с 5,40 доллара за минуту и Kling 3.0 Pro с 13,44 доллара за минуту. Такая ценовая позиция дает ему то, что сразу несколько независимых оценщиков на апрель 2026 года прямо называют лучшим соотношением качества и цены среди действительно доступных моделей.

Прямое сравнение: технические характеристики

| Спецификация | Happy Horse 1.0 | Kling 3.0 | SkyReels V4 |

|---|---|---|---|

| Архитектура | Unified Transformer на 15B параметров, 40 слоев self-attention, Dual-Branch DiT | Visual Chain-of-Thought, diffusion-based pipeline | Dual-stream Multimodal Diffusion Transformer (MMDiT) |

| Разрешение | До 2K (native 1080p) | Native 4K (3840x2160) | До 1080p |

| Частота кадров | Стандартный режим (имплицитно около 30fps) | 60fps | 32fps |

| Максимальная длительность | Multi-shot sequences | 10–15 секунд на клип | 15 секунд |

| Генерация аудио | Native joint synthesis, 7 языков | Native audio с voice cloning | Native joint synthesis |

| Скорость инференса | ~38 с для 1080p (H100) | 2–15 минут (зависит от нагрузки) | Дольше (подход keyframe + SR) |

| Доступность API | Ожидается 30 апреля 2026 | Доступна с февраля 2026 | Доступна с марта 2026 |

| Цена | TBD | ~0,50 $/clip, 0,12–0,15 $/секунда | ~7,20 $/минута |

| Open source | Да (полная модель + код) | Нет | Частично (статус weights неясен) |

| Elo (T2V без аудио) | 1 361 | 1 247 | 1 244 |

Рекомендации по сценариям: какую модель выбрать под ваш рабочий процесс

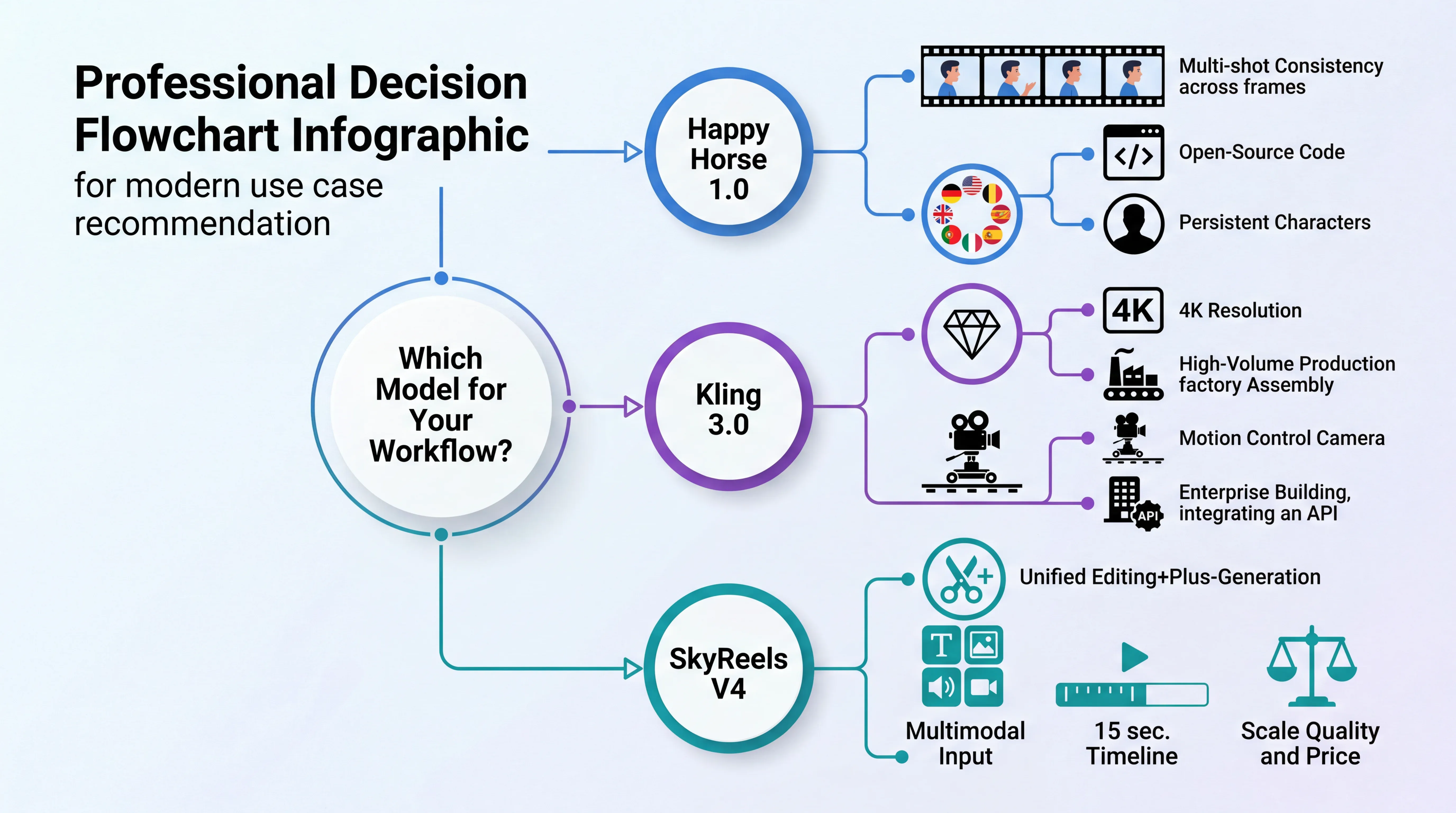

Выбирайте Happy Horse 1.0, если вам нужно

Нарративный multi-shot content с устойчивыми персонажами. Способность Happy Horse 1.0 удерживать character identity между сменой сцен делает его особенно подходящим для короткометражек, брендового сторителлинга и образовательных серий, где визуальная непрерывность важнее максимального разрешения. Native multi-shot generation сокращает объем ручного монтажа.

Self-hosted infrastructure с полным контролем над моделью. Компаниям с требованиями к sovereignty of data, нуждой в fine-tuning под свой визуальный стиль или с on-premise processing workflow open-source-подход Happy Horse 1.0 дает особенно многое. Возможность изменять архитектуру и процесс обучения недоступна в API-only-сервисах.

Мультиязычный контент с синхронизированным диалогом. Поддержка lip-sync на семи языках делает Happy Horse 1.0 сильнейшим вариантом для международных creators, language-learning apps и глобальных кампаний, где корректная синхронизация губ на разных языках снижает стоимость локализации.

Готовность подождать API. Если production timeline может выйти за пределы 30 апреля 2026 года и вы можете дождаться официального API, лидерское качество Happy Horse 1.0 эту задержку оправдывает. Для немедленных production needs более практичны Kling 3.0 или SkyReels V4.

Выбирайте Kling 3.0, если вам нужно

Максимальное разрешение и чистота движения. Когда 4K при 60fps является жестким требованием — для product demo, high-end advertising, короткометражек фестивального уровня или любого контента, где visual fidelity напрямую влияет на ценность бренда — преимущество native resolution у Kling 3.0 важнее всего остального.

High-volume production at scale. Маркетинговые агентства, ежедневно выпускающие множество social clips, e-commerce-платформы, создающие тысячи product videos, и content studios с регулярными сериями выигрывают от cost efficiency, API stability и batch processing в Kling 3.0. Цена в районе 0,50 доллара за клип делает масштабное производство экономически оправданным.

Точный motion control и кинематографическая управляемость. Режиссеры и операторы, которым нужно применять определенные camera movement, удерживать сигнатуру движения между шотами или интегрировать AI-сгенерированный контент с традиционно снятым материалом, особенно оценят Motion Control в Kling 3.0. Эта функция связывает профессиональный filmmaking и AI generation гораздо плотнее, чем конкуренты.

Проверенная production infrastructure. Командам, которые создают customer-facing applications, SaaS с встроенной видеогенерацией или automated content pipelines, нужна именно та эксплуатационная надежность, которую дает API, уже несколько месяцев работающий вживую, полная документация и multiple provider options. Kling 3.0 уже работает как инфраструктура там, где Happy Horse 1.0 и SkyReels V4 еще догоняют этот уровень зрелости.

Выбирайте SkyReels V4, если вам нужно

Единый workflow генерации и редактирования. Создатели контента, которым приходится часто дорабатывать сгенерированные ролики — менять фон, одежду, удалять лишние элементы или продлевать сцену, — получают огромную выгоду от встроенных inpainting и editing-возможностей SkyReels V4. Изменения происходят в том же latent space, что и исходная генерация, поэтому визуальная консистентность сохраняется лучше, чем при внешнем монтаже.

Сложный multimodal conditioning. Проекты, которым нужно точно управлять сценой через сочетание текстовых описаний, reference images, video clips, masks и audio guidance, могут полноценно использовать SkyReels V4. Это особенно важно для branded content с жесткими визуальными требованиями, narrative-сценариев с конкретными персонажами и технических демонстраций, где композиция должна быть задана очень точно.

Более длинные непрерывные планы. Максимум в 15 секунд делает SkyReels V4 самым сильным выбором для explainers, tutorial content, narrative scenes с длинным тейком и любых задач, где слишком частые склейки разрушают восприятие или эмоцию.

Лучшее соотношение quality-to-price среди доступных вариантов. Для команд, которые оценивают стоимость всей pipeline, включая generation, editing и multiple iterations, цена 7,20 доллара за минуту в сочетании с встроенным editing часто делает SkyReels V4 выгоднее, чем сервисы, у которых дешевая генерация, но дорогое продолжение работы вне платформы.

Сравнение по производительности: качество движения и физическая симуляция

Независимые тесты в реальных production-workflow показывают тонкие различия, которые в конкретных сценариях важнее aggregated Elo score. По данным оценок февраля 2026 года, Seedance 2.0 набирает 9,2 из 10 за реализм движения, а Kling 3.0 — 9,0. Seedance особенно силен в cinematic motion smoothing, то есть в тех тонких кривых ускорения и замедления, которые делают движение камеры профессиональным. Kling 3.0 лидирует в natural physics simulation — прежде всего там, где важны гравитация, импульс и поведение материалов вроде ткани или жидкости.

Качество движения Happy Horse 1.0 было фактически подтверждено blind arena comparison, в которых пользователи последовательно ставили его выше Kling 3.0 и Seedance 2.0, не зная происхождения роликов. Это позволяет предположить, что Happy Horse 1.0 достигает motion quality, которая может даже превосходить уровень 9,0–9,2, хотя формальная числовая верификация от независимых лабораторий пока отсутствует.

SkyReels V4 также уверенно держится в этой верхней группе. Его Elo 1 244 — всего на один пункт выше Kling 3.0 Pro. На этом уровне отличия уже не проявляются в грубых ошибках, потому что все три модели умеют избегать тех типичных проблем ранних поколений, как morphing objects, drifting faces и явные нарушения физики. Оставшиеся различия становятся очень тонкими: насколько естественно персонаж переносит вес при повороте, как правдоподобно вода ловит свет, как ткань реагирует на движение тела. Для high-end commercial work это крайне важно, хотя в social media на мобильных устройствах заметно не всегда.

Платформенное преимущество Happy Horse

Хотя это сравнение в основном сосредоточено на самой модели Happy Horse 1.0, важно отметить и платформенный подход Happy Horse, потому что он решает одну из самых практических проблем AI-видеопроизводства: fragmentation of tools. Вместо отдельных подписок на Kling для 4K, Seedance для motion quality и SkyReels для editing, Happy Horse объединяет несколько ведущих моделей внутри единого workflow environment. Это дает сразу несколько очень практичных плюсов.

Во-первых, резко уменьшается cognitive overhead, связанный с изучением разных интерфейсов, синтаксисов prompt’ов и параметрических систем. Creator может прогнать один и тот же prompt через Happy Horse 1.0, Kling 3.0 и SkyReels V4, не переключаясь между платформами, а значит быстрее итерировать и напрямую сравнивать качество результатов. Во-вторых, упрощается billing и budget management: одна подписка, один счет и более предсказуемая структура затрат вместо разрозненного потребления на разных сервисах. В-третьих, становится легче сопоставлять модель и задачу: Kling 3.0 — для hero shot с максимальным разрешением, Happy Horse 1.0 — для narrative sequence с continuity, SkyReels V4 — для scenes, где требуется surgical editing.

Такой platform approach отражает более широкую тенденцию отрасли — агрегацию AI-моделей. Точно так же, как ни одна language model не доминирует во всех текстовых задачах, ни одна video model не будет оптимальной для каждого creative challenge. Будущее профессиональной AI-видеопроизводства, скорее всего, за intelligent model routing, где система автоматически выбирает или рекомендует лучший вариант на основе анализа prompt’а, бюджета и требований к качеству. Happy Horse благодаря интегрированной платформе находится здесь в сильной позиции.

Ограничения и важные оговорки для всех моделей

Несмотря на впечатляющий прогресс начала 2026 года, все три модели разделяют ряд общих ограничений, которые важно понимать до того, как строить на них production workflow. Физическая симуляция в сложных сценах, включая огонь, взаимодействующие потоки воды и разрывающуюся ткань, все еще может срываться в визуально неправдоподобные результаты. Многоперсонажные взаимодействия, особенно если три и более героя координированно действуют в одном кадре, по-прежнему могут порождать артефакты вроде неправильного пересечения конечностей и путаницы в пространственных отношениях.

Кросс-видеоконсистентность персонажей тоже остается нерешенной задачей. Happy Horse 1.0 умеет удерживать character identity внутри одной multi-shot-generation, а SkyReels V4 может опираться на reference image для внешности, но ни одна модель пока не воспроизводит одного и того же персонажа стабильно в полностью независимых генерациях без аккуратного prompt engineering и управления reference-материалами. Для сериалов, recurring branded character и кампаний с постоянным cast это остается серьезным практическим ограничением.

Отдельного внимания заслуживает и copyright landscape. В марте 2026 года Верховный суд США отказался рассматривать апелляцию по делу Thaler v. Perlmutter, фактически оставив в силе позицию, согласно которой purely AI-generated content не получает copyright protection. Это означает, что такие видео можно легально копировать и использовать, а претендовать на полноценное исключительное авторское право крайне сложно. Для бизнес-моделей, завязанных на эксклюзивность контента, это стратегический риск, который приходится компенсировать человеческим творческим вкладом, существенной post-production modification или альтернативными правовыми механизмами вроде trademark и trade dress.

Заключение: будущее AI-видеопроизводства — это multi-model

Конкуренция между Happy Horse 1.0, Kling 3.0 и SkyReels V4 показывает созревающий рынок, где различия в качестве сузились настолько, что workflow integration, feature fit и cost structure часто значат больше, чем сами benchmark-рейтинги. Happy Horse 1.0 лидирует в blind evaluation и предлагает уникальную open-source-flexibility, но до конца апреля 2026 года остается без production API. Kling 3.0 дает самое высокое native resolution, самую надежную инфраструктуру и наиболее удобную стоимость для high-volume production. SkyReels V4 объединяет самые богатые multimodal input, встроенное редактирование и самую длинную длительность одной генерации.

Для большинства production team оптимальная стратегия состоит не в выборе одной модели, а в построении workflow, который использует сильные стороны каждой. Используйте Kling 3.0 для hero shots и high-resolution deliverables. Подключайте Happy Horse 1.0 для narrative sequences с continuity персонажей, как только API станет доступна. Используйте SkyReels V4 там, где нужен surgical editing или complex multimodal conditioning. Такой multi-model approach, особенно при наличии платформ вроде Happy Horse, которые объединяют несколько моделей в одном интерфейсе, выглядит наиболее прагматичным путем в индустрии, где ни одно решение не доминирует во всех случаях.

Рынок AI-видео будет продолжать быстро меняться на протяжении всего 2026 года. Benchmarks, которые сегодня определяют state of the art, уже к Q3 2026 могут стать средним уровнем. Сравниваемые здесь модели выпустят новые версии, появятся новые конкуренты, а архитектурные инновации снова перестроят иерархию. Неизменным останется только одно: создателям нужно уметь сопоставлять возможности инструментов с конкретными творческими задачами, сохранять гибкость workflow и ставить production reliability выше, чем простой рейтинг. Будущее AI-видео — не один победитель, а целая экосистема специализированных инструментов. Выиграют те, кто научится грамотно их оркестрировать.

Готовы попробовать будущее AI-видеогенерации? Перейдите на , чтобы получить доступ к Happy Horse 1.0, Kling 3.0, SkyReels V4 и другим ведущим моделям в рамках единой платформы. Создайте свое первое видео с кинематографическим качеством уже сегодня, используя интегрированные workflow-tools и intelligent model routing.