2026 年初頭、AI 動画生成の勢力図は地殻変動と呼ぶにふさわしい変化を経験しました。かつてこの分野は、ぼやけていて、アーティファクトが多く、いかにも実験段階だとわかるクリップしか出せないツールの遊び場に近いものでした。しかし今では状況が違います。現在は、Happy Horse 1.0、Kling 3.0、SkyReels V4 という 3 つのモデルがリーダーボードの上位を実際に支配する、明確な競争市場へと成熟しています。しかも、この 3 つは単に品質が高いだけでなく、それぞれが異なるアーキテクチャ思想を体現しており、クリエイター、マーケター、映像制作者にとって本当に重要な制作シナリオごとに、別々の強みを示しています。本稿では、それぞれの技術的基盤、実運用での性能、そして具体的な適用領域を分解しながら、あなたのワークフローに最も適したモデルを選ぶための判断材料を提供します。

新しい基準: 2026年に何が変わったのか

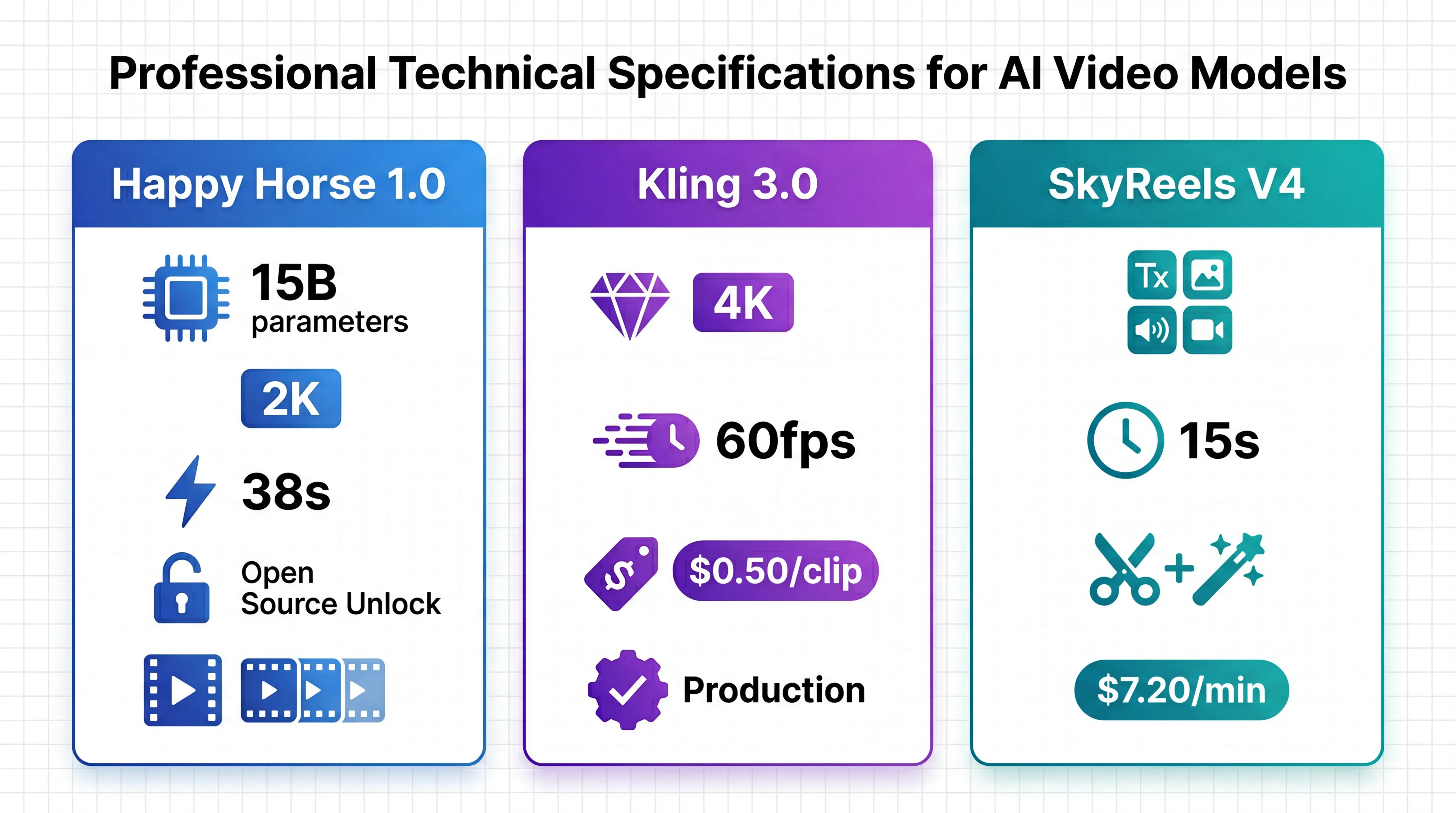

AI 動画生成分野は、2026 年初頭にひとつの決定的な閾値を超えました。12 か月前には研究論文の中にしか存在しなかった音声と映像のネイティブ同時生成が、いまや 3 つの主要モデルすべてにおいて、本番環境で使える実用機能になっています。解像度面でも跳躍が起きました。Kling 3.0 はネイティブ 4K を 60fps で出力できるようになり、一方で Happy Horse 1.0 は H100 ハードウェア上でおよそ 38 秒という速度で 2K シネマ品質の動画を生成できます。モーション品質のベンチマークも急速に引き締まり、独立評価では Seedance 2.0 が動きのリアリズムで 10 点満点中 9.2、Kling 3.0 がそれに続いて 9.0 という評価を受けるまでになりました。

競争のダイナミクス自体も、根本から変化しました。Happy Horse 1.0 は 2026 年 4 月初旬、Artificial Analysis Video Arena に匿名で登場し、音声なしのテキスト動画生成カテゴリで Elo 1,361 を記録して、あっという間に首位へ駆け上がりました。これは Seedance 2.0 や Kling 3.0 のような既存の有力モデルを上回る数値です。どのモデルが生成したかを伏せた状態でユーザーが出力を比較投票するこのブラインド評価方式は、現時点で利用可能な品質シグナルの中でもっとも客観性が高いものです。その環境で Happy Horse 1.0 が Kling 3.0 と SkyReels V4 の両方を継続的に上回ったという事実は、単なるマーケティング上の誇張ではなく、実際のアーキテクチャ的優位が存在することを示しています。

Happy Horse 1.0: オープンソース陣営の破壊者

Happy Horse 1.0 は、クローズドソース優位が続いてきた AI 動画生成市場に対する、最初の本格的な挑戦と言えます。このモデルは 15B パラメータ規模の統合型 Transformer アーキテクチャを土台にしており、40 層の self-attention を備えています。さらに、text、image、video、audio の token を、ひとつの順伝播の中でネイティブに処理します。この設計判断によって、動画と音声を別々の段階で生成し、あとからポストプロダクションで同期させる多段パイプラインが抱える同期ずれのアーティファクトを、構造レベルで回避できます。

技術アーキテクチャと性能

このモデルは DMD-2 distillation を採用しています。これは denoising プロセスを classifier-free guidance なしで、わずか 8 ステップまで削減する手法です。この最適化によって推論速度は非常に高くなっています。256p 解像度の 5 秒クリップならおよそ 2 秒、フル 1080p 出力でも H100 ハードウェア上なら約 38 秒で生成できます。近い競合モデルと直接比較した場合でも、Happy Horse 1.0 は 2K 動画を Seedance 1.5 Pro より 30% 高速に、Kling 2.1 より 29% 高速に生成するとされています。

Dual-Branch DiT アーキテクチャには特に注目する価値があります。ひとつのブランチが映像合成を担当し、もうひとつのブランチが時間的に整合した音声を生成し、両ブランチは共通の統合テキストエンコーダを共有します。この設計により、複数ショットをまたいだキャラクターの同一性の維持が可能になります。ここが Sora、Runway、あるいは標準的な Kling 実装のような単発生成モデルとの明確な差です。Happy Horse 1.0 に対してナラティブな記述を含むプロンプトを与えると、孤立したクリップが並ぶのではなく、一貫したシーンの連なりを自動生成します。その結果、完成したストーリーを組み立てるために必要だった人手の編集作業を大幅に削減できます。

多言語 lip-sync と音声能力

Happy Horse 1.0 は、Chinese、English、Japanese、Korean、German、French、Cantonese の 7 言語で native joint audio-video generation をサポートしています。公式資料では ultra-low WER lip-sync という表現が使われていますが、ここでいう WER は Word Error Rate のことで、音声認識分野から借用された指標です。これは口の動きが発話される音素とどれだけ正確に一致しているかを測るための考え方です。これらの WER に関する主張はまだ独立検証待ちではあるものの、Artificial Analysis 上で確認できる arena output を見る限り、少なくとも English と Chinese のテストケースでは十分に説得力のある同期品質が示されています。

音声生成の範囲は、単なるセリフの生成にとどまりません。ambient sound や Foley effect まで含まれます。たとえば、雨が都市の通りに降るシーンを生成した場合、モデルは水滴や濡れた舗装路面の反射といった視覚情報だけでなく、雨音の層、遠くの交通音、さらに水が異なる表面に当たることで生まれる個別の音響的な質感までまとめて生成します。ここまでの audio-visual integration が実現されると、従来なら別系統のサウンドデザインツールで補っていたポストプロダクション工程を、丸ごと省略できるようになります。

オープンソースの優位と現時点の制約

Happy Horse 1.0 は、base model、distilled model、super-resolution module、そして完全な inference code を含む、フルオープンソースのパッケージとして公開されています。このライセンス形態によって、セルフホストや用途特化の fine-tuning が可能になります。これは、厳格なブランドガイドラインを持つ企業、独自のビジュアルスタイルを資産として扱う組織、あるいはデータ主権要件を重視するチームにとって、非常に大きな意味を持つ能力です。2026 年 4 月中旬の時点では、このモデルは Artificial Analysis Video Arena の leaderboard 上で Seedance 2.0、Ovi 1.1、LTX 2.3 を上回っており、open-weights 系モデルの中で最高品質の選択肢を確立しています。

しかし、benchmark performance と production accessibility の間には、依然として重大なギャップがあります。2026 年 4 月 18 日時点で、Happy Horse 1.0 には公開 API が存在しません。公式チームはソーシャルメディアを通じて、API access は 2026 年 4 月 30 日に開始すると告知しており、さらにアクセスを装った詐欺的なサイトがすでに複数出現していることへの警告も出しています。つまり、グローバル leaderboard で 1 位に位置するモデルが、現時点ではまだ production workflow の中へ直接組み込めないということです。いま動画生成基盤の選定を進めているチームにとって、これはかなり戦略的なジレンマになります。

Kling 3.0: production-grade benchmark

Kuaishou の Kling 3.0 は、すでに 2 か月間 live API として稼働していること、ドキュメントが整っていること、そしてスケール時にも性能が安定していることによって、production-grade standard としての立場を確立しています。このモデルは Visual Chain-of-Thought architecture を採用しており、複雑なプロンプトを逐次的な reasoning step に分解することで、複数の要素から成るシーン、特定の camera movement、lighting condition、character interaction を、より正確に解釈できるように設計されています。

native 4K output と motion quality

Kling 3.0 のもっとも目立つ差別化要因は、native 4K output at 60 frames per second です。2026 年 2 月時点で、これは主要な AI 動画モデル群の中でも最高の native resolution でした。ここで重要なのは、これは単なる 1080p コンテンツのアップスケールではなく、本当の意味での 3840x2160 レンダリングだということです。そのため、生成後の解像度強化で起こりがちな softness やアーティファクトが抑えられます。さらに 60fps の frame rate は、以前の 24fps や 30fps モデルに見られた AI stutter を取り除きます。その結果、Kling 3.0 は高速アクションシーン、スポーツ系コンテンツ、あるいはモーションの明瞭さがそのまま品質知覚に直結するプロフェッショナル向け商品デモにおいて、特に強みを発揮します。

独立ベンチマークでも、Kling 3.0 は motion quality で一貫して上位に位置しています。プロの videographer からは、「現時点で入手できるもっとも capable な general-purpose video model かもしれない」「natural movement と physics simulation に関しては overall で state-of-the-art だ」と評されることもあります。このモデルは、リアルな physical interaction を必要とするシナリオに強いのが特徴です。たとえば、物体同士の衝突、液体が注がれる挙動、布が風に反応する様子など、以前の世代では視覚的に不自然な結果になりやすかった領域で、よりもっともらしい出力を実現します。

コスト効率と production scalability

1 クリップあたり約 0.50 ドルという価格設定によって、Kling 3.0 はトップティアの動画生成モデルの中でも、高ボリューム production に対してもっとも cost-effective な選択肢になっています。ModelsLab のような API provider 経由で利用する場合、価格は生成動画 1 秒あたりおよそ 0.12〜0.15 ドルで、5 秒のクリップなら概ね 0.60〜0.75 ドル程度です。さらに、大量利用者向けの bulk pricing も用意されており、毎月何十本、何百本もの product video を生成する必要がある marketing agency、social media content team、e-commerce platform にとって、とりわけ魅力的な選択肢になります。

ユーザー報告ベースの generation time は、prompt の複雑さやサーバー負荷に応じて、おおむね 2 分から 15 分の範囲に収まっています。これは Happy Horse 1.0 が 1080p 生成で主張する約 38 秒よりは遅い数字です。ただし、複数クリップを同時にキューへ投入する batch production workflow では、この差の意味は小さくなります。実運用において本当に効いてくるのは、API の安定性と、読みやすく予測しやすい pricing structure です。そうした理由から、Kling 3.0 はすでに多くの production application において、安定した品質を支える infrastructure backbone として使われています。

Motion Control と高度な機能

Kling 3.0 には、特筆すべき Motion Control feature も搭載されています。ユーザーは reference video をアップロードし、そこから motion pattern を抽出して、その movement signature をまったく別の subject に適用できます。たとえば、実在する空間の中で特定の camera dolly movement を撮影しておき、その motion profile を AI 生成したファンタジー風景へ適用する、といった使い方が可能です。この能力は、従来型 cinematography technique と AI generation の間のギャップを埋めるものです。これにより、ディレクターは AI によって映像内容を作りながらも、camera work そのものについては精密な creative control を維持できます。

さらに、Kling 3.0 Omni variant はベースモデルを拡張し、より強化された multimodal capability を提供します。その中には voice cloning も含まれており、ユーザーは生成前に特定の voice profile を character に bind できます。これにより、複数シーンにまたがって一貫した vocal characteristic を保てます。これは narrative content、branded character、教育シリーズのように、視聴者の理解や没入感が「同じ人物が同じ声で話している」という継続性に大きく依存するケースで、非常に重要な意味を持ちます。

SkyReels V4: unified multimodal foundation

Kunlun の SkyReels V4 は、前の 2 モデルとはまた異なる設計哲学を示しています。単一の generation pass の中で性能を最大化する方向ではなく、このモデルは dual-stream Multimodal Diffusion Transformer architecture を採用しています。ひとつの branch が video を合成し、もうひとつの branch が時間的に整合した audio を生成し、両 branch は Multimodal Large Language Models を基盤とする強力な text encoder を共有します。この設計によって、SkyReels V4 は 3 モデルの中でもっとも豊かな multimodal instruction を受け取れるようになっています。text、image、video clip、mask、audio reference を任意の組み合わせで投入でき、scene composition、character appearance、さらには sonic atmosphere まで、非常に細かく制御できます。

unified generation, inpainting, editing

SkyReels V4 を定義づける最大の特徴は、generation、inpainting、editing を別々の機能として扱うのではなく、ひとつのアーキテクチャの中で統一的に扱っている点です。このモデルは channel-concatenation formulation を採用しており、image-to-video conversion、video extension、そして surgical video editing を、すべて同一のインターフェース下で処理できます。つまり、まずベースとなる scene を生成し、そのあとで mask-based inpainting を使って、キャラクターの outfit を差し替えたり、watermark を除去したり、background を置き換えたりしても、クリップ全体を最初から再生成する必要がありません。

その実務的な意味は非常に大きいです。従来の動画生成 workflow では、生成と修正のために別々のツールを使う必要がありました。ひとつのシステムで生成し、いったん export し、別のアプリケーションで編集し、その編集結果が違和感なく馴染んでくれることを祈るしかありませんでした。SkyReels V4 はこのパイプラインをひとつの環境へと圧縮します。しかも修正は元の生成と同じ latent space の中で行われるため、visual consistency が保たれ、format conversion artifact も避けられます。

解像度・尺・効率戦略

SkyReels V4 は、最大 1080p 解像度、32fps、そして 15 秒までの duration に対応しています。この 15 秒という長さは、本稿で比較している 3 モデルの中では、single generation で到達できる最長尺です。この高解像度かつ長尺の生成を、現実的な計算資源で成立させるために、このモデルは巧妙な efficiency strategy を採っています。低解像度のフルシーケンスと、高解像度の keyframe を同時に生成し、その後で専用の super-resolution model と frame interpolation model を適用して最終出力を作るのです。

この keyframe-plus-superresolution approach は、当然ながら direct generation に比べて処理段数を増やします。そのため、total generation time には不利に働きます。しかしその代わり、現在のハードウェア制約の下でも、より長い duration にわたって temporal consistency を維持しやすくなります。物語性のある content、explainer video、tutorial sequence のように、15 秒間連続したショットを確保できること自体に大きな価値があるケースでは、このトレードオフは十分に合理的です。

ランキング上の位置とアクセス性

SkyReels V4 は、2026 年 3 月の公開直後に Artificial Analysis Global Text-to-Video with Audio Leaderboard で 2 位を獲得しました。これは、このモデルが既存の有力プレイヤーと正面から競争できる quality level に到達していることを示しています。text-to-video without audio のカテゴリでは、SkyReels V4 は Elo 1,244 で、Kling 3.0 Pro の 1,243 をわずか 1 ポイント上回っています。こうした near-parity の blind evaluation 結果は、もはや品質差そのものよりも、workflow integration、pricing structure、そして具体的な機能要件への適合性の方が、実際の意思決定において支配的になりつつあることを示しています。

SkyReels V4 は API provider 経由で利用でき、価格は生成動画 1 分あたり約 7.20 ドルです。この価格は PixVerse V6 の 5.40 ドル/分と Kling 3.0 Pro の 13.44 ドル/分の中間に位置します。複数の独立評価者は、2026 年 4 月時点でこれを「アクセス可能なモデルの中では、もっとも quality-to-price ratio が優れている選択肢」と評しています。

直接比較: technical specifications

| Specification | Happy Horse 1.0 | Kling 3.0 | SkyReels V4 |

|---|---|---|---|

| Architecture | 15B-parameter unified Transformer, 40-layer self-attention, Dual-Branch DiT | Visual Chain-of-Thought, diffusion-based pipeline | Dual-stream Multimodal Diffusion Transformer (MMDiT) |

| Resolution | Up to 2K (1080p native) | Native 4K (3840x2160) | Up to 1080p |

| Frame Rate | Standard (30fps implied) | 60fps | 32fps |

| Max Duration | Multi-shot sequences | 10-15 seconds per clip | 15 seconds |

| Audio Generation | Native joint synthesis, 7 languages | Native with voice cloning | Native joint synthesis |

| Inference Speed | ~38s for 1080p (H100) | 2-15 minutes (varies by load) | Longer (keyframe + SR approach) |

| API Availability | Coming April 30, 2026 | Live since February 2026 | Live since March 2026 |

| Pricing | TBA | ~$0.50/clip, $0.12-0.15/sec | ~$7.20/min |

| Open Source | Yes (full model + code) | No | Partial (weights status unclear) |

| Elo Rating (T2V no audio) | 1,361 | 1,247 | 1,244 |

Use case recommendations: どのワークフローにどれを選ぶべきか

Happy Horse 1.0 を選ぶべきケース

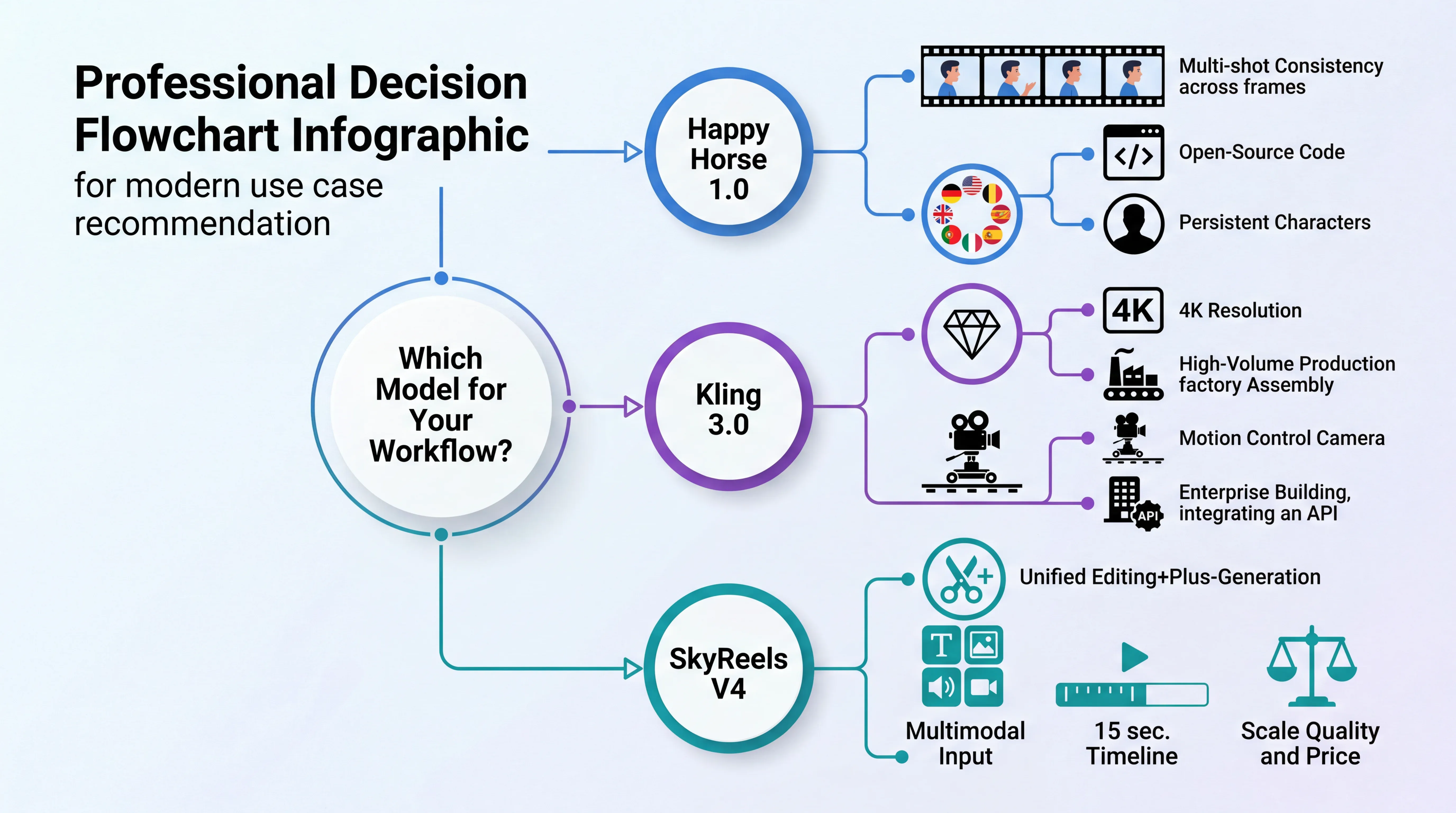

持続的なキャラクターを伴う multi-shot narrative content。 Happy Horse 1.0 は、scene transition をまたいでも character identity を維持しやすいため、short film、branded storytelling、educational series のように、最大解像度より visual continuity の方が重要になる用途に特に向いています。native multi-shot generation によって、孤立した clip をあとから手作業でつなぎ合わせて coherent sequence を組み立てる必要が薄れます。

フルコントロール可能な self-hosted infrastructure。 data sovereignty 要件を持つ企業、fine-tuning を前提とする proprietary visual style を抱える組織、あるいは on-premise processing を要求するワークフローにとって、Happy Horse 1.0 の open-source licensing は本質的です。model architecture や training process そのものに手を入れられるという能力は、API-only service では実現できないレベルの customization を可能にします。

同期された対話を含む多言語コンテンツ。 7 言語に対応する lip-sync capability は、Happy Horse 1.0 を international content creator、language learning application、global marketing campaign にとって極めて有力な選択肢にします。複数言語において lip synchronization を正確に保てることは、そのまま localization cost の削減につながるからです。

API 公開を待てること。 あなたの production timeline が 2026 年 4 月 30 日以降まで伸びており、公式 API availability を待てるなら、Happy Horse 1.0 の benchmark-leading quality は、その待ち時間を正当化するだけの価値があります。逆に、すぐに production needs を満たさなければならない場合は、Kling 3.0 や SkyReels V4 の方が現実的な選択肢に残ります。

Kling 3.0 を選ぶべきケース

最大解像度と motion clarity が必要な場合。 4K 60fps 出力が交渉不能な要件であるなら、たとえば professional product demonstration、high-end advertising、festival-quality short film、あるいは visual fidelity がブランド価値の知覚に直接響くようなコンテンツにおいては、Kling 3.0 の native resolution advantage が他の検討事項すべてを上回ります。

高ボリューム production at scale。 毎日何十本もの social media clip を作る marketing agency、何千 SKU 分もの product video を生成する e-commerce platform、継続シリーズを量産する content studio は、Kling 3.0 の cost efficiency、API stability、batch processing capability から大きな恩恵を受けます。1 clip あたり 0.50 ドル程度という価格設定は、大規模 production を経済的に成立させる重要な条件です。

精密な motion control と cinematography。 特定の camera movement を適用したい director や cinematographer、複数ショットで一貫した motion signature を保ちたい人、あるいは従来撮影した映像と AI-generated content を自然に統合したいチームにとって、Kling 3.0 の Motion Control feature は不可欠です。この機能は、他モデルがまだ十分には提供していないやり方で、プロフェッショナルな filmmaking technique と AI generation を橋渡しします。

実証済みの production infrastructure。 customer-facing application、video generation を組み込んだ SaaS product、あるいは automated content pipeline を構築するチームは、2 か月にわたる live API availability、包括的な documentation、そして複数 provider option がもたらす operational reliability を必要とします。そうした意味で Kling 3.0 は、Happy Horse 1.0 や SkyReels V4 がまだ完全には到達していない水準で、すでに production infrastructure そのものになっています。

SkyReels V4 を選ぶべきケース

生成と編集が統合された workflow。 生成した動画に対して、background を差し替える、character outfit を変える、不要な要素を消す、scene を延長するといった修正を頻繁に行う content creator は、SkyReels V4 の integrated inpainting and editing capability から非常に大きな利益を得られます。元生成と同じ latent space の中で surgical modification を行えるため、外部編集ツールでは維持しにくい visual consistency を保てます。

複雑な multimodal conditioning。 text description、reference image、video clip、mask、audio guidance の組み合わせを通じて、きわめて精密な制御が必要なプロジェクトでは、SkyReels V4 の rich input modality support が活きます。これは、厳密な visual guideline を持つ branded content、特定の appearance と voice が必要な character-driven narrative、scene composition の精度が重要な technical demonstration のような用途で特に意味を持ちます。

より長い continuous shot。 最大 15 秒という duration は、SkyReels V4 を explainer video、tutorial content、extended take が必要な narrative scene、あるいは複数の短い clip に切り刻むと viewer comprehension や emotional engagement が損なわれるような用途において、最有力の選択肢にします。

アクセス可能な選択肢の中で最良クラスの quality-to-price ratio。 generation、editing、iteration cycle を含む production pipeline 全体のコスト効率を評価するチームにとって、SkyReels V4 の 1 分あたり 7.20 ドルという価格と integrated editing capability の組み合わせは、生成そのものは安くても、別の編集ツールと追加の反復コストが必要な generation-only service より、結果的に総コストを低く抑える場合があります。

パフォーマンス benchmark: motion quality と physics simulation

実際の production workflow に基づく独立検証を見ていくと、aggregate Elo score よりも、具体的なユースケースにおいて効いてくる細かな性能差の方が重要であることがわかります。2026 年 2 月時点で行われた評価によれば、motion realism の指標では Seedance 2.0 が 10 点中 9.2 で最高評価を獲得し、Kling 3.0 が 9.0 でそれに続いています。Seedance は cinematic motion smoothing、つまりカメラの加速と減速が、機械的な直線運動ではなく、プロのオペレーターが操っているように感じられる微妙なカーブ表現に優れています。一方で Kling 3.0 は natural physics simulation を得意としており、特に gravity、momentum、そして fabric dynamics や liquid behavior のような material property が絡むシーンで強さを見せます。

Happy Horse 1.0 の motion quality は、blind arena comparison を通じて裏づけられています。ユーザーは、どのモデルが各クリップを生成したのかを知らない状態で、それでも一貫して Kling 3.0 と Seedance 2.0 の両方より Happy Horse 1.0 の出力を高く評価しました。この事実は、Happy Horse 1.0 が 9.0〜9.2 の benchmark score さえ上回るレベルの motion quality を持っていることを示唆します。ただし、正式な数値評価については、まだ独立したラボによる検証を待っている段階です。

SkyReels V4 の motion quality も、このトップティアの中で十分に競争力があります。Elo 1,244 という値は Kling 3.0 Pro をわずか 1 ポイント上回るだけですが、このレベルまで来ると、3 モデルとも初期世代を悩ませた obvious artifact、たとえば morphing object、drifting face、physics violation といった問題をかなり避けられるようになっています。残る品質差は、もっと微細な部分に現れます。たとえば、ターンするときにキャラクターの体重移動がどれだけ自然か、水滴が光をどれだけ説得力を持って拾うか、布の fold が身体の動きに対してどう反応するか、といった点です。こうしたニュアンスは high-end commercial work では非常に重要ですが、mobile device で視聴される social media content では気づかれないこともあります。

Happy Horse platform の優位

ここまでの比較では主に Happy Horse 1.0 という個別モデルそのものに焦点を当ててきましたが、Happy Horse が提供する unified platform approach にも触れておく価値があります。これは、AI 動画 production における重大な pain point、つまり tool fragmentation を解決する方向性です。4K 出力のために Kling、motion quality のために Seedance、editing capability のために SkyReels と、複数のサービスに別々で課金しながら運用する代わりに、Happy Horse は複数の leading model への access を単一の workflow environment の中で統合して提供します。この統合は、いくつかのきわめて実務的な理由から重要です。

第一に、モデルごとに異なる interface、prompt syntax、parameter system を習得しなければならない cognitive overhead をなくせます。クリエイターは、同じ prompt を Happy Horse 1.0、Kling 3.0、SkyReels V4 に対して、そのまま切り替えながらテストできます。これにより rapid iteration と direct quality comparison が容易になります。第二に、billing と budget management が簡単になります。複数サービスの異なる pricing structure を追跡する代わりに、ひとつの subscription、ひとつの invoice、そしてより予測しやすいコスト体系にまとめられます。第三に、creative challenge ごとに最適なモデルを割り当てる workflow optimization が可能になります。たとえば、maximum resolution が必要な hero shot には Kling 3.0、character consistency が重要な narrative sequence には Happy Horse 1.0、surgical editing が必要な scene には SkyReels V4 といった具合に、要件ごとにモデルを自然に使い分けられます。

この platform approach は、業界全体で進んでいる AI model aggregation の流れも映し出しています。ひとつの large language model がすべての text generation task を支配しないのと同じように、ひとつの video generation model があらゆる creative challenge でベストになることはありません。プロフェッショナル向け AI 動画 production の未来は、おそらく intelligent model routing に向かいます。つまり、prompt analysis、budget constraint、quality requirement をもとに、システムが自動的に最適モデルを選択したり、推薦したりする世界です。Happy Horse の integrated platform は、その multi-model future に対して非常に有利なポジションを取っています。

すべてのモデルに共通する制約と考慮点

2026 年初頭の進歩がどれほど目覚ましいものであっても、3 つのモデルすべてには、production workflow に本格投入する前に理解しておくべき共通の制約があります。complex scenario における physics simulation、たとえば fire behavior、複数の流れが相互作用する water dynamics、cloth tearing のような現象は、いまでもときどき破綻し、視覚的にもっともらしくない結果を生むことがあります。さらに multi-character interaction、特に 3 人以上のキャラクターが協調した動作をするシーンでは、limb が不自然に交差したり、空間関係が混乱したりする visual artifact が生じやすい傾向があります。

cross-video character consistency も、依然として未解決の課題です。Happy Horse 1.0 はひとつの multi-shot generation の内部で character identity を維持できますし、SkyReels V4 は reference image を使って character appearance を誘導できます。しかし、完全に独立した generation session をまたいでも、careful prompt engineering と reference image management なしに、同一キャラクターを確実に再現できるモデルはまだ存在しません。この制約は、series content、繰り返し登場する branded character、あるいは複数エピソードや複数 campaign にわたって cast の一貫性が必要な application にとって、非常に重要です。

copyright landscape にも注意が必要です。2026 年 3 月、米国最高裁は Thaler v. Perlmutter の上訴を受理しませんでした。結果として、純粋に AI-generated な content は copyright protection の対象にならないという判断が事実上維持されたことになります。これは、あなたが生成した AI 動画を誰かが合法的にコピーして使うことができ、しかもあなた自身は完全な copyright ownership を主張できないことを意味します。content exclusivity にビジネスが依存している企業にとって、これは戦略的リスクです。そのため、人間による creative input を加えること、十分な post-production modification を施すこと、あるいは trademark や trade dress のような別の法的保護を組み合わせることが、リスク低減策として必要になります。

結論: AI 動画制作の未来は multi-model になる

Happy Horse 1.0、Kling 3.0、SkyReels V4 の競争が示しているのは、AI 動画生成業界が成熟しつつあり、quality difference が狭まり、いまや raw benchmark score そのものよりも、workflow integration、specific feature requirement、cost structure の方が意思決定において重要になりつつあるということです。Happy Horse 1.0 は blind quality evaluation で首位に立ち、open-source flexibility でも他を大きく上回りますが、2026 年 4 月下旬までは production API がありません。Kling 3.0 はもっとも高い native resolution、実証済みの infrastructure reliability、そして高ボリューム production に向いた cost-effective な pricing を提供します。SkyReels V4 は、もっとも豊かな multimodal input support、integrated editing capability、そして最長の single-generation duration を提供します。

多くの production team にとって、最適戦略はひとつのモデルを選んで固定することではありません。むしろ、それぞれのモデルの強みを活かす workflow を構築することです。hero shot や high-resolution deliverable には Kling 3.0 を使い、character consistency が必要な narrative sequence には、API 公開後の Happy Horse 1.0 を投入し、surgical editing や複雑な multimodal conditioning が必要な content には SkyReels V4 を使う。Happy Horse のように複数モデルを unified interface の中へ統合する platform は、こうした multi-model approach を実務上成立させるための基盤になります。あらゆるユースケースをひとつの解が支配しない市場において、これこそがもっとも pragmatic な前進ルートです。

AI 動画生成領域は、2026 年を通じてなお急速に進化し続けるでしょう。今日 state-of-the-art を定義している benchmark は、2026 年 Q3 には中位クラスへ落ち着いているかもしれません。ここで比較したモデルはそれぞれ更新版をリリースし、新しい競合も現れ、さらなる architectural innovation が performance hierarchy を塗り替えていくはずです。それでも変わらないのは、クリエイターが各ツールの capability を具体的な creative challenge に正しく対応づけ、workflow flexibility を維持し、benchmark ranking よりも production reliability を優先する必要があるということです。AI 動画の未来は、単一の勝者が支配する世界ではなく、specialized tool が並び立つ ecosystem です。そして最終的に勝つのは、それらを効果的に orchestrate できる人たちです。

AI 動画生成の未来を体験する準備はできていますか? Happy Horse にアクセスすれば、Happy Horse 1.0、Kling 3.0、SkyReels V4、そしてその他の主要モデルへ、ひとつの unified platform からアクセスできます。統合された workflow tool と intelligent model routing を活用しながら、あなたの最初の cinematic video を今日から作り始めてみてください。