Le paysage de la generation video par IA a subi un changement sismique au debut de 2026. Ce qui n'etait autrefois qu'un terrain de jeu d'outils experimentaux produisant des clips flous et charges d'artefacts est devenu une arene concurrentielle ou trois modeles dominent desormais les classements : Happy Horse 1.0, Kling 3.0 et SkyReels V4. Chacun incarne une philosophie architecturale distincte, et chacun excelle dans des scenarios de production precis qui comptent vraiment pour les createurs, les marketeurs et les cineastes. Ce guide complet decortique leurs fondations techniques, leurs performances concretes et leurs applications pratiques afin de vous aider a choisir le bon modele pour votre workflow.

Le nouveau benchmark : qu'est-ce qui a change en 2026 ?

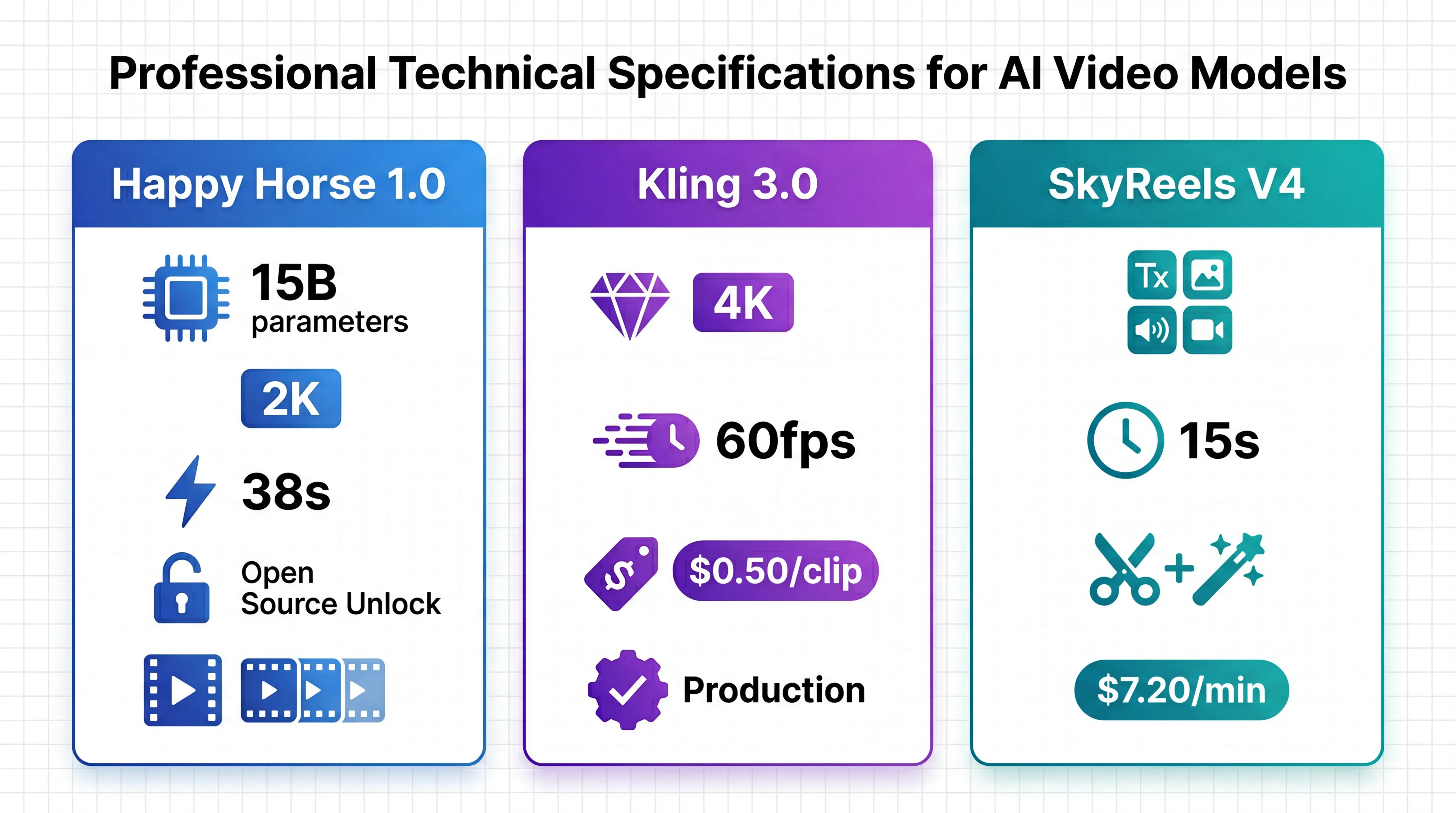

L'espace de la generation video par IA a franchi un seuil critique au debut de 2026. La generation conjointe native audio-video, qui n'existait encore que dans des articles de recherche douze mois plus tot, est devenue une fonctionnalite exploitable en production sur les trois modeles. Les capacites de resolution ont egalement fait un bond spectaculaire. Kling 3.0 livre desormais une sortie 4K native a 60 fps, tandis que Happy Horse 1.0 fournit une video 2K de qualite cinema en environ 38 secondes sur du materiel H100. Les benchmarks de qualite du mouvement se sont resserres au point que des evaluateurs independants attribuent 9,2 sur 10 a Seedance 2.0 pour le realisme du mouvement, avec Kling 3.0 juste derriere a 9,0.

La dynamique concurrentielle a elle aussi change de facon fondamentale. Happy Horse 1.0 est apparu anonymement sur l'Artificial Analysis Video Arena au debut d'avril 2026 et a rapidement pris la premiere place avec un score Elo de 1 361 en text-to-video sans audio, depassant des acteurs etablis comme Seedance 2.0 et Kling 3.0. Cette methode d'evaluation en aveugle, dans laquelle les utilisateurs votent sur les resultats sans savoir quel modele a genere la sortie, fournit aujourd'hui le signal de qualite le plus objectif disponible. Le fait que Happy Horse 1.0 ait constamment surclasse Kling 3.0 et SkyReels V4 dans des comparaisons cote a cote revele de veritables avantages architecturaux plutot qu'un simple effet de communication.

Happy Horse 1.0 : le perturbateur open source

Happy Horse 1.0 represente le premier defi serieux lance a la domination des solutions closed source dans la generation video par IA. Construit sur une architecture Transformer unifiee de 15 milliards de parametres avec 40 couches de self-attention, le modele traite nativement les tokens de texte, d'image, de video et d'audio au sein d'un unique forward pass. Cette decision architecturale elimine les artefacts de synchronisation qui penalisent les pipelines multi-etapes, ou la video et l'audio sont generes separement puis alignes en post-production.

Architecture technique et performances

Le modele repose sur la distillation DMD-2, une technique qui reduit le processus de denoising a seulement huit etapes sans necessiter de classifier-free guidance. Cette optimisation permet des vitesses d'inference remarquables : environ deux secondes pour un clip de cinq secondes en resolution 256p, et environ 38 secondes pour une sortie 1080p complete sur du materiel H100. Compare directement a ses concurrents les plus proches, Happy Horse 1.0 genere de la video 2K 30 % plus vite que Seedance 1.5 Pro et 29 % plus vite que Kling 2.1.

L'architecture Dual-Branch DiT merite une attention particuliere. Une branche gere la synthese visuelle tandis que l'autre genere un audio aligne dans le temps, les deux branches partageant un encodeur de texte unifie. Cette conception permet au modele de conserver une identite de personnage stable sur plusieurs plans, une capacite qui le distingue de generateurs single-shot comme Sora, Runway ou les implementations standard de Kling. Lorsque vous fournissez a Happy Horse 1.0 une description narrative, il cree automatiquement des sequences de scenes coherentes plutot que des clips isoles, ce qui reduit fortement le montage manuel necessaire pour assembler une histoire complete.

Lip-sync multilingue et capacites audio

Happy Horse 1.0 prend en charge la generation conjointe native audio-video dans sept langues : chinois, anglais, japonais, coreen, allemand, francais et cantonais. Le modele atteint ce que sa documentation decrit comme un ultra-low WER lip-sync, WER renvoyant a Word Error Rate, une mesure issue de la reconnaissance vocale qui evalue avec quelle precision les mouvements des levres correspondent aux phonemes prononces. Meme si une verification independante de ces affirmations sur le WER reste en attente, les sorties visibles sur Artificial Analysis montrent deja une synchronisation convaincante dans les cas de test en anglais et en chinois.

La generation audio va au-dela du dialogue et couvre egalement les sons d'ambiance et les effets Foley. Si vous generez une scene de pluie tombant dans une rue urbaine, le modele produit non seulement l'image des gouttes d'eau et des reflets sur le bitume mouille, mais aussi le paysage sonore stratifie de la pluie, du trafic lointain et de la signature acoustique specifique de l'eau frappant differentes surfaces. Ce niveau d'integration audio-visuelle elimine une etape entiere du workflow de post-production qui, traditionnellement, exigeait des outils de sound design separes.

L'avantage open source et les limites actuelles

Happy Horse 1.0 est livre sous forme de package entierement open source comprenant le modele de base, le modele distille, le module de super-resolution et l'integralite du code d'inference. Cette approche de licence permet le self-hosting et le fine-tuning pour des cas d'usage specifiques, une capacite extremement importante pour les entreprises ayant des chartes de marque precises, des styles visuels proprietaires ou des exigences de souverainete des donnees. Le modele surpasse Seedance 2.0, Ovi 1.1 et LTX 2.3 sur le classement Artificial Analysis Video Arena, ce qui en fait l'option open weights de plus haute qualite disponible a la mi-avril 2026.

Cependant, un ecart critique subsiste entre la performance de benchmark et l'accessibilite en production. Au 18 avril 2026, Happy Horse 1.0 ne dispose d'aucune API publique. L'equipe officielle a annonce sur les reseaux sociaux que l'acces API serait lance le 30 avril 2026 et a averti que plusieurs sites frauduleux etaient deja apparus en pretendant proposer un acces. Cela signifie que le modele numero un du classement mondial reste inaccessible pour les workflows de production, ce qui cree un veritable dilemme strategique pour les equipes qui evaluent aujourd'hui leur infrastructure de generation video.

Kling 3.0 : le benchmark production-grade

Kling 3.0 de Kuaishou s'est impose comme le standard production-grade de la generation video par IA grace a deux mois de disponibilite API en direct, une documentation complete et des performances coherentes a grande echelle. Le modele s'appuie sur une architecture Visual Chain-of-Thought qui decoupe les prompts complexes en etapes de raisonnement sequentielles, ce qui permet une interpretation plus precise des scenes multi-elements avec mouvements de camera specifiques, conditions de lumiere et interactions entre personnages.

Sortie 4K native et qualite du mouvement

Le differenciateur le plus visible de Kling 3.0 est sa sortie 4K native a 60 images par seconde, la plus haute resolution native parmi tous les grands modeles video IA a la date de fevrier 2026. Il ne s'agit pas d'un contenu 1080p upscale, mais d'un vrai rendu en 3840x2160 sans la mollesse ni les artefacts qui caracterisent l'amelioration de resolution effectuee apres la generation. Le framerate de 60 fps elimine l'AI stutter observe sur les anciens modeles en 24 fps et 30 fps, ce qui rend Kling 3.0 particulierement efficace pour les sequences d'action rapides, les contenus sportifs et les demonstrations produit professionnelles ou la clarte du mouvement influence directement la qualite percue.

Les benchmarks independants classent regulierement Kling 3.0 parmi les meilleurs pour la qualite du mouvement. Des videastes professionnels l'ont decrit comme sans doute le modele video generaliste le plus capable disponible actuellement et comme une reference absolue pour le mouvement naturel et la simulation physique. Le modele excelle dans les scenarios ou une interaction physique realiste est indispensable : objets qui se heurtent, liquides qui se deversent et tissus qui reagissent au vent, la ou les modeles precedents produisaient des resultats visuellement peu plausibles.

Efficacite de cout et scalabilite en production

Avec un cout d'environ 0,50 dollar par clip, Kling 3.0 represente l'option la plus economique pour la production a haut volume parmi les modeles haut de gamme. Lorsqu'il est utilise via des fournisseurs d'API comme ModelsLab, le prix tourne autour de 0,12 a 0,15 dollar par seconde de video generee, ce qui signifie qu'un clip de cinq secondes coute approximativement 0,60 a 0,75 dollar. Des tarifs degressifs existent pour les gros volumes, ce qui rend Kling 3.0 particulierement attractif pour les agences marketing, les equipes social media et les plateformes e-commerce qui doivent generer chaque mois des dizaines ou des centaines de videos produit.

Les temps de generation rapportes par les utilisateurs vont de deux a quinze minutes selon la complexite du prompt et la charge serveur. Meme si c'est plus lent que les 38 secondes annoncees pour Happy Horse 1.0 en 1080p, la difference importe moins dans des workflows de production batch ou plusieurs clips sont mis en file d'attente simultanement. La stabilite de l'API et la structure tarifaire previsible ont fait de Kling 3.0 l'ossature d'infrastructure de nombreuses applications de production qui exigent une qualite constante a l'echelle.

Motion Control et fonctions avancees

Kling 3.0 propose une fonction Motion Control qui merite une attention specifique. Les utilisateurs peuvent televerser une video de reference, en extraire le motif de mouvement, puis appliquer cette signature de mouvement a des sujets totalement differents. Par exemple, vous pouvez enregistrer un travelling de camera precis dans un espace physique, extraire ce profil de mouvement, puis l'appliquer a un paysage fantastique genere par IA. Cette capacite fait le pont entre les techniques de cinematographie traditionnelles et la generation IA, permettant aux realisateurs de conserver un controle creatif precis sur le travail de camera tout en exploitant l'IA pour la creation visuelle.

La variante Kling 3.0 Omni etend le modele de base avec des capacites multimodales renforcees et prend en charge le voice cloning, ou les utilisateurs associent une empreinte vocale specifique a un personnage avant la generation. Cela garantit des caracteristiques vocales coherentes d'une scene a l'autre, ce qui compte enormement pour les contenus narratifs, les personnages de marque et les series educatives dans lesquelles la reconnaissance de la voix aide a la comprehension et a l'engagement.

SkyReels V4 : la fondation multimodale unifiee

SkyReels V4 de Kunlun represente une approche architecturale fondamentalement différente. Plutot que d'optimiser un unique passage de generation, le modele adopte une architecture dual-stream Multimodal Diffusion Transformer dans laquelle une branche synthétise la video et l'autre genere un audio aligne temporellement, tandis que les deux partagent un encodeur de texte puissant base sur des Multimodal Large Language Models. Cette conception permet a SkyReels V4 d'accepter l'ensemble d'instructions multimodales le plus riche parmi les trois modeles : texte, images, clips video, masques et references audio peuvent etre combines dans des configurations arbitraires pour controler precisément la composition de la scene, l'apparence des personnages et l'atmosphere sonore.

Generation, inpainting et edition unifies

La caracteristique definitoire de SkyReels V4 est son traitement unifie de la generation, de l'inpainting et de l'edition au sein d'une seule architecture. Le modele utilise une formulation channel-concatenation qui gere la conversion image-to-video, l'extension de video et l'edition video chirurgicale au sein d'une interface unique. Cela signifie que vous pouvez generer une scene de base, puis utiliser un inpainting par masque pour remplacer des elements precis, changer la tenue d'un personnage, supprimer un filigrane ou remplacer un arriere-plan, sans avoir a regenerer l'integralite du clip.

Les implications pratiques sont substantielles. Les workflows de generation video traditionnels exigent des outils separes pour la creation et la modification : vous generez dans un systeme, vous exportez, vous editez dans une autre application et vous esperez que les retouches se fondront sans couture. SkyReels V4 condense ce pipeline dans un seul environnement ou les modifications se produisent dans le meme espace latent que la generation d'origine, ce qui garantit une coherence visuelle et elimine les artefacts de conversion de format.

Resolution, duree et strategie d'efficacite

SkyReels V4 prend en charge jusqu'a la resolution 1080p, 32 images par seconde et 15 secondes de duree, soit la plus longue duree de generation unique parmi les trois modeles compares ici. Pour rendre cette generation haute resolution et longue duree calculatoirement viable, le modele met en oeuvre une strategie d'efficacite ingenieuse. Il genere conjointement des sequences completes en basse resolution et des keyframes en haute resolution, puis applique des modeles dedies de super-resolution et d'interpolation d'images pour produire la sortie finale.

Cette approche keyframe-plus-superresolution ajoute des etapes de traitement par rapport a une generation directe, ce qui impacte le temps total de generation. Cependant, elle permet au modele de maintenir une coherence temporelle sur des durees plus longues que ce qu'autoriserait une generation directe en 1080p compte tenu des contraintes materielles actuelles. Pour les createurs qui produisent des contenus narratifs, des videos explicatives ou des sequences tutoriels ou des plans continus de 15 secondes ont une vraie valeur, ce compromis favorise SkyReels V4.

Positionnement dans les classements et accessibilite

SkyReels V4 a obtenu la deuxieme place sur l'Artificial Analysis Global Text-to-Video with Audio Leaderboard peu apres sa sortie en mars 2026, demontrant une qualite competitive face aux modeles etablis. En text-to-video sans audio, SkyReels V4 affiche un Elo de 1 244, soit un point seulement au-dessus du 1 243 de Kling 3.0 Pro. Cette quasi-parite en evaluation en aveugle suggere que les differences de qualite entre ces modeles se reduisent au point ou l'integration au workflow, la structure de prix et les besoins fonctionnels specifiques deviennent les facteurs de decision principaux.

SkyReels V4 est accessible via des fournisseurs d'API avec un tarif autour de 7,20 dollars par minute de video generee, ce qui le positionne entre PixVerse V6 a 5,40 dollars par minute et Kling 3.0 Pro a 13,44 dollars par minute. Cette structure tarifaire offre ce que plusieurs evaluateurs independants decrivent comme le meilleur rapport qualite-prix parmi les modeles accessibles a la date d'avril 2026.

Comparaison directe : specifications techniques

| Specification | Happy Horse 1.0 | Kling 3.0 | SkyReels V4 |

|---|---|---|---|

| Architecture | Transformer unifie de 15B de parametres, self-attention sur 40 couches, Dual-Branch DiT | Visual Chain-of-Thought, pipeline base sur la diffusion | Dual-stream Multimodal Diffusion Transformer (MMDiT) |

| Resolution | Jusqu'a 2K (1080p natif) | 4K native (3840x2160) | Jusqu'a 1080p |

| Frame Rate | Standard (30 fps implicites) | 60 fps | 32 fps |

| Max Duration | Sequences multi-shots | 10 a 15 secondes par clip | 15 secondes |

| Audio Generation | Synthese conjointe native, 7 langues | Natif avec voice cloning | Synthese conjointe native |

| Inference Speed | ~38 s pour 1080p (H100) | 2 a 15 minutes (varie selon la charge) | Plus long (approche keyframe + SR) |

| API Availability | Arrive le 30 avril 2026 | En direct depuis fevrier 2026 | En direct depuis mars 2026 |

| Pricing | TBA | ~0,50 $/clip, 0,12-0,15 $/seconde | ~7,20 $/minute |

| Open Source | Oui (modele complet + code) | Non | Partiel (statut des weights incertain) |

| Elo Rating (T2V no audio) | 1 361 | 1 247 | 1 244 |

Recommandations par cas d'usage : quel modele pour votre workflow ?

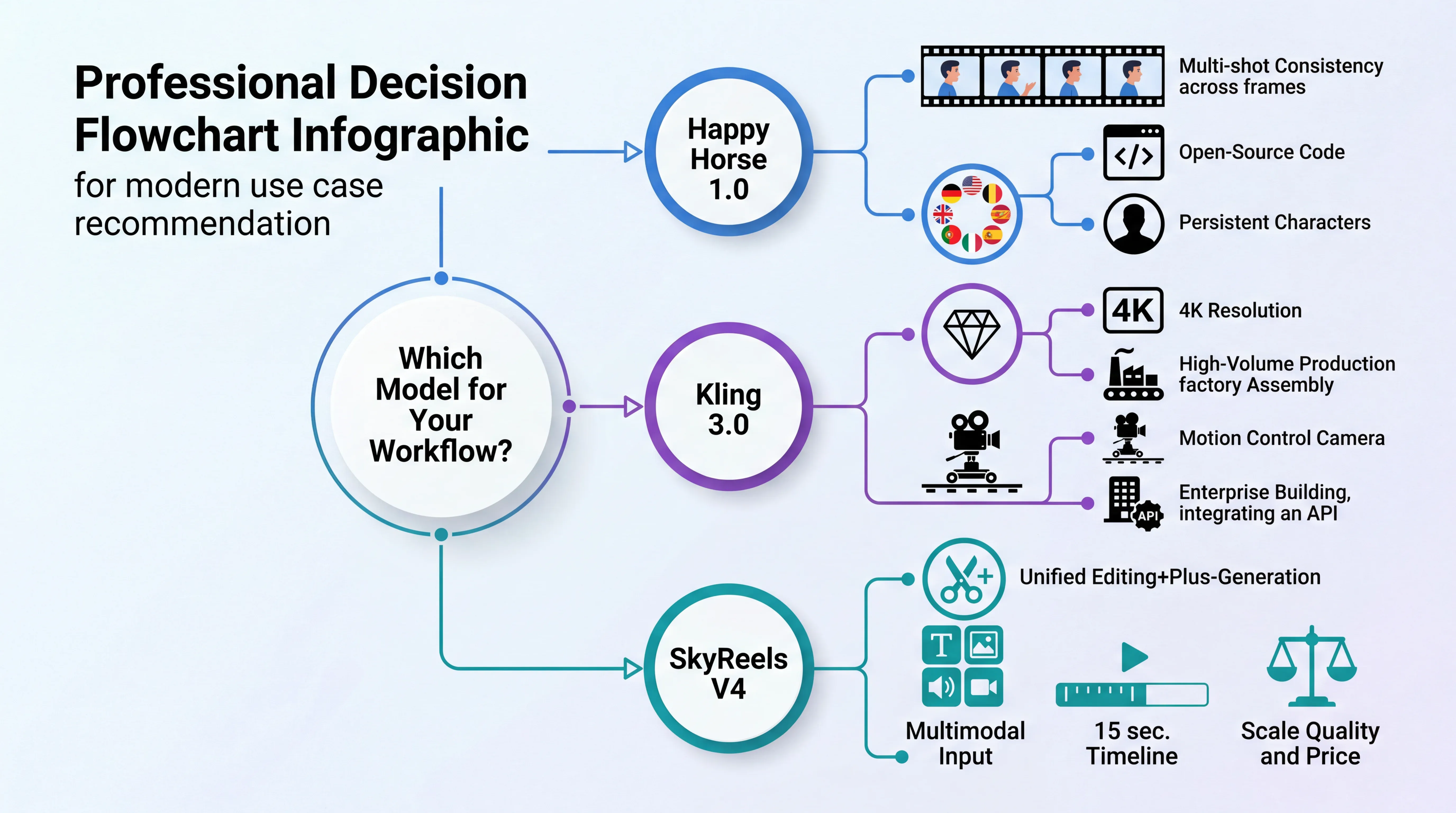

Choisissez Happy Horse 1.0 si vous avez besoin de

Contenus narratifs multi-shots avec des personnages persistants. La capacite de Happy Horse 1.0 a maintenir l'identite d'un personnage a travers les transitions de scene le rend particulierement adapte aux courts metrages, au storytelling de marque et aux series educatives ou la continuite visuelle compte davantage que la resolution maximale. La generation multi-shot native elimine le montage manuel autrement necessaire pour assembler des sequences coherentes a partir de clips isoles.

Une infrastructure self-hosted avec controle total du modele. Les entreprises soumises a des exigences de souverainete des donnees, a des styles visuels proprietaires necessitant du fine-tuning ou a des workflows imposant un traitement on-premise trouveront l'approche open source de Happy Horse 1.0 essentielle. La possibilite de modifier l'architecture du modele et le processus d'entrainement permet un niveau de personnalisation impossible avec des services exposes uniquement via API.

Des contenus multilingues avec dialogue synchronise. La capacite de lip-sync dans sept langues fait de Happy Horse 1.0 le choix le plus solide pour les createurs internationaux, les applications d'apprentissage des langues et les campagnes marketing mondiales ou une synchronisation labiale precise dans plusieurs langues reduit les couts de localisation.

La patience d'attendre l'API. Si votre calendrier de production s'etend au-dela du 30 avril 2026 et que vous pouvez attendre la disponibilite API officielle, la qualite de Happy Horse 1.0, leader des benchmarks, justifie ce delai. Pour des besoins de production immediats, Kling 3.0 et SkyReels V4 restent les choix les plus pragmatiques.

Choisissez Kling 3.0 si vous avez besoin de

La resolution maximale et une clarte de mouvement irreprochable. Quand une sortie 4K a 60 fps est non negociable, pour des demonstrations produit professionnelles, de la publicite haut de gamme, des courts metrages de niveau festival ou tout contenu dans lequel la fidelite visuelle influence directement la valeur percue de la marque, l'avantage de resolution native de Kling 3.0 l'emporte sur toutes les autres considerations.

Une production en grand volume a l'echelle. Les agences marketing qui generent chaque jour des dizaines de clips pour les reseaux sociaux, les plateformes e-commerce qui creent des videos produit pour des milliers de SKU et les studios de contenu qui produisent des series recurrentes beneficieront de l'efficacite economique de Kling 3.0, de la stabilite de son API et de ses capacites de batch processing. Le prix d'environ 0,50 dollar par clip rend la production a grande echelle economiquement viable.

Un controle precis du mouvement et de la cinematographie. Les realisateurs et directeurs de la photographie qui veulent appliquer des mouvements de camera specifiques, maintenir des signatures de mouvement coherentes sur plusieurs plans ou integrer du contenu genere par IA a des sequences tournees de facon traditionnelle trouveront la fonction Motion Control de Kling 3.0 indispensable. Cette capacite fait le lien entre les techniques de cinema professionnel et la generation IA d'une maniere que les autres modeles ne proposent pas encore.

Une infrastructure de production deja eprouvee. Les equipes qui construisent des applications orientees client, des produits SaaS avec generation video embarquee ou des pipelines de contenu automatises ont besoin de la fiabilite operationnelle qu'apportent deux mois de disponibilite API en direct, une documentation complete et plusieurs options de fournisseur. Kling 3.0 est devenu une infrastructure de production d'une maniere que Happy Horse 1.0 et SkyReels V4 n'ont pas encore totalement atteinte.

Choisissez SkyReels V4 si vous avez besoin de

De workflows unifies de generation et d'edition. Les createurs qui modifient frequemment des videos generees, en changeant des arriere-plans, des tenues de personnages, en supprimant des elements indesirables ou en prolongeant des scenes, beneficieront enormement des capacites integrees d'inpainting et d'edition de SkyReels V4. La possibilite d'effectuer des modifications chirurgicales dans le meme espace latent que la generation d'origine preserve une coherence visuelle impossible a atteindre avec des outils d'edition externes.

Un conditionnement multimodal complexe. Les projets qui exigent un controle precis via des combinaisons de descriptions textuelles, d'images de reference, de clips video, de masques et de guidage audio tireront parti de la richesse des modalites d'entree de SkyReels V4. Cela compte tout particulierement pour les contenus de marque soumis a des guidelines visuelles strictes, pour les recits portes par des personnages dont l'apparence et la voix doivent etre specifiques, ainsi que pour les demonstrations techniques ou la composition exacte de la scene est critique.

Des plans continus plus longs. La duree maximale de 15 secondes fait de SkyReels V4 le choix le plus solide pour les videos explicatives, les tutoriels, les scenes narratives qui demandent des prises plus longues et tout cas d'usage ou decouper le contenu en plusieurs clips plus courts nuirait a la comprehension du spectateur ou a son implication emotionnelle.

Le meilleur rapport qualite-prix parmi les options accessibles. Pour les equipes qui evaluent l'efficacite economique sur l'ensemble du pipeline de production, en incluant la generation, l'edition et les cycles d'iteration, le tarif de 7,20 dollars par minute de SkyReels V4 combine a ses capacites d'edition integrees aboutit souvent a un cout total inferieur a celui de services moins chers qui ne generent que la video et imposent ensuite des outils d'edition separes ainsi que des allers-retours supplementaires.

Benchmarks de performance : qualite du mouvement et simulation physique

Des tests independants menes dans de vrais workflows de production revelent des differences de performance fines qui comptent davantage que les scores Elo aggreges dans certains cas d'usage. D'apres des evaluations realisees en fevrier 2026, Seedance 2.0 obtient le meilleur score en realisme du mouvement avec 9,2 sur 10, suivi de pres par Kling 3.0 avec 9,0. Seedance excelle dans le cinematic motion smoothing, c'est-a-dire ces courbes subtiles d'acceleration et de deceleration qui donnent aux mouvements de camera une sensation de pilotage professionnel plutot qu'une linearite mecanique. Kling 3.0 mene en simulation physique naturelle, en particulier dans les scenarios impliquant gravite, inertie et proprietes materielles comme la dynamique des tissus ou le comportement des liquides.

La qualite du mouvement de Happy Horse 1.0 a ete validee a travers des comparaisons en aveugle sur l'arena, ou les utilisateurs ont regulierement classe ses sorties devant celles de Kling 3.0 et de Seedance 2.0 sans savoir quel modele avait genere chaque clip. Cela suggere que Happy Horse 1.0 atteint une qualite de mouvement qui depasse meme les scores de reference de 9,0 a 9,2, meme si des notes numeriques formelles restent en attente de tests independants en laboratoire.

La qualite du mouvement de SkyReels V4 se situe elle aussi de facon competitive dans ce groupe de tete, avec un Elo de 1 244 qui le place juste un point devant Kling 3.0 Pro. En pratique, a ce niveau de performance, les trois modeles evitent les artefacts les plus evidents, a savoir les objets qui se deforment, les visages qui derivent et les violations de la physique, qui plombaient les generations precedentes. Les ecarts restants se manifestent de maniere subtile : naturel du transfert de poids d'un personnage pendant une rotation, credibilite de la lumiere qui accroche des gouttes d'eau, ou reaction des plis du tissu aux mouvements du corps. Ces nuances comptent enormement pour les productions commerciales haut de gamme, mais elles peuvent rester imperceptibles dans des contenus social media visionnes sur mobile.

L'avantage plateforme de Happy Horse

Meme si cette comparaison se concentre sur le modele Happy Horse 1.0 lui-meme, il vaut la peine de noter que Happy Horse propose une approche plateforme unifiee qui repond a un point de douleur critique de la production video IA : la fragmentation des outils. Plutot que de gerer des abonnements distincts a Kling pour la 4K, a Seedance pour la qualite du mouvement et a SkyReels pour les capacites d'edition, Happy Horse fournit un acces integre a plusieurs modeles leaders dans un seul environnement de travail. Cette consolidation a de l'importance pour plusieurs raisons tres concretes.

D'abord, elle elimine la charge cognitive liee a l'apprentissage d'interfaces, de syntaxes de prompt et de systemes de parametres differents pour chaque modele. Un createur peut tester le meme prompt sur Happy Horse 1.0, Kling 3.0 et SkyReels V4 sans changer de plateforme, ce qui permet une iteration rapide et une comparaison directe de la qualite. Ensuite, elle simplifie la facturation et la gestion budgetaire : un abonnement, une facture et des couts predictibles, plutot qu'un suivi disperse sur plusieurs services aux structures tarifaires differentes. Enfin, elle permet d'optimiser le workflow en associant le bon modele au bon defi creatif : utiliser Kling 3.0 pour le hero shot qui exige la resolution maximale, Happy Horse 1.0 pour la sequence narrative qui demande une coherence de personnage et SkyReels V4 pour la scene qui exige une edition chirurgicale.

Cette approche plateforme reflete une tendance plus large vers l'agregation de modeles IA. De la meme maniere qu'aucun grand modele de langage ne domine tous les cas d'usage de generation de texte, aucun modele video ne sera excellent pour chaque defi creatif. L'avenir de la production video IA professionnelle passera probablement par un intelligent model routing, dans lequel le systeme selectionnera, ou recommandera, automatiquement le modele optimal en fonction de l'analyse du prompt, des contraintes budgetaires et des exigences de qualite. La plateforme integree de Happy Horse le positionne favorablement pour ce futur multi-modeles.

Limites et considerations communes a tous les modeles

Malgre les progres remarquables du debut de 2026, les trois modeles partagent encore certaines limites que les createurs doivent comprendre avant de les engager dans des workflows de production. La simulation physique dans des scenarios complexes, notamment le comportement du feu, la dynamique de l'eau avec plusieurs flux en interaction et la dechirure de tissus, se degrade encore parfois d'une maniere qui produit des resultats visuellement peu plausibles. Les interactions multi-personnages, en particulier les scenes avec trois personnages ou plus engages dans des actions coordonnees, ont tendance a generer des artefacts visuels ou les membres se croisent incorrectement et ou les relations spatiales deviennent confuses.

La coherence d'un meme personnage d'une video a l'autre reste un probleme non resolu. Si Happy Horse 1.0 maintient l'identite d'un personnage a l'interieur d'une seule generation multi-shots, et si SkyReels V4 peut utiliser des images de reference pour guider l'apparence d'un personnage, aucun modele ne parvient encore a produire de maniere fiable exactement le meme personnage sur des sessions de generation entierement separees sans prompt engineering soigne et sans gestion rigoureuse des images de reference. Cette limite compte pour les contenus en serie, les personnages de marque recurrents et toute application qui exige un casting stable sur plusieurs episodes ou campagnes.

Le paysage du copyright exige lui aussi de l'attention. En mars 2026, la Cour supreme des Etats-Unis a refuse d'examiner l'appel dans l'affaire Thaler v. Perlmutter, confirmant de fait la decision selon laquelle un contenu entierement genere par IA n'est pas eligible a la protection du copyright. Cela signifie que n'importe qui peut legalement copier et utiliser vos videos generees par IA, et que vous ne pouvez pas revendiquer la propriete du copyright. Pour les entreprises dont le modele economique depend de l'exclusivite du contenu, cela represente un risque strategique qui doit etre attenue par davantage d'intervention creative humaine, une post-production substantielle ou d'autres protections juridiques comme la marque et le trade dress.

Conclusion : l'avenir multi-modeles de la production video IA

La concurrence entre Happy Horse 1.0, Kling 3.0 et SkyReels V4 revele un secteur en maturation dans lequel les differences de qualite se sont reduites au point ou l'integration au workflow, les besoins fonctionnels specifiques et la structure de cout comptent souvent davantage que les scores bruts de benchmark. Happy Horse 1.0 mene les evaluations de qualite en aveugle et offre une flexibilite open source inegalee, mais reste sans acces API de production jusqu'a fin avril 2026. Kling 3.0 fournit la plus haute resolution native, une fiabilite d'infrastructure deja prouvee et la tarification la plus economique pour la production en grand volume. SkyReels V4 offre l'ensemble d'entrees multimodales le plus riche, des capacites d'edition integrees et la plus longue duree de generation unique.

Pour la plupart des equipes de production, la strategie optimale ne consiste pas a choisir un seul modele, mais a mettre au point des workflows qui exploitent les forces de chacun. Utilisez Kling 3.0 pour les hero shots et les livrables haute resolution. Deployez Happy Horse 1.0 pour les sequences narratives qui exigent une coherence de personnage une fois l'API disponible. Utilisez SkyReels V4 pour les contenus qui demandent une edition chirurgicale et un conditionnement multimodal complexe. Cette approche multi-modeles, facilitee par des plateformes comme Happy Horse qui integrent plusieurs modeles dans une interface unifiee, represente la voie la plus pragmatique dans une industrie ou aucune solution unique ne domine tous les cas d'usage.

L'espace de la generation video par IA continuera d'evoluer rapidement tout au long de 2026. Les benchmarks qui definissent aujourd'hui l'etat de l'art seront probablement consideres comme milieu de gamme d'ici le troisieme trimestre 2026. Les modeles compares ici publieront de nouvelles versions, de nouveaux concurrents emergeront et des innovations architecturales redistribueront les hierarchies de performance. Ce qui restera constant, c'est la necessite pour les createurs de faire correspondre les capacites des outils aux bons defis creatifs, de maintenir des workflows flexibles et de privilegier la fiabilite de production plutot que les classements de benchmark. L'avenir de la video IA n'appartient pas a un vainqueur unique, mais a un ecosysteme d'outils specialises, et gagneront ceux qui sauront les orchestrer intelligemment.

Pret a decouvrir le futur de la generation video par IA ? Rendez-vous sur Happy Horse pour acceder a Happy Horse 1.0, Kling 3.0, SkyReels V4 et d'autres modeles de pointe dans une plateforme unifiee. Creez aujourd'hui votre premiere video cinematographique grace a nos outils de workflow integres et a un intelligent model routing.