A comienzos de 2026, el mapa del video IA cambió de forma visible. Happy Horse 1.0 apareció en Artificial Analysis Video Arena y superó de inmediato a Veo 3.1, Sora 2 Pro y Runway Gen-4.5. Lo importante no es solo la velocidad del ascenso, sino que ocurriera en comparaciones ciegas de preferencia.

Veo 3.1 sigue siendo, sin embargo, uno de los referentes de gama alta. Google DeepMind lo empuja como una opción premium para quienes exigen fotorealismo, estabilidad temporal y una ruta real hacia 4K. En otras palabras, no estamos comparando simplemente “el nuevo” contra “el viejo”, sino dos filosofías distintas.

Lo que realmente importa es esto:

- qué arquitectura resuelve mejor el problema;

- quién manda hoy en los benchmarks públicos;

- qué modelo sincroniza mejor audio y video;

- cuál escala mejor en velocidad y coste;

- cuál encaja mejor con tu trabajo real.

Por qué Happy Horse 1.0 destaca

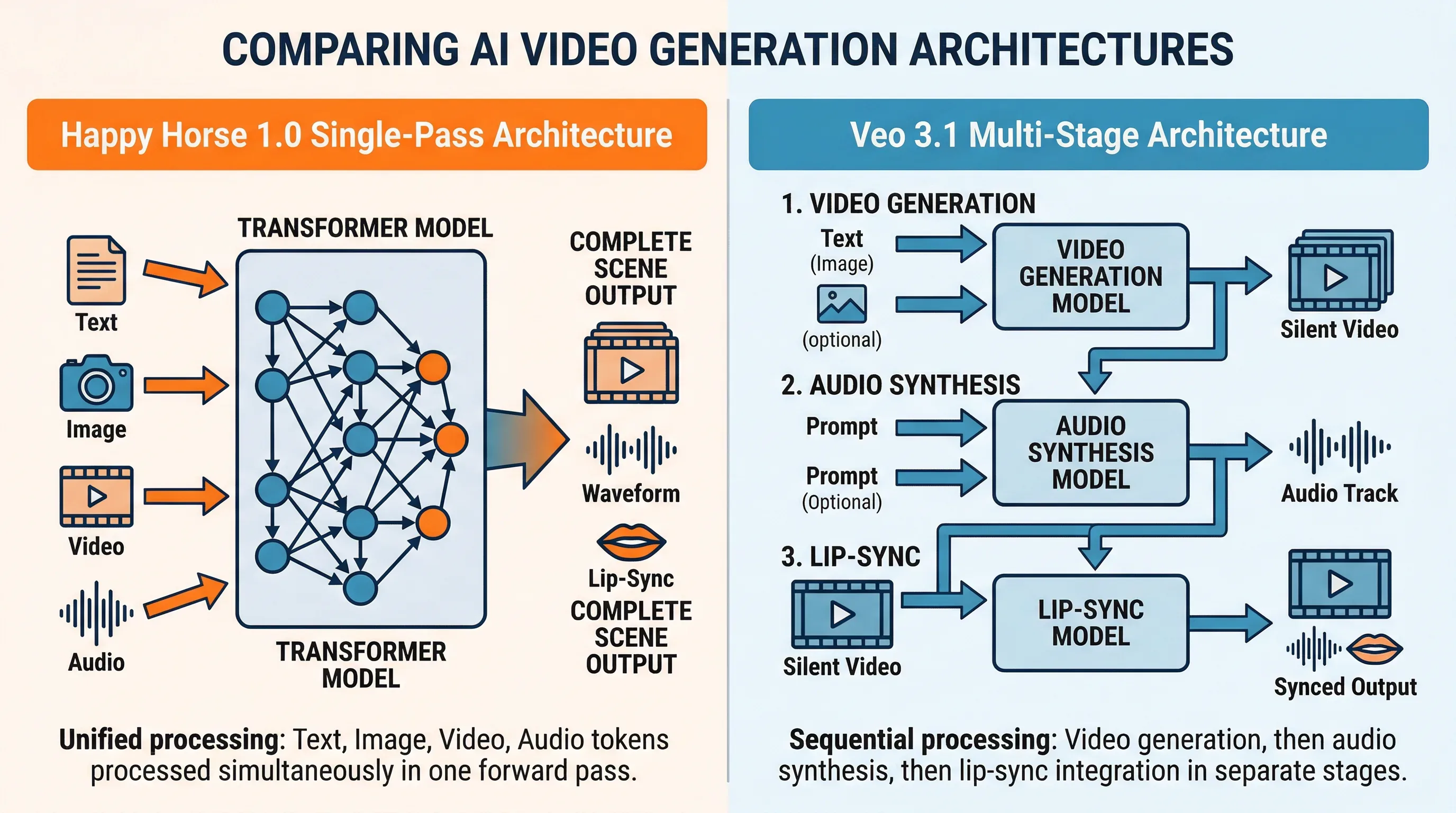

Happy Horse 1.0 se basa en un Transformer unificado de 15 mil millones de parámetros y 40 capas de self-attention. Su diferencia clave es la generación conjunta de audio y video en un solo forward pass.

La mayoría de los competidores generan primero un video mudo y luego añaden voz, lip-sync, ambiente y Foley en etapas separadas. Happy Horse procesa texto, imagen, video y audio dentro de la misma secuencia. Eso mejora la coherencia entre labios, diálogo, sonido ambiente y acción.

También presume de velocidad. Con DMD-2 distillation y MagiCompiler, los datos públicos apuntan a unos 2 segundos para un clip de 5 segundos en 256p y unos 38 segundos para un video 1080p en H100. Para equipos que iteran mucho, esto importa.