El panorama de la generación de video con IA ha sufrido un cambio sísmico a comienzos de 2026. Lo que antes era un terreno de juego de herramientas experimentales que producían clips borrosos y cargados de artefactos ha madurado hasta convertirse en una arena competitiva en la que tres modelos dominan ahora los leaderboards: Happy Horse 1.0, Kling 3.0 y SkyReels V4. Cada uno representa una filosofía arquitectónica distinta, y cada uno sobresale en escenarios de producción específicos que sí importan a creadores, marketers y cineastas. Esta guía exhaustiva desglosa sus fundamentos técnicos, su rendimiento en el mundo real y sus aplicaciones prácticas para ayudarte a elegir el modelo adecuado para tu workflow.

El nuevo benchmark: que cambió en 2026

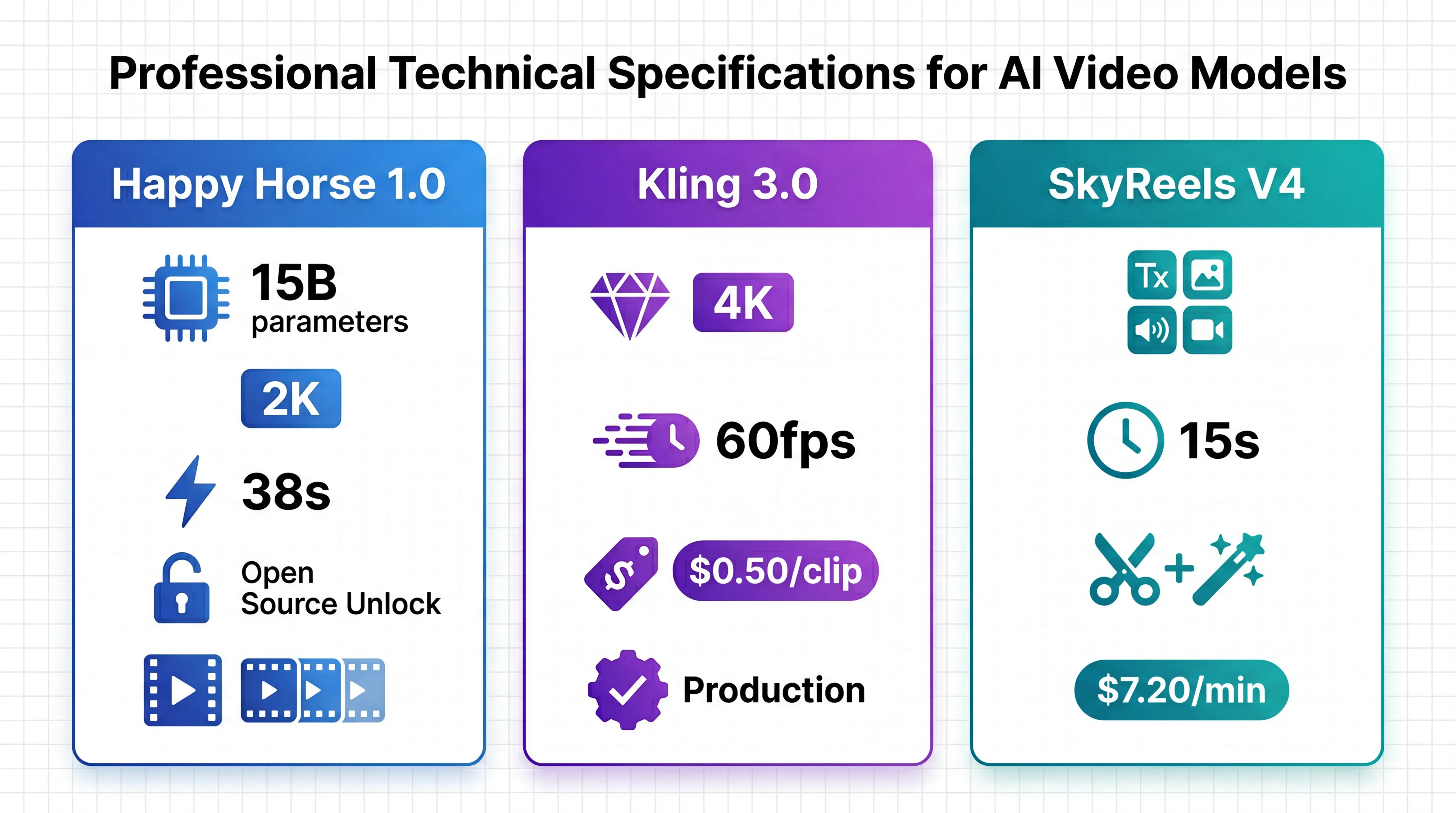

La generación de video con IA cruzó un umbral crítico a comienzos de 2026. La generación conjunta nativa de audio y video, que hace solo doce meses existía únicamente en papers de investigación, se ha convertido en una capacidad lista para producción en los tres modelos. Las capacidades de resolución también han dado un salto drástico. Kling 3.0 ya ofrece salida nativa en 4K a 60fps, mientras que Happy Horse 1.0 entrega video 2K con calidad cinematográfica en aproximadamente 38 segundos sobre hardware H100. Los benchmarks de calidad de movimiento también se han estrechado hasta el punto en que evaluadores independientes puntúan a Seedance 2.0 con 9,2 sobre 10 en realismo del movimiento, con Kling 3.0 siguiéndolo muy de cerca con 9,0.

La dinámica competitiva también ha cambiado de forma fundamental. Happy Horse 1.0 apareció de manera anónima en Artificial Analysis Video Arena a comienzos de abril de 2026 y ascendió rápidamente hasta la posición número uno con un Elo de 1.361 en text-to-video sin audio, superando a jugadores consolidados como Seedance 2.0 y Kling 3.0. Esta metodología de evaluación ciega, en la que los usuarios votan resultados sin saber qué modelo generó cada clip, proporciona la señal de calidad más objetiva disponible hoy. El hecho de que Happy Horse 1.0 haya superado de forma consistente tanto a Kling 3.0 como a SkyReels V4 en comparaciones lado a lado revela ventajas arquitectónicas reales, y no simple hype de marketing.

Happy Horse 1.0: el disruptor de código abierto

Happy Horse 1.0 representa el primer desafío serio al dominio del closed source en generación de video con IA. Construido sobre una arquitectura Transformer unificada de 15 mil millones de parámetros con 40 capas de self-attention, el modelo procesa de forma nativa tokens de texto, imagen, video y audio dentro de un único forward pass. Esta decisión arquitectónica elimina los artefactos de sincronización que aquejan a las pipelines de varias etapas, donde el video y el audio se generan por separado y luego se alinean en postproducción.

Arquitectura técnica y rendimiento

El modelo emplea DMD-2 distillation, una técnica que reduce el proceso de denoising a solo ocho pasos sin requerir classifier-free guidance. Esta optimización ofrece velocidades de inferencia extraordinarias: aproximadamente dos segundos para un clip de cinco segundos a resolución 256p, y alrededor de 38 segundos para salida 1080p completa sobre hardware H100. Cuando se compara directamente con sus competidores más cercanos, Happy Horse 1.0 genera video 2K un 30 por ciento más rápido que Seedance 1.5 Pro y un 29 por ciento más rápido que Kling 2.1.

La arquitectura Dual-Branch DiT merece atención especial. Una rama se encarga de la síntesis visual, mientras que la otra genera audio temporalmente alineado, y ambas comparten un encoder de texto unificado. Este diseño permite al modelo mantener una identidad de personaje persistente a lo largo de múltiples planos, una capacidad que lo distingue de generadores de toma única como Sora, Runway o las implementaciones estándar de Kling. Cuando se le da a Happy Horse 1.0 una descripción narrativa, crea automáticamente secuencias de escenas coherentes en lugar de clips aislados, reduciendo de forma drástica la edición manual necesaria para ensamblar una historia completa.

Lip-sync multilingüe y capacidades de audio

Happy Horse 1.0 soporta generación conjunta nativa de audio y video en siete idiomas: chino, inglés, japonés, coreano, alemán, francés y cantonés. El modelo alcanza lo que su documentación describe como un lip-sync con WER ultrabajo, donde WER se refiere a Word Error Rate, una métrica heredada del reconocimiento de voz que mide con qué precisión los movimientos de los labios corresponden a los fonemas pronunciados. Aunque la verificación independiente de estas afirmaciones sobre WER sigue pendiente, los outputs visibles en Artificial Analysis muestran una sincronización convincente en casos de prueba en inglés y chino.

La generación de audio va más allá del diálogo e incluye sonidos ambientales y efectos Foley. Cuando generas una escena de lluvia cayendo sobre una calle de ciudad, el modelo produce no solo el visual de las gotas, los reflejos sobre el pavimento mojado y el entorno urbano, sino también el paisaje sonoro en capas de la lluvia, el tráfico lejano y la firma acústica específica del agua golpeando superficies distintas. Este nivel de integración audiovisual elimina un paso completo del workflow de postproducción que tradicionalmente exigía herramientas independientes de diseño sonoro.

La ventaja de código abierto y las limitaciones actuales

Happy Horse 1.0 se distribuye como un paquete completamente open source que incluye el modelo base, el modelo destilado, el módulo de superresolución y el código completo de inferencia. Este enfoque de licenciamiento permite self-hosting y fine-tuning para casos de uso personalizados, una capacidad que importa enormemente a empresas con directrices de marca específicas, estilos visuales propietarios o requisitos de soberanía de datos. El modelo supera a Seedance 2.0, Ovi 1.1 y LTX 2.3 en el leaderboard de Artificial Analysis Video Arena, consolidándose como la opción open-weights de mayor calidad disponible a mediados de abril de 2026.

Sin embargo, existe una brecha crítica entre el rendimiento en benchmarks y la accesibilidad para producción. A fecha de 18 de abril de 2026, Happy Horse 1.0 no tenía una API pública disponible. El equipo oficial anunció en redes sociales que el acceso por API se lanzaría el 30 de abril de 2026 y advirtió que ya habían aparecido múltiples sitios fraudulentos afirmando ofrecer ese acceso. Esto significa que el modelo número uno del leaderboard global sigue siendo inaccesible para workflows de producción, creando un dilema estratégico para los equipos que evalúan hoy su infraestructura de generación de video.

Kling 3.0: el benchmark listo para producción

Kling 3.0, de Kuaishou, se ha consolidado como el estándar production-grade de la generación de video con IA gracias a dos meses de disponibilidad real por API, documentación exhaustiva y un rendimiento consistente a escala. El modelo opera sobre una arquitectura Visual Chain-of-Thought que descompone prompts complejos en pasos secuenciales de razonamiento, permitiendo una interpretación más precisa de escenas con múltiples elementos, movimientos de cámara concretos, condiciones de iluminación e interacciones entre personajes.

Salida nativa en 4K y calidad de movimiento

El diferenciador más visible de Kling 3.0 es su salida nativa en 4K a 60 fotogramas por segundo, la mayor resolución nativa entre todos los grandes modelos de video con IA a febrero de 2026. No se trata de contenido 1080p reescalado, sino de renderizado real en 3840x2160 sin la suavidad ni los artefactos que caracterizan a la mejora de resolución aplicada después de la generación. La tasa de 60fps elimina el AI stutter presente en modelos anteriores de 24fps y 30fps, haciendo que Kling 3.0 resulte especialmente eficaz para secuencias de acción rápida, contenido deportivo y demostraciones de producto profesionales donde la claridad del movimiento impacta directamente en la calidad percibida.

Los benchmarks independientes sitúan de forma consistente a Kling 3.0 entre los mejores en calidad de movimiento. Videógrafos profesionales lo han descrito como "probablemente el modelo de video generalista más capaz disponible en este momento" y como "state-of-the-art en términos globales" en movimiento natural y simulación física. El modelo sobresale en escenarios que requieren interacciones físicas realistas, como objetos chocando, líquidos vertiéndose o telas reaccionando al viento, justo donde modelos anteriores producían resultados visualmente implausibles.

Eficiencia de costes y escalabilidad de producción

A aproximadamente 0,50 dólares por clip, Kling 3.0 representa la opción más rentable para producción de alto volumen entre los modelos de primer nivel. Cuando se accede a través de proveedores de API como ModelsLab, el precio se sitúa aproximadamente entre 0,12 y 0,15 dólares por segundo de video generado, lo que significa que un clip de cinco segundos cuesta en torno a 0,60 a 0,75 dólares. Existe además pricing por volumen para usuarios de gran escala, lo que hace que Kling 3.0 resulte especialmente atractivo para agencias de marketing, equipos de contenido para redes sociales y plataformas de e-commerce que necesitan generar decenas o cientos de videos de producto cada mes.

Los tiempos de generación reportados por usuarios oscilan entre dos y quince minutos en función de la complejidad del prompt y de la carga del servidor. Aunque esto es más lento que los 38 segundos que Happy Horse 1.0 afirma para 1080p, la diferencia importa menos en workflows de producción por lotes donde se encolan varios clips de forma simultánea. La estabilidad de la API y la estructura de precios predecible han convertido a Kling 3.0 en la columna vertebral de infraestructura para numerosas aplicaciones de producción que requieren calidad consistente a escala.

Motion Control y funciones avanzadas

Kling 3.0 ofrece una función Motion Control que merece atención específica. Los usuarios pueden subir un video de referencia, extraer su patrón de movimiento y aplicar esa firma de movimiento a sujetos completamente distintos. Por ejemplo, puedes registrar un movimiento concreto de cámara dolly a través de un espacio físico, extraer ese perfil de movimiento y después aplicarlo a un paisaje fantástico generado por IA. Esta capacidad tiende un puente entre las técnicas tradicionales de cinematografía y la generación con IA, permitiendo a los directores mantener un control creativo preciso sobre el trabajo de cámara mientras aprovechan la IA para la creación visual.

La variante Kling 3.0 Omni amplía el modelo base con capacidades multimodales mejoradas, incluyendo voice cloning, donde los usuarios vinculan un perfil de voz concreto a un personaje antes de generar. Esto garantiza características vocales consistentes a lo largo de múltiples escenas, algo que importa enormemente para contenido narrativo, personajes de marca y series educativas donde el reconocimiento de la voz mejora tanto la comprensión como el engagement.

SkyReels V4: la base multimodal unificada

SkyReels V4, de Kunlun, representa un enfoque arquitectónico fundamentalmente diferente. En lugar de optimizar una única pasada de generación, el modelo adopta una arquitectura dual-stream Multimodal Diffusion Transformer en la que una rama sintetiza video y la otra genera audio temporalmente alineado, mientras ambas comparten un potente encoder de texto basado en multimodal large language models. Este diseño permite a SkyReels V4 aceptar el conjunto más rico de instrucciones multimodales entre los tres modelos: texto, imágenes, clips de video, máscaras y referencias de audio pueden combinarse en configuraciones arbitrarias para controlar con precisión la composición de la escena, la apariencia de los personajes y la atmósfera sonora.

Generación, inpainting y edición en un mismo sistema

La característica definitoria de SkyReels V4 es su tratamiento unificado de la generación, el inpainting y la edición dentro de una única arquitectura. El modelo emplea una formulación de channel-concatenation que resuelve la conversión image-to-video, la extensión de video y la edición quirúrgica de video bajo una sola interfaz. Esto significa que puedes generar una escena base y luego usar inpainting basado en máscaras para intercambiar elementos específicos, cambiar el outfit de un personaje, eliminar una marca de agua o sustituir un fondo, sin regenerar el clip completo.

Las implicaciones prácticas son sustanciales. Los workflows tradicionales de generación de video requieren herramientas separadas para creación y modificación: generas en un sistema, exportas, editas en otra aplicación y esperas que los cambios se integren con naturalidad. SkyReels V4 colapsa esa pipeline en un único entorno donde las modificaciones se producen dentro del mismo latent space que la generación original, garantizando consistencia visual y eliminando artefactos de conversión de formato.

Resolución, duración y estrategia de eficiencia

SkyReels V4 soporta hasta 1080p de resolución, 32 fotogramas por segundo y 15 segundos de duración, la mayor duración de generación única entre los tres modelos comparados aquí. Para hacer viable esa generación larga y de alta resolución desde el punto de vista computacional, el modelo emplea una estrategia de eficiencia inteligente: genera de forma conjunta secuencias completas en baja resolución y keyframes en alta resolución, y luego aplica modelos dedicados de superresolución e interpolación de frames para producir la salida final.

Este enfoque de keyframes más superresolución añade pasos de procesamiento en comparación con la generación directa, lo que impacta el tiempo total de generación. Sin embargo, permite al modelo mantener consistencia temporal a lo largo de duraciones más extensas de lo que sería posible con generación 1080p directa dadas las restricciones actuales de hardware. Para creadores que producen contenido narrativo, videos explicativos o secuencias tutoriales en las que los planos continuos de 15 segundos son valiosos, este trade-off favorece a SkyReels V4.

Posición en leaderboard y accesibilidad

SkyReels V4 aseguró la posición número dos en el Artificial Analysis Global Text-to-Video with Audio Leaderboard poco después de su lanzamiento en marzo de 2026, demostrando calidad competitiva frente a modelos ya establecidos. En text-to-video sin audio, SkyReels V4 se sitúa con Elo 1.244, apenas un punto por encima del 1.243 de Kling 3.0 Pro. Esta casi paridad en evaluación ciega sugiere que las diferencias de calidad entre estos modelos se están estrechando hasta el punto en que la integración en el workflow, la estructura de precios y los requisitos funcionales concretos se convierten en los factores de decisión principales.

SkyReels V4 es accesible a través de proveedores de API con un precio de alrededor de 7,20 dólares por minuto de video generado, situándose entre PixVerse V6, con 5,40 dólares por minuto, y Kling 3.0 Pro, con 13,44 dólares por minuto. Esta estructura de precios ofrece lo que múltiples evaluadores independientes describen como la mejor relación calidad-precio entre los modelos accesibles a fecha de abril de 2026.

Comparativa cara a cara: especificaciones técnicas

| Especificación | Happy Horse 1.0 | Kling 3.0 | SkyReels V4 |

|---|---|---|---|

| Arquitectura | Transformer unificado de 15B parámetros, 40 capas de self-attention, Dual-Branch DiT | Visual Chain-of-Thought, pipeline basado en difusión | Dual-stream Multimodal Diffusion Transformer (MMDiT) |

| Resolución | Hasta 2K (1080p nativo) | 4K nativo (3840x2160) | Hasta 1080p |

| Frame rate | Estándar (30fps implícitos) | 60fps | 32fps |

| Duración máxima | Secuencias multi-shot | 10-15 segundos por clip | 15 segundos |

| Generación de audio | Síntesis conjunta nativa, 7 idiomas | Nativa con voice cloning | Síntesis conjunta nativa |

| Velocidad de inferencia | ~38 s para 1080p (H100) | 2-15 minutos (varía según la carga) | Más lenta (enfoque de keyframes + SR) |

| Disponibilidad de API | Llega el 30 de abril de 2026 | Activa desde febrero de 2026 | Activa desde marzo de 2026 |

| Precio | Pendiente por anunciar | ~0,50 US$/clip, 0,12-0,15 US$/segundo | ~7,20 US$/minuto |

| Open source | Sí (modelo completo + código) | No | Parcial (estado de los pesos no del todo claro) |

| Elo (T2V sin audio) | 1.361 | 1.247 | 1.244 |

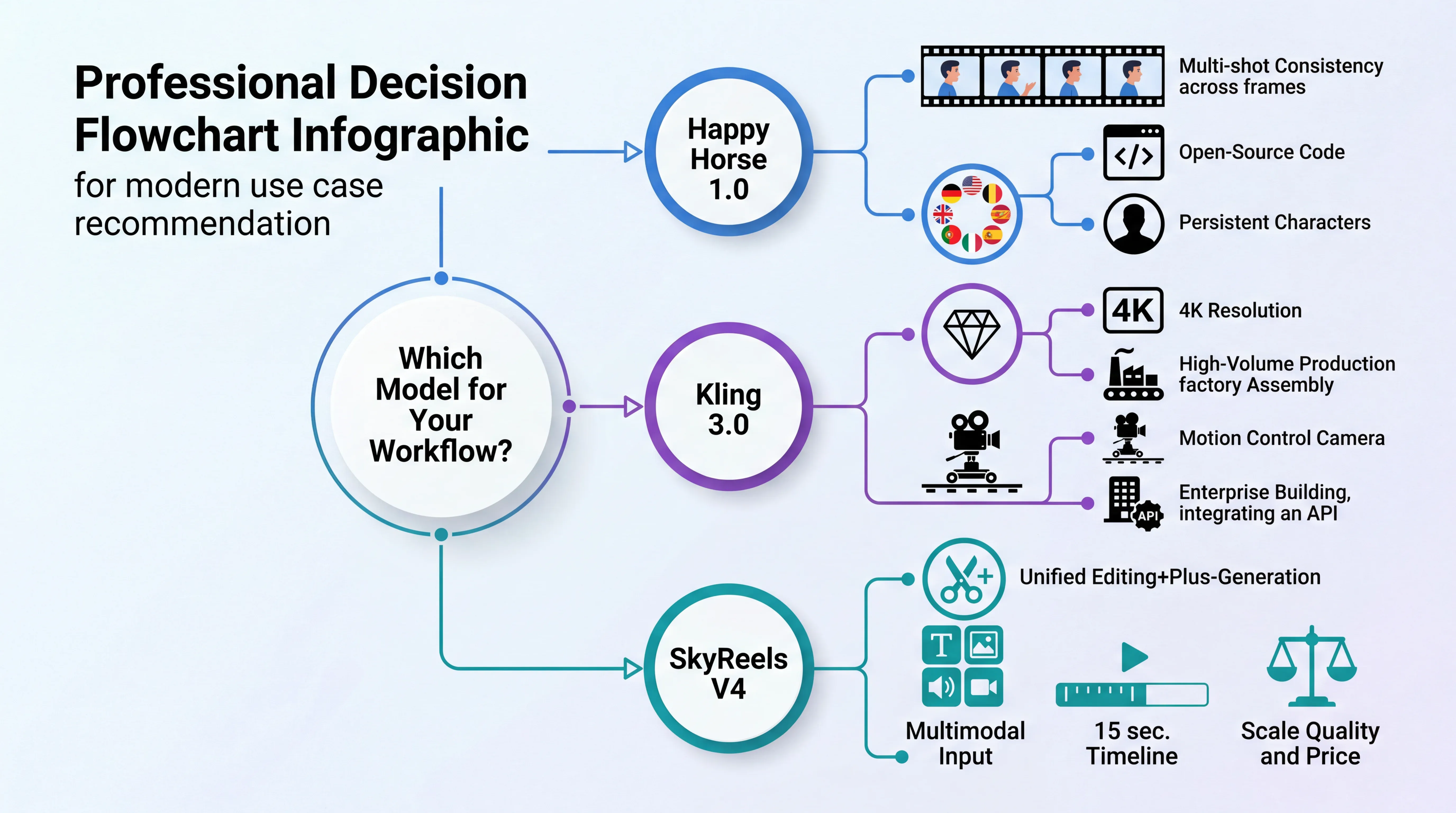

Recomendaciones por caso de uso: qué modelo elegir para tu workflow

Elige Happy Horse 1.0 si necesitas

Contenido narrativo multi-shot con personajes persistentes. La capacidad de Happy Horse 1.0 para mantener la identidad del personaje a través de transiciones de escena lo hace especialmente adecuado para cortometrajes, branded storytelling y series educativas en las que la continuidad visual importa más que la resolución máxima. La generación nativa multi-shot elimina la edición manual necesaria para ensamblar secuencias coherentes a partir de clips aislados.

Infraestructura self-hosted con control total del modelo. Las empresas con requisitos de soberanía de datos, estilos visuales propietarios que exigen fine-tuning o workflows que demandan procesamiento on-premise encontrarán esencial la licencia open source de Happy Horse 1.0. La capacidad de modificar la arquitectura del modelo y su proceso de entrenamiento permite un nivel de personalización imposible con servicios exclusivamente basados en API.

Contenido multilingüe con diálogo sincronizado. La capacidad de lip-sync en siete idiomas convierte a Happy Horse 1.0 en la opción más sólida para creadores internacionales, aplicaciones de aprendizaje de idiomas y campañas globales de marketing donde una sincronización labial precisa en múltiples lenguas reduce los costes de localización.

Paciencia para esperar el acceso por API. Si tu calendario de producción se extiende más allá del 30 de abril de 2026 y puedes esperar al lanzamiento oficial de la API, la calidad líder en benchmarks de Happy Horse 1.0 justifica la espera. Para necesidades productivas inmediatas, Kling 3.0 o SkyReels V4 siguen siendo las opciones prácticas.

Elige Kling 3.0 si necesitas

Máxima resolución y claridad de movimiento. Cuando la salida 4K a 60fps es innegociable, ya sea para demostraciones profesionales de producto, campañas publicitarias premium, cortometrajes con nivel de festival o cualquier pieza en la que la fidelidad visual afecte directamente al valor percibido de la marca, la ventaja de resolución nativa de Kling 3.0 supera al resto de consideraciones.

Producción de alto volumen a escala. Agencias de marketing que generan decenas de clips sociales al día, plataformas de e-commerce que crean videos de producto para miles de SKUs y estudios de contenido que producen series recurrentes se benefician de la eficiencia de costes, la estabilidad de la API y las capacidades de batch processing de Kling 3.0. El precio de unos 0,50 dólares por clip hace económicamente viable la producción a gran escala.

Control preciso del movimiento y de la cinematografía. Directores y directores de fotografía que quieren aplicar movimientos de cámara concretos, mantener firmas de movimiento consistentes entre múltiples planos o integrar contenido generado por IA con secuencias filmadas de forma tradicional encontrarán indispensable la función Motion Control de Kling 3.0. Esta capacidad conecta técnicas de filmmaking profesional con generación por IA de un modo que los otros modelos todavía no ofrecen con la misma claridad.

Infraestructura de producción probada. Los equipos que construyen aplicaciones orientadas al cliente, productos SaaS con generación de video embebida o pipelines de contenido automatizados necesitan la fiabilidad operativa que ofrecen dos meses de disponibilidad real de API, documentación exhaustiva y múltiples opciones de proveedor. Kling 3.0 ya se ha convertido en infraestructura de producción de una manera que Happy Horse 1.0 y SkyReels V4 todavía no habían alcanzado en la fecha descrita.

Elige SkyReels V4 si necesitas

Workflows unificados de generación y edición. Los creadores que modifican con frecuencia videos generados, cambiando fondos, sustituyendo vestuario, eliminando elementos no deseados o extendiendo escenas, se benefician enormemente de las capacidades integradas de inpainting y edición de SkyReels V4. La posibilidad de hacer modificaciones quirúrgicas dentro del mismo latent space que la generación original mantiene una consistencia visual imposible de igualar con herramientas externas de edición.

Condicionamiento multimodal complejo. Los proyectos que requieren control preciso mediante combinaciones de descripciones de texto, imágenes de referencia, clips de video, máscaras y guías de audio pueden aprovechar la riqueza de modalidades de entrada de SkyReels V4. Esto importa para branded content con directrices visuales estrictas, narrativas centradas en personajes que exigen apariencias y voces concretas, y demostraciones técnicas donde la composición exacta de la escena es crítica.

Planos continuos más largos. El máximo de 15 segundos convierte a SkyReels V4 en la opción más sólida para videos explicativos, contenido tutorial, escenas narrativas que requieren tomas extendidas y cualquier aplicación en la que cortar entre clips más cortos interrumpiría la comprensión del espectador o su implicación emocional.

La mejor relación calidad-precio entre las opciones accesibles. Para equipos que evalúan la eficiencia de costes a lo largo de toda la pipeline de producción, incluyendo generación, edición y ciclos de iteración, el precio de 7,20 dólares por minuto de SkyReels V4 combinado con sus capacidades integradas de edición suele traducirse en un coste total inferior al de servicios más baratos de solo generación que luego obligan a usar herramientas externas y a repetir más rondas de trabajo.

Benchmarks de rendimiento: calidad del movimiento y simulación física

Las pruebas independientes realizadas sobre workflows de producción reales revelan diferencias matizadas de rendimiento que importan más que las puntuaciones Elo agregadas cuando se habla de casos de uso específicos. Según evaluaciones realizadas en febrero de 2026, Seedance 2.0 obtiene la nota más alta en realismo del movimiento con 9,2 sobre 10, seguido muy de cerca por Kling 3.0 con 9,0. Seedance destaca en cinematic motion smoothing, esas sutiles curvas de aceleración y desaceleración que hacen que un movimiento de cámara parezca operado por un profesional en lugar de seguir una trayectoria mecánicamente lineal. Kling 3.0 lidera en simulación física natural, especialmente en escenarios que implican gravedad, impulso y propiedades de materiales como el comportamiento de telas o líquidos.

La calidad de movimiento de Happy Horse 1.0 ha quedado validada a través de comparaciones ciegas en la arena, donde los usuarios clasificaron sus outputs por encima de Kling 3.0 y Seedance 2.0 sin saber qué modelo había generado cada clip. Esto sugiere que Happy Horse 1.0 alcanza una calidad de movimiento que supera incluso el rango de 9,0 a 9,2 de esos benchmarks, aunque todavía sigan pendientes valoraciones numéricas formales por parte de laboratorios independientes.

La calidad de movimiento de SkyReels V4 también se sitúa de forma competitiva dentro de este tier superior, con su Elo de 1.244 colocándolo apenas un punto por encima de Kling 3.0 Pro. La diferencia práctica a este nivel de rendimiento es que los tres modelos evitan los artefactos más obvios, como objetos que se deforman, rostros que se deslizan o violaciones físicas, que plagaban generaciones anteriores. Las brechas de calidad restantes se manifiestan de formas sutiles: lo natural que resulta el cambio de peso de un personaje al girarse, si las gotas de agua capturan la luz de manera convincente, o cómo responden los pliegues de una tela al movimiento del cuerpo. Estos matices importan enormemente en trabajo comercial de alto nivel, pero pueden pasar desapercibidos en contenido social consumido en móvil.

La ventaja de plataforma de Happy Horse

Aunque esta comparación se ha centrado en el propio modelo Happy Horse 1.0, merece la pena señalar que Happy Horse ofrece un enfoque de plataforma unificada que resuelve un punto de dolor crítico en la producción de video con IA: la fragmentación de herramientas. En lugar de gestionar suscripciones separadas a Kling para salida 4K, a Seedance para calidad de movimiento y a SkyReels para capacidades de edición, Happy Horse proporciona acceso integrado a varios modelos líderes dentro de un solo entorno de workflow. Esa consolidación importa por varias razones prácticas.

En primer lugar, elimina la carga cognitiva de aprender interfaces, sintaxis de prompts y sistemas de parámetros distintos para cada modelo. Un creador puede probar el mismo prompt en Happy Horse 1.0, Kling 3.0 y SkyReels V4 sin cambiar de plataforma, lo que permite una iteración rápida y una comparación directa de calidad. En segundo lugar, simplifica la gestión de facturación y presupuesto: una sola suscripción, una sola factura y costes predecibles, en lugar de repartir el consumo entre múltiples servicios con estructuras de precio distintas. En tercer lugar, permite optimizar el workflow emparejando el modelo correcto con cada reto creativo: usar Kling 3.0 para el hero shot que requiere resolución máxima, Happy Horse 1.0 para la secuencia narrativa que exige consistencia de personajes y SkyReels V4 para la escena que requiere edición quirúrgica.

Este enfoque de plataforma refleja una tendencia industrial más amplia hacia la agregación de modelos de IA. Del mismo modo que ningún large language model domina todas las tareas de generación de texto, ningún modelo de video dominará todos los retos creativos. El futuro de la producción profesional de video con IA probablemente pasará por intelligent model routing, donde el sistema seleccione o recomiende automáticamente el modelo óptimo en función del análisis del prompt, las restricciones presupuestarias y los requisitos de calidad. La plataforma integrada de Happy Horse lo sitúa bien para este futuro multimodelo.

Limitaciones y consideraciones en los tres modelos

A pesar del progreso notable de comienzos de 2026, los tres modelos siguen compartiendo ciertas limitaciones que los creadores deben entender antes de comprometerse con workflows de producción. La simulación física en escenarios complejos, incluyendo el comportamiento del fuego, la dinámica del agua con múltiples corrientes interactuando y el desgarro de telas, todavía se rompe en ocasiones de formas que producen resultados visualmente implausibles. Las interacciones entre varios personajes, especialmente en escenas con tres o más personajes implicados en acciones coordinadas, tienden todavía a producir artefactos visuales donde las extremidades se cruzan de forma incorrecta o las relaciones espaciales se vuelven confusas.

La consistencia de personajes entre videos diferentes sigue siendo un problema sin resolver. Aunque Happy Horse 1.0 mantiene la identidad del personaje dentro de una sola generación multi-shot y SkyReels V4 puede usar imágenes de referencia para guiar la apariencia del personaje, ningún modelo consigue aún producir de forma fiable al mismo personaje a través de sesiones de generación totalmente separadas sin una cuidadosa ingeniería de prompts y una gestión precisa de imágenes de referencia. Esta limitación importa para series, personajes de marca recurrentes y cualquier aplicación que requiera un reparto consistente a lo largo de múltiples episodios o campañas.

El panorama del copyright también exige atención. En marzo de 2026, la Corte Suprema de Estados Unidos rechazó escuchar la apelación en Thaler v. Perlmutter, dejando efectivamente en pie el criterio de que el contenido puramente generado por IA no es elegible para protección por copyright. Esto significa que cualquiera puede copiar y usar legalmente tus videos generados por IA, y que tú no puedes reclamar propiedad plena por copyright sobre ellos. Para empresas cuyo modelo depende de la exclusividad del contenido, esto representa un riesgo estratégico que exige mitigación mediante aportación creativa humana, una postproducción sustancial o protecciones legales alternativas como marcas y trade dress.

Conclusión: el futuro multimodelo de la producción de video con IA

La competencia entre Happy Horse 1.0, Kling 3.0 y SkyReels V4 revela una industria en maduración donde las diferencias de calidad se han estrechado hasta el punto de que la integración del workflow, los requisitos funcionales específicos y la estructura de costes suelen importar más que los benchmark scores brutos. Happy Horse 1.0 lidera en evaluaciones ciegas de calidad y ofrece una flexibilidad open source sin equivalente, pero carece de acceso por API para producción hasta finales de abril de 2026. Kling 3.0 proporciona la mayor resolución nativa, una fiabilidad de infraestructura probada y el pricing más rentable para producción de alto volumen. SkyReels V4 aporta el soporte multimodal de entrada más rico, capacidades integradas de edición y la mayor duración de generación única.

Para la mayoría de equipos de producción, la estrategia óptima no consiste en elegir un único modelo, sino en desarrollar workflows que aprovechen las fortalezas de cada uno. Usa Kling 3.0 para hero shots y entregables de alta resolución. Despliega Happy Horse 1.0 para secuencias narrativas que requieran consistencia de personajes una vez que se lance la API. Aplica SkyReels V4 a contenido que exija edición quirúrgica y condicionamiento multimodal complejo. Este enfoque multimodelo, facilitado por plataformas como Happy Horse que integran varios modelos dentro de una interfaz unificada, representa el camino pragmático hacia delante en una industria donde ninguna solución única domina todos los casos de uso.

El espacio de la generación de video con IA seguirá evolucionando con rapidez durante todo 2026. Los benchmarks que hoy definen el state of the art probablemente parecerán de gama media en el tercer trimestre de 2026. Los modelos comparados aquí lanzarán versiones actualizadas, surgirán nuevos competidores y las innovaciones arquitectónicas volverán a mover las jerarquías de rendimiento. Lo que permanece constante es la necesidad de que los creadores emparejen las capacidades de cada herramienta con retos creativos específicos, mantengan flexibilidad en su workflow y prioricen la fiabilidad en producción por encima del ranking. El futuro del video con IA no pertenece a un único modelo ganador, sino a un ecosistema de herramientas especializadas, y los ganadores serán quienes aprendan a orquestarlas con eficacia.

¿Listo para experimentar el futuro de la generación de video con IA? Visita Happy Horse para acceder a Happy Horse 1.0, Kling 3.0, SkyReels V4 y otros modelos líderes dentro de una única plataforma unificada. Crea hoy mismo tu primer video con estética cinematográfica usando nuestras herramientas integradas de workflow y el model routing inteligente.