HappyHorse ist da, und dieser Launch ist aus einem einfachen Grund wichtig: KI-Video-Käufer wollen keine vagen Versprechen mehr. Sie wollen einen Workflow, den sie verstehen, Ergebnisse, die sie testen können, und einen glaubwürdigen Grund zu glauben, dass das Modell auch außerhalb einer Demo funktioniert.

Wenn du den Workflow direkt ausprobieren willst, während du liest, ist HappyHorse bereits live.

Der stärkste Grund, jetzt hinzuschauen, ist nicht Hype, sondern Praxistauglichkeit. Mit Stand vom 8. April 2026 liegt HappyHorse-1.0 laut öffentlichen Daten bei Artificial Analysis sowohl im No-Audio-Text-to-Video- als auch im No-Audio-Image-to-Video-Ranking auf Platz 1. Das bedeutet nicht, dass es automatisch für jedes Team, jedes Budget und jede Ausgabestilistik die beste Wahl ist. Es bedeutet aber, dass dieser Launch mit einem belastbaren öffentlichen Signal startet und nicht mit einer leeren Behauptung.

Genau diese Unterscheidung verändert die richtige Lesart des Launches. Das ist keine Waitlist-Geschichte. Es ist eine praktische Geschichte darüber, wie man eine topplatzierte Modellfamilie für echte Arbeit nutzt: Demos, Launch-Assets, Social Clips, Ad-Tests, Onboarding-Videos und frühe Storyboard-Pässe.

Warum dieser Launch wichtig ist

Die meisten KI-Video-Launches klingen am Anfang gleich. Sie versprechen mehr Geschwindigkeit, bessere Qualität und weniger Produktionsengpässe. Die eigentliche Frage ist, ob dieser Launch für Teams mit ohnehin zu vielen Tools einen echten Entscheidungspunkt schafft.

HappyHorse schafft diesen Entscheidungspunkt auf vier Arten:

- Es startet mit Workflows, die Teams bereits verstehen: Text-to-Video und Image-to-Video.

- Es positioniert sich rund um Short-Form-Produktion statt um abstrakte Zukunftsnarrative.

- Das stärkste öffentliche Signal liegt aktuell in No-Audio-Kategorien und passt damit gut zu Launch-, Social-, Preview- und Ad-Workflows.

- Das Produkt zeigt bereits klare erste Einsatzfälle wie Demos, Teaser, Onboarding-Clips und Storyboard-Previews.

Dadurch wird der Launch leichter zu bewerten. Man muss sich keinen fernen Zukunftsfall ausdenken. Es reicht zu prüfen, ob der aktuelle Content-Workflow schneller wird.

Hier ist der wichtigste öffentliche Snapshot zum Launch:

| Bereich | Signal am 8. April 2026 | Warum das wichtig ist |

|---|---|---|

| Text-to-Video ohne Audio | HappyHorse-1.0 ist #1 mit Elo 1357 | Starker Startpunkt für Konzepte, Hooks, Szenen und Bewegungsstudien |

| Image-to-Video ohne Audio | HappyHorse-1.0 ist #1 mit Elo 1402 | Starker Fit für referenzgesteuerte Workflows mit Fokus auf Komposition und Identität |

| Timing des Releases | Das Modell erscheint als neuer April-2026-Eintrag | Neue Modelle erzeugen frühe Aufmerksamkeit und schnellen Vergleichsdruck |

| Produkt-Story | Die Website fokussiert kurze Produktion, Launch-Assets, Demos und Social Outputs | Die Launch-Erzählung passt zu realen Produktionsanforderungen |

Die nützlichste Interpretation ist konservativ: Die No-Audio-Führung ist aktuell der stärkste Grund, HappyHorse zuerst zu testen. Alles andere sollte über reale Output-Qualität, Konsistenz und Prozess-Fit beurteilt werden.

Wofür HappyHorse aktuell am besten geeignet ist

Die Launch-Botschaft wird klarer, wenn man nicht fragt, ob HappyHorse alles kann, sondern wo es sofort den größten Hebel schafft.

1. Schnelle Iteration von der Idee zum Clip

HappyHorse ergibt am meisten Sinn, wenn Geschwindigkeit der erste Job ist. Viele Teams müssen in einer einzigen Session von einer Idee zu sichtbarer Bewegung kommen. Das ist typisch bei:

- Produkt-Launch-Planung

- Tests von Paid Creatives

- Entwicklung kurzer Social-Kampagnen

- interner Konzeptvalidierung

- grober Storyboard-Erkundung

In diesen Situationen ist Perfektion nicht das erste Ziel. Tempo ist es. Ein Modell, das schnell eine brauchbare erste Fassung liefert, verändert, wie viele Ideen ein Team überhaupt testet.

2. Referenzgeführte Videogenerierung

Die aktuelle No-Audio-Führung bei Image-to-Video ist besonders relevant, weil bildgestützte Workflows ein sehr praktisches Problem lösen: kreative Kontrolle. Textprompts sind gut für Exploration. Referenzbilder sind besser, wenn das Team bereits weiß, wie Subjekt, Komposition, Produktframe oder Charakter aussehen sollen.

Das ist wichtig für:

- Produktvisuals mit Marken-Konsistenz

- Launch-Teaser rund um ein starkes Hero-Frame

- Ads mit wiederholbarer Subjekt-Identität

- Onboarding-Sequenzen mit stabilem visuellen Anker

- Konzept-Previews, bei denen Kameraverhalten wichtiger ist als visuelle Erfindung

3. Short-Form-Produktion

Die Website selbst deutet klar auf kurze, nützliche Videojobs statt auf den Ersatz langer Erzählformate hin. Das ist die richtige Spur. Gerade Short-Form profitiert am stärksten von einem Modell, das schnell mehrere Richtungen erzeugen kann:

- Ein Teaser kann zu drei Hook-Varianten werden.

- Eine Produkt-Demo-Idee kann in mehrere Tempi übersetzt werden.

- Eine Onboarding-Erklärung kann zu einer kürzeren Aktivierungsfassung werden.

- Eine Social-Idee kann plattformspezifische Varianten liefern.

Hier wird Launch-Energie zu Workflow-Wert.

4. Entscheidungsunterstützung in der Vorproduktion

HappyHorse passt auch zu Teams, die KI-Output nicht jedes Mal als finalen Deliverable sehen. Manchmal ist der beste Einsatz von KI-Video nicht die Endfassung, sondern Entscheidungshilfe. Es hilft früher zu sehen:

- welche Szenenrichtung am stärksten ist,

- ob ein Konzept genug Spannung hat,

- ob das Framing die Botschaft trägt,

- ob eine Idee ein echtes Produktionsbudget verdient.

Dieser Einsatz wird oft unterschätzt. Ein starker Preview-Loop spart häufig mehr Zeit als ein stärker polierter Final-Render.

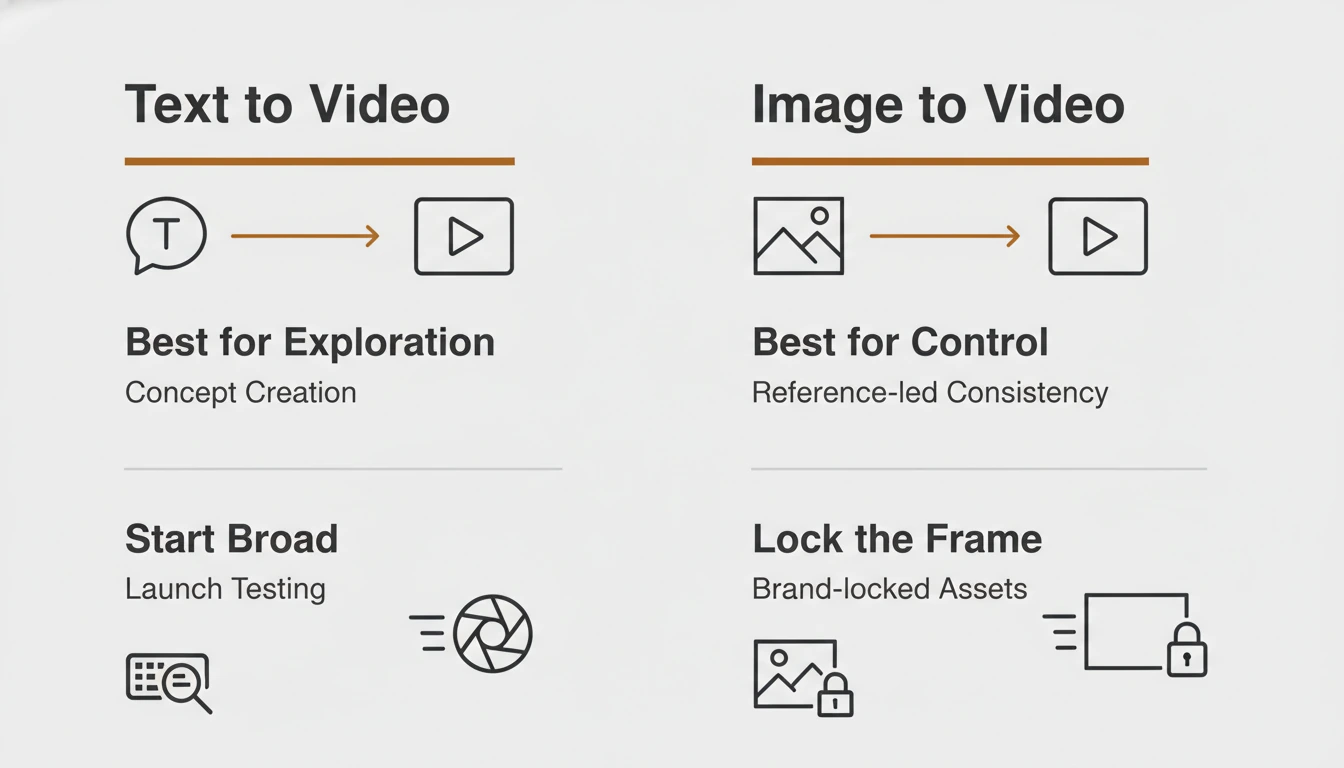

Text-to-Video oder Image-to-Video: Mit dem richtigen Modus starten

Der schnellste Weg, ein starkes Modell zu verschwenden, ist der falsche Eingabemodus. Viele Teams nutzen Text-to-Video, obwohl sie eigentlich Kontrolle brauchen. Andere nutzen Image-to-Video, obwohl sie eigentlich Exploration brauchen.

Nutze stattdessen dieses Entscheidungsraster:

| Wenn dein Ziel ist… | Starte mit… | Warum |

|---|---|---|

| Ein neues Konzept von Grund auf erkunden | Text-to-Video | Es geht eher um Ideenöffnung als um strikte Kontrolle |

| Subjekt, Produktframe oder visuelle Identität fixieren | Image-to-Video | Ein Referenzbild liefert einen stärkeren visuellen Anker |

| Mehrere Launch-Winkel schnell testen | Erst Text-to-Video, dann Image-to-Video | Erst breit erkunden, dann die Gewinner-Richtung verengen |

| Ein starkes Still in Bewegung überführen | Image-to-Video | Das Still enthält bereits die gewünschte Komposition |

| Einen Teaser aus einem bestehenden Kampagnenframe ableiten | Image-to-Video | Konsistenz ist meist wichtiger als Neuheit |

| Eine Storyboard-Preview für ein noch offenes Konzept bauen | Text-to-Video | Erst schnelle Richtungsklärung, dann visuelle Festlegung |

Die einfachste Regel lautet:

- Starte mit Text-to-Video, wenn du noch entscheidest, was die Szene überhaupt sein soll.

- Starte mit Image-to-Video, wenn du schon weißt, wie die Szene aussehen soll.

- Wechsle von textbasierter Exploration zu bildbasierter Kontrolle, sobald eine gute Richtung sichtbar wird.

Teams, die so vorgehen, erzielen meist schneller bessere Ergebnisse, weil sie Exploration und Kontrolle nicht in denselben Schritt pressen.

Ein praktischer First-Week-Workflow für Teams

Die nützlichsten Launch-Artikel sagen, was als Nächstes zu tun ist. Wenn ein Team HappyHorse diese Woche testet, ist der beste Weg nicht “alles ausprobieren”. Der beste Weg ist ein enger Loop, der zeigt, ob das Produkt einen größeren Platz im Stack verdient.

Schritt 1: Eine Output-Familie wählen

Bevor etwas generiert wird, sollte das Team genau eine praktische Output-Familie wählen:

- Launch-Teaser

- Produkt-Demo-Clip

- Paid-Ad-Konzept

- Onboarding-Walkthrough

- Storyboard-Preview

Das macht die erste Evaluation ehrlicher. Die Frage ist nicht, ob HappyHorse allgemein beeindruckend ist. Die Frage ist, ob es einen realen Job schneller oder besser als die aktuelle Methode löst.

Schritt 2: Erfolg vor dem Prompt definieren

Zuerst die Qualitätslatte setzen. Entscheide, was als erster brauchbarer Erfolg gelten würde:

- ein Teaser mit starken ersten drei Sekunden,

- ein Demo-Clip, der einen Flow klar erklärt,

- eine Social-Variante, die man wirklich posten würde,

- ein Onboarding-Cut, der Erklärungszeit spart,

- ein Storyboard-Pass, der eine Richtung freigabefähig macht.

Ohne diesen Schritt verwechseln Teams “interessanten Output” mit “nützlichem Output”.

Schritt 3: Zwei Eingaben parallel fahren

Teste nicht nur einen Prompt-Pfad. Fahre parallel:

- einen Text-to-Video-Pass für Konzeptbreite,

- einen Image-to-Video-Pass für Kontrolle.

So wird sichtbar, welcher Teil des Workflows für den eigenen Use Case stärker ist. Viele Teams lernen mehr aus dem Unterschied zwischen beiden Outputs als aus dem besten Einzelresultat.

Schritt 4: Eine Gewinner-Richtung schärfen

Sobald ein Ergebnis vielversprechend aussieht, nicht endlos weiter explorieren. Eine Richtung gezielt verdichten:

- Subjekt und Bewegung klarer machen,

- unnötiges Szenenrauschen reduzieren,

- die Kameralogik vereinfachen,

- das Tempo lesbarer machen,

- den Prompt auf eine visuelle Absicht konzentrieren.

In der ersten Woche geht es um Signal, nicht um Volumen. Wenige disziplinierte Verfeinerungen sagen mehr als dutzende verstreute Versuche.

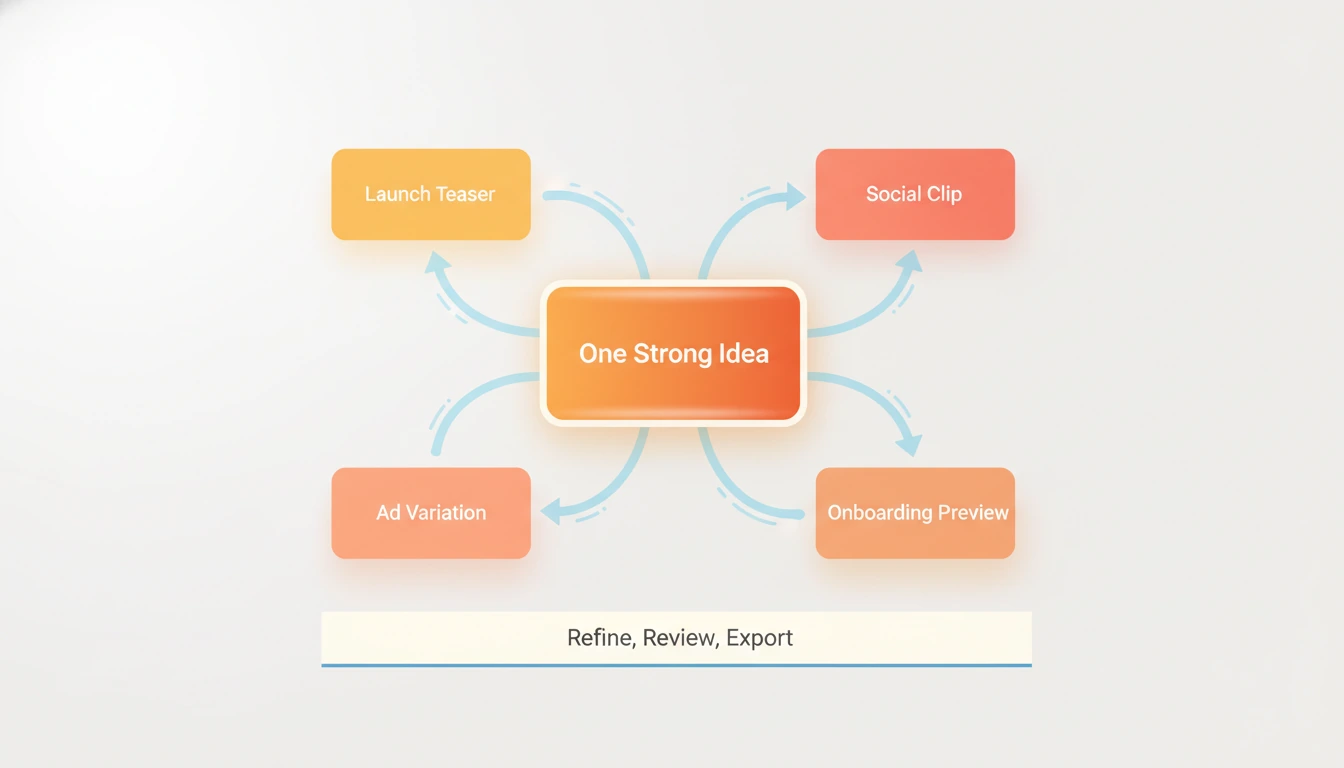

Schritt 5: Einen Output in mehrere Assets verwandeln

Der Launch wird operativ wertvoll, wenn ein Ergebnis mehrere Deliverables speist. Eine starke Richtung kann liefern:

- einen Landingpage-Teaser,

- einen Launch-Post-Clip,

- eine Ad-Variante,

- ein Founder-Update-Visual,

- eine Storyboard-Referenz für den nächsten Dreh.

Genau dieser Multiplikationseffekt ist der eigentliche Grund, so einen Launch zu testen.

Wo HappyHorse in echter Videoarbeit passt

Der Launch wird greifbarer, wenn man ihn an konkrete Jobs bindet statt an breite Behauptungen.

Product Demos

HappyHorse passt gut zu Product Demos, wenn das Team eher eine kurze visuelle Erklärung als ein vollpoliertes Tutorial braucht. Eine schnelle Bewegungsebene rund um eine Produktidee kann einer Launch-Page oder einem Sales Deck schon deutlich mehr Leben geben.

Launch Teasers

Das ist einer der klarsten frühen Fits. Launch-Teaser brauchen Spannung, Bewegung und Tempo. Sie brauchen außerdem mehrere kreative Richtungen in kurzer Zeit. Genau dazu passt HappyHorse gut.

Social Clips

Social Workflows belohnen Variation. Teams gewinnen selten mit einem einzigen perfekten Clip. Sie gewinnen durch Tests mit verschiedenen Openern, visuellen Rhythmen und Framings. HappyHorse ist nützlich, wenn genau diese Iterationsgeschwindigkeit zählt.

Ads

Ads sind ein Filtersystem. Der erste Job ist nicht Perfektion, sondern zu lernen, welcher kreative Winkel Aufmerksamkeit gewinnt. HappyHorse hilft beim Testen von:

- unterschiedlichen Hooks,

- unterschiedlichen Bewegungsintensitäten,

- unterschiedlichen visuellen Metaphern,

- unterschiedlichen Szenenrhythmen,

- unterschiedlichen Produktframings.

Onboarding

Onboarding-Videos brauchen keine cineastische Übertreibung. Sie brauchen Klarheit. Ein kurzer visueller Clip, der zeigt, was zuerst zu tun ist, kann Reibung sofort senken. HappyHorse funktioniert hier gut, wenn das Ziel eng definiert bleibt.

Storyboard Previews

Das ist der stille Power-Move. Viele Teams werden den größten Wert aus HappyHorse vor der Finalproduktion ziehen, nicht danach. Eine starke Storyboard-Preview hilft, Produkt, Marketing, Design und Kunde vor größeren Investitionen auf eine Richtung auszurichten.

Was dieser Launch noch nicht löst

Ein glaubwürdiger Launch-Artikel sollte auch sagen, was das Produkt noch nicht löst, denn diese Grenze ist Teil der Kaufentscheidung.

HappyHorse ersetzt nicht den Bedarf an:

- solidem Prompt-Urteil,

- kreativer Führung,

- Auswahl und Schnitt,

- narrativen Tempoentscheidungen,

- Markenreview,

- finaler Qualitätskontrolle.

Es sollte außerdem nicht als universelle Antwort für jedes Videoformat behandelt werden. Der stärkste öffentliche Beleg ist aktuell die No-Audio-Führung. Das reicht, um Tests zu rechtfertigen. Es reicht nicht, um nachlässige Entscheidungen zu rechtfertigen.

Die bessere Haltung ist:

- Nutze HappyHorse, um kreativen Durchsatz zu erhöhen.

- Nutze menschliches Urteilsvermögen, um Publish-Würdiges auszuwählen.

- Nutze bildgeführte Kontrolle, wenn Konsistenz zählt.

- Nutze textgeführte Generierung, wenn Exploration zählt.

So bleiben Erwartungen scharf und praktisch.

Wie man am ersten Tag bessere Ergebnisse bekommt

Die schnellsten Verbesserungen kommen meistens aus besserem Problem-Framing, nicht aus längeren Prompts.

Eine starke Checkliste für den ersten Tag sieht so aus:

- Vor dem Prompt ein klares visuelles Ziel aufschreiben.

- Jeden Prompt auf genau eine Szenenintention fokussieren.

- Image-to-Video nutzen, wenn Subjektidentität oder Markenframing wichtig sind.

- Outputs nach Botschaftsklarheit beurteilen, nicht nur nach visueller Neuheit.

- Das stärkste Frame oder Ergebnis speichern und als Basis für den nächsten kontrollierten Pass verwenden.

- Das Modell nach wiederholbarem Prozesswert bewerten, nicht nach einem einzelnen Glückstreffer beim Rendern.

Diese Gewohnheiten sind wichtig, weil Launch-Euphorie schnell zu schlampigen Tests führt. Die Teams, die am meisten aus einem neuen Modell ziehen, sind meist nicht die enthusiastischsten, sondern die diszipliniertesten.

FAQ

Ist HappyHorse nur eine weitere Benchmark-Story?

Nein. Die Benchmark-Führung ist der Grund, es zu testen, nicht der Grund, ihm blind zu vertrauen. Die echte Entscheidung hängt davon ab, ob es die eigenen Workflows für Demos, Launches, Ads, Onboarding oder Previews verbessert.

Warum ist die No-Audio-Führung so wichtig?

Viele praktische Short-Form-Workflows brauchen kein Audio, um ihren Wert zu beweisen. Teams entscheiden oft zuerst über Konzept, Bewegung, Framing und Tempo und erst danach über Sound. Ein starkes No-Audio-Ergebnis reicht aus, um diese Jobs zu öffnen.

Sollten Teams am ersten Tag komplett umsteigen?

Nein. Der bessere Move ist ein enger Test. Einen Workflow wählen, Outputs vergleichen und dann entscheiden, ob HappyHorse eine größere Rolle verdient.

Was ist der beste erste Einsatzfall?

Launch-Teaser und visuelle Konzepttests sind meist die saubersten Startpunkte, weil Erfolgskriterien leicht zu bewerten sind und der Geschwindigkeitsvorteil schnell sichtbar wird.

Wann sollte ich vermeiden, zuerst Text-to-Video zu nutzen?

Wenn das exakte Subjekt, der Produktframe oder die visuelle Identität bereits wichtiger sind als Exploration. Dann ist Image-to-Video meist der bessere Einstieg.

Was macht diesen Launch für Marketer interessant?

Er verkürzt die Strecke von der Idee bis zu einem testbaren Bewegtbild-Baustein. Das ist entscheidend für Launch-Kampagnen, die Iteration bezahlter Creatives und Social-Pipelines, in denen Geschwindigkeit Teil der Strategie ist.

Fazit

HappyHorse kommt zum richtigen Zeitpunkt. Teams suchen nicht länger ein magisches KI-Video-Versprechen. Sie suchen einen Workflow, der ihnen hilft, mehr Ideen zu testen, schneller zu entscheiden und bessere Kurzformat-Videoelemente zu veröffentlichen, ohne jeden Versuch in einen vollständigen Produktionszyklus zu verwandeln.

Genau deshalb ist dieser Launch Aufmerksamkeit wert. Das aktuelle öffentliche Signal ist stark, das Produktframing passt zu echter Short-Form-Arbeit, und der klarste Wert liegt in Workflows, in denen Geschwindigkeit, Variation und kontrollierte visuelle Iteration besonders wichtig sind.

Die beste Art, diesen Launch zu bewerten, ist einfach: Einen echten Videojob wählen, beide Eingabemodi testen, eine Gewinner-Richtung schärfen und sehen, ob der Workflow einen dauerhaften Platz im Stack verdient.