Die Landschaft der AI-Videogenerierung hat sich Anfang 2026 seismisch verschoben. Was früher ein Spielfeld experimenteller Tools war, die unscharfe, artefaktbeladene Clips erzeugten, ist heute eine Wettbewerbsarena, in der drei Modelle die Ranglisten dominieren: Happy Horse 1.0, Kling 3.0 und SkyReels V4. Jedes steht für eine eigene architektonische Philosophie, und jedes ist in konkreten Produktionsszenarien stark, die für Creator, Marketer und Filmemacher wirklich zählen. Dieser umfassende Leitfaden zerlegt ihre technischen Grundlagen, ihre Leistung in der Praxis und ihre konkreten Einsatzmöglichkeiten, damit Sie das richtige Modell für Ihren Workflow auswählen können.

Der neue Benchmark: Was sich 2026 geändert hat

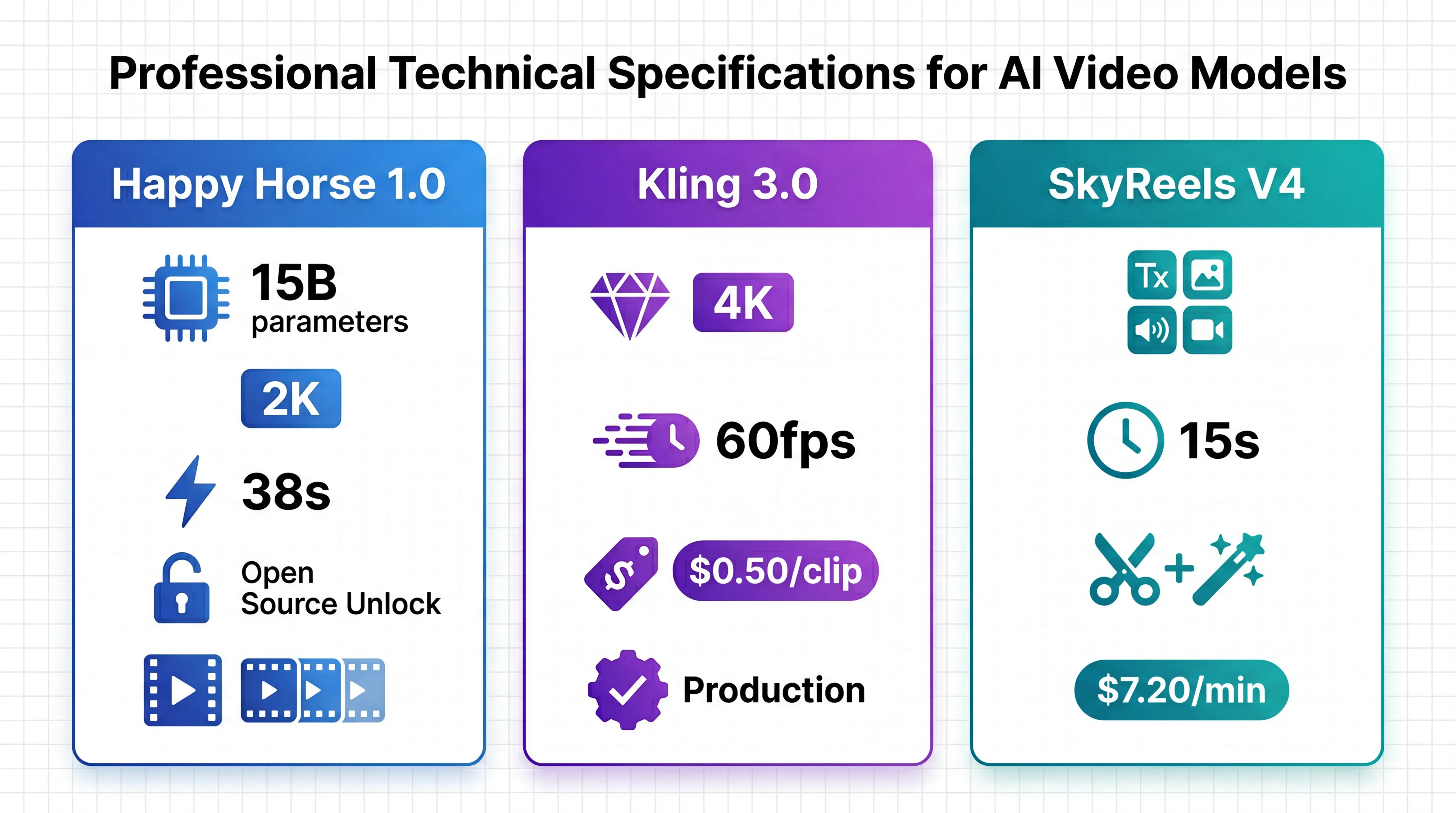

Der Bereich AI-Video hat Anfang 2026 eine kritische Schwelle überschritten. Native gemeinsame Audio-Video-Generierung, die vor zwölf Monaten nur in Forschungspapieren existierte, ist bei allen drei Modellen zu einer produktionsreifen Funktion geworden. Auch die Auflösungsfähigkeiten sind deutlich gesprungen. Kling 3.0 liefert nun nativ 4K bei 60fps, während Happy Horse 1.0 auf H100-Hardware in ungefähr 38 Sekunden Video in 2K-Kinoqualität erzeugt. Die Benchmarks für Bewegungsqualität liegen so eng beieinander, dass unabhängige Evaluatoren Seedance 2.0 für Bewegungsrealismus mit 9,2 von 10 Punkten bewerten, dicht gefolgt von Kling 3.0 mit 9,0.

Auch die Wettbewerbsdynamik hat sich fundamental verändert. Happy Horse 1.0 tauchte Anfang April 2026 anonym in der Artificial Analysis Video Arena auf und kletterte rasch auf Platz eins mit einem Elo-Rating von 1.361 in Text-to-Video ohne Audio. Damit überholte es etablierte Akteure wie Seedance 2.0 und Kling 3.0. Diese Blindbewertungsmethode, bei der Nutzer Outputs vergleichen, ohne zu wissen, welches Modell sie erzeugt hat, liefert heute das objektivste verfügbare Qualitätssignal. Dass Happy Horse 1.0 sowohl Kling 3.0 als auch SkyReels V4 in direkten Vergleichen konsistent schlug, deutet auf echte architektonische Vorteile hin und nicht auf Marketing-Hype.

Happy Horse 1.0: der Open-Source-Disruptor

Happy Horse 1.0 ist die erste ernsthafte Herausforderung für die Dominanz geschlossener Systeme in der AI-Videogenerierung. Das Modell basiert auf einer vereinheitlichten Transformer-Architektur mit 15 Milliarden Parametern und 40 Self-Attention-Layern und verarbeitet Text-, Bild-, Video- und Audio-Token nativ in einem einzigen Forward Pass. Diese Architekturentscheidung beseitigt die Synchronisationsartefakte, die mehrstufige Pipelines typischerweise plagen, wenn Video und Audio getrennt erzeugt und erst anschließend synchronisiert werden.

Technische Architektur und Performance

Das Modell nutzt DMD-2-Destillation, eine Technik, die den Denoising-Prozess auf nur acht Schritte reduziert, ohne classifier-free guidance zu benötigen. Diese Optimierung liefert bemerkenswerte Inferenzgeschwindigkeiten: ungefähr zwei Sekunden für einen fünfsekündigen Clip in 256p und rund 38 Sekunden für vollständige 1080p-Ausgabe auf H100-Hardware. Im direkten Vergleich mit den nächsten Konkurrenten erzeugt Happy Horse 1.0 2K-Video 30 Prozent schneller als Seedance 1.5 Pro und 29 Prozent schneller als Kling 2.1.

Besondere Aufmerksamkeit verdient die Dual-Branch-DiT-Architektur. Ein Zweig übernimmt die visuelle Synthese, der andere erzeugt zeitlich ausgerichtetes Audio, während beide einen gemeinsamen Textencoder nutzen. Dieses Design erlaubt es dem Modell, die Charakteridentität über mehrere Einstellungen hinweg stabil zu halten. Genau das unterscheidet es von Single-Shot-Generatoren wie Sora, Runway oder Standard-Kling-Implementierungen. Wenn man Happy Horse 1.0 mit einer narrativen Beschreibung füttert, produziert es zusammenhängende Szenenfolgen statt isolierter Clips und reduziert dadurch den manuellen Schnittaufwand erheblich.

Mehrsprachiges Lip-Sync und Audiofähigkeiten

Happy Horse 1.0 unterstützt native gemeinsame Audio-Video-Generierung in sieben Sprachen: Chinesisch, Englisch, Japanisch, Koreanisch, Deutsch, Französisch und Kantonesisch. Laut Dokumentation erreicht das Modell ultra-low WER lip-sync. WER steht für Word Error Rate, einen aus der Spracherkennung entlehnten Messwert, der beschreibt, wie genau Lippenbewegungen zu gesprochenen Phonemen passen. Eine unabhängige Verifikation dieser WER-Angaben steht zwar noch aus, doch die auf Artificial Analysis sichtbaren Outputs zeigen bereits in englischen und chinesischen Testfällen überzeugende Synchronität.

Die Audiogenerierung geht zudem über Dialog hinaus und umfasst auch Umgebungsgeräusche und Foley-Effekte. Wenn man etwa eine Szene mit Regen auf einer städtischen Straße erzeugt, produziert das Modell nicht nur Tropfen, nassen Asphalt und Reflexionen, sondern auch die vielschichtige Klangkulisse aus Regen, entferntem Verkehr und den unterschiedlichen akustischen Eigenschaften von Wasser auf verschiedenen Oberflächen. Diese Integration von Audio und Bild eliminiert einen kompletten Postproduktionsschritt, der bisher separate Sounddesign-Tools erforderte.

Der Open-Source-Vorteil und aktuelle Grenzen

Happy Horse 1.0 wird als vollständig offenes Paket ausgeliefert, inklusive Basismodell, destilliertem Modell, Super-Resolution-Modul und vollständigem Inferenzcode. Diese Lizenzierung ermöglicht Self-Hosting und Fine-Tuning für individuelle Anwendungsfälle, was für Unternehmen mit strengen Markenrichtlinien, proprietären visuellen Stilen oder Anforderungen an Datensouveränität enorm wichtig ist. Auf der Artificial Analysis Video Arena schlägt das Modell Seedance 2.0, Ovi 1.1 und LTX 2.3 und ist damit Mitte April 2026 die qualitativ stärkste Open-Weights-Option.

Allerdings gibt es eine kritische Lücke zwischen Benchmark-Leistung und Produktionszugang. Mit Stand vom 18. April 2026 existiert für Happy Horse 1.0 noch keine öffentlich verfügbare API. Das offizielle Team kündigte über Social Media an, dass der API-Zugang am 30. April 2026 starten werde, und warnte zugleich vor mehreren betrügerischen Webseiten, die bereits vorher Zugang versprachen. Das bedeutet: Das weltweit führende Modell ist zum genannten Zeitpunkt noch nicht direkt in produktive Pipelines integrierbar, was für Teams, die ihre Infrastruktur für Videogenerierung heute bewerten, ein strategisches Dilemma schafft.

Kling 3.0: der production-grade Benchmark

Kling 3.0 von Kuaishou hat sich durch zwei Monate live verfügbare API, umfassende Dokumentation und konsistente Qualität unter Last als produktionsreifer Standard im Bereich AI-Video etabliert. Das Modell arbeitet mit einer Visual-Chain-of-Thought-Architektur, die komplexe Prompts in sequenzielle Denk- und Planungsschritte aufteilt. Dadurch interpretiert Kling mehrteilige Szenen mit spezifischen Kamerabewegungen, Lichtbedingungen und Charakterinteraktionen genauer.

Native 4K-Ausgabe und Bewegungsqualität

Kling 3.0s sichtbarstes Unterscheidungsmerkmal ist native 4K-Ausgabe bei 60 Bildern pro Sekunde. Das ist Stand Februar 2026 die höchste native Auflösung unter allen großen AI-Videomodellen. Es handelt sich nicht um hochskaliertes 1080p-Material, sondern um echtes Rendering in 3840x2160 ohne die Weichheit und Artefakte, die post hoc geschärfte Ergebnisse häufig mitbringen. Die 60fps eliminieren zudem das AI-Stottern früherer 24fps- und 30fps-Modelle. Dadurch eignet sich Kling 3.0 besonders für schnelle Action-Sequenzen, Sportinhalte und professionelle Produktdemos, in denen Bewegungsschärfe die Qualitätswahrnehmung unmittelbar beeinflusst.

Unabhängige Benchmarks platzieren Kling 3.0 konstant unter den Spitzenreitern bei Bewegungsqualität. Professionelle Videografen bezeichneten es als möglicherweise das leistungsfähigste General-Purpose-Modell derzeit und als state of the art bei natürlicher Bewegung und Physiksimulation. Besonders stark ist das Modell bei Szenen, in denen realistische physische Interaktion nötig ist: kollidierende Objekte, gießende Flüssigkeiten, Stoff, der auf Wind reagiert. Genau hier produzierten ältere Modelle oft sichtbar unplausible Ergebnisse.

Kosteneffizienz und Skalierbarkeit in der Produktion

Mit ungefähr 0,50 US-Dollar pro Clip gehört Kling 3.0 zu den kosteneffizientesten High-End-Modellen für die Produktion in großem Maßstab. Über API-Anbieter wie ModelsLab liegt die Preisstruktur bei etwa 0,12 bis 0,15 US-Dollar pro generierter Videosekunde, sodass ein fünfsekündiger Clip grob 0,60 bis 0,75 US-Dollar kostet. Für Nutzer mit hohem Volumen gibt es Staffelpreise, was Kling 3.0 besonders attraktiv für Marketingagenturen, Social-Media-Teams und E-Commerce-Plattformen macht, die jeden Monat Dutzende oder Hunderte Produktvideos erzeugen.

Die von Nutzern berichteten Generierungszeiten reichen von zwei bis fünfzehn Minuten, abhängig von Prompt-Komplexität und Serverauslastung. Das ist langsamer als die genannten 38 Sekunden von Happy Horse 1.0 für 1080p, aber in Batch-Produktionsworkflows spielt dieser Unterschied eine kleinere Rolle, weil dort meist mehrere Clips parallel in der Warteschlange liegen. API-Stabilität und gut kalkulierbare Preise haben Kling 3.0 deshalb für viele Anwendungsfälle bereits zur Infrastruktur gemacht.

Motion Control und erweiterte Funktionen

Kling 3.0 bietet mit Motion Control ein Feature, das besondere Aufmerksamkeit verdient. Nutzer können ein Referenzvideo hochladen, dessen Bewegungsmuster extrahieren und genau diese Bewegung auf völlig andere Motive anwenden. Man kann zum Beispiel eine bestimmte Kamerafahrt in einem echten Raum aufnehmen und das Bewegungsprofil anschließend auf eine AI-generierte Fantasielandschaft übertragen. Diese Fähigkeit schlägt eine Brücke zwischen klassischer Cinematography und generativer AI, sodass Regisseure präzise kreative Kontrolle über die Kameraarbeit behalten, während sie AI für die visuelle Inhaltserzeugung nutzen.

Die Kling-3.0-Omni-Variante erweitert das Basismodell um zusätzliche multimodale Fähigkeiten, darunter Voice Cloning. Nutzer können einer Figur vor der Generierung eine bestimmte Stimme zuweisen und diese über mehrere Szenen hinweg konsistent halten. Das ist für narrative Inhalte, Markencharaktere und Bildungsserien von enormem Wert, weil Wiedererkennbarkeit der Stimme das Verständnis und die Bindung des Publikums stärkt.

SkyReels V4: die vereinheitlichte multimodale Grundlage

SkyReels V4 von Kunlun verfolgt eine grundsätzlich andere Architekturstrategie. Statt auf einen einzigen stark optimierten Generierungspass zu setzen, verwendet das Modell eine duale Multimodal-Diffusion-Transformer-Architektur. Ein Stream synthetisiert Video, der andere erzeugt zeitlich ausgerichtetes Audio, während beide einen leistungsstarken Textencoder auf Basis multimodaler Large Language Models teilen. Dadurch kann SkyReels V4 die reichhaltigste Kombination von Eingaben unter den drei Modellen verarbeiten: Text, Bilder, Videoclips, Masken und Audio-Referenzen lassen sich beliebig kombinieren, um Szenenkomposition, Charakterlook und Klangatmosphäre fein zu steuern.

Vereinheitlichte Generierung, Inpainting und Bearbeitung

SkyReels V4s wichtigste Eigenschaft ist die einheitliche Behandlung von Generierung, Inpainting und Editing innerhalb derselben Architektur. Über eine Channel-Concatenation-Formulierung verarbeitet das Modell Image-to-Video, Video-Verlängerung und chirurgische Video-Bearbeitung unter derselben Oberfläche. Das bedeutet: Man kann zunächst eine Basisszene generieren und danach mithilfe maskenbasierten Inpaintings einzelne Elemente austauschen, etwa Kleidung ändern, ein Wasserzeichen entfernen oder den Hintergrund ersetzen, ohne den gesamten Clip neu rechnen zu müssen.

Die praktischen Konsequenzen sind erheblich. Traditionelle Video-Workflows setzen oft ein Tool für die Erzeugung und ein anderes für die Bearbeitung ein. Man generiert, exportiert, editiert in einer zweiten Umgebung und hofft, dass beides visuell zusammenpasst. SkyReels V4 zieht diese Schritte in denselben latenten Raum zurück und sorgt dadurch für bessere visuelle Konsistenz sowie weniger Formatkonvertierungsartefakte.

Auflösung, Dauer und Effizienzstrategie

SkyReels V4 unterstützt bis zu 1080p Auflösung, 32 Bilder pro Sekunde und 15 Sekunden Dauer. Damit ist es im Vergleich dieser drei Modelle das System mit der längsten Einzelgenerierung. Um hochauflösende und zugleich lange Clips auf aktueller Hardware praktikabel zu machen, nutzt das Modell eine clevere Effizienzstrategie: Es generiert Sequenzen in niedriger Auflösung vollständig und hochauflösende Schlüsselbilder gleichzeitig und setzt anschließend spezialisierte Super-Resolution- und Frame-Interpolation-Modelle ein, um das Endergebnis zu erzeugen.

Dieser Keyframe-plus-Superresolution-Ansatz fügt im Vergleich zur Direktgenerierung zusätzliche Schritte hinzu und verlängert dadurch die Gesamtrechenzeit. Er macht es jedoch möglich, die zeitliche Konsistenz über längere Sequenzen besser zu halten, als es bei direkter 1080p-Langgenerierung unter aktuellen Hardwaregrenzen realistisch wäre. Für narrative Inhalte, Erklärvideos und Tutorials mit längeren zusammenhängenden Einstellungen ist dieser Trade-off sinnvoll.

Leaderboard-Position und Zugänglichkeit

Kurz nach der Veröffentlichung im März 2026 erreichte SkyReels V4 Rang zwei auf dem Artificial-Analysis-Leaderboard für Text-to-Video mit Audio und zeigte damit, dass es qualitativ direkt in der Spitzengruppe mitspielt. In Text-to-Video ohne Audio liegt SkyReels V4 bei Elo 1.244 und damit genau einen Punkt über Kling 3.0 Pro mit 1.243. Diese fast identischen Werte machen deutlich, dass Qualitätsunterschiede an der Spitze inzwischen so klein sind, dass Workflow-Integration, Preis und spezielle Feature-Anforderungen stärker ins Gewicht fallen.

SkyReels V4 ist über API-Anbieter zugänglich und kostet ungefähr 7,20 US-Dollar pro Minute generierten Videos. Damit liegt es zwischen PixVerse V6 mit 5,40 US-Dollar pro Minute und Kling 3.0 Pro mit 13,44 US-Dollar pro Minute. Genau diese Preisstruktur bietet das, was mehrere unabhängige Evaluatoren im April 2026 als das beste Verhältnis zwischen Qualität und Preis unter den zugänglichen Modellen beschreiben.

Direkter Vergleich: technische Spezifikationen

| Spezifikation | Happy Horse 1.0 | Kling 3.0 | SkyReels V4 |

|---|---|---|---|

| Architektur | Unified Transformer mit 15B Parametern, 40-lagige Self-Attention, Dual-Branch DiT | Visual Chain-of-Thought, diffusionsbasierte Pipeline | Dual-Stream Multimodal Diffusion Transformer (MMDiT) |

| Auflösung | Bis 2K (1080p nativ) | Natives 4K (3840x2160) | Bis 1080p |

| Bildrate | Standardbereich (implizit 30fps) | 60fps | 32fps |

| Maximale Dauer | Multi-Shot-Sequenzen | 10–15 Sekunden pro Clip | 15 Sekunden |

| Audiogenerierung | Native gemeinsame Synthese, 7 Sprachen | Nativ mit Voice Cloning | Native gemeinsame Synthese |

| Inferenzgeschwindigkeit | Ca. 38 s für 1080p (H100) | 2–15 Minuten (abhängig von der Last) | Länger (Keyframe- + SR-Ansatz) |

| API-Verfügbarkeit | Kommt am 30. April 2026 | Live seit Februar 2026 | Live seit März 2026 |

| Preis | Noch offen | Ca. 0,50 US-Dollar/Clip, 0,12–0,15 US-Dollar/Sekunde | Ca. 7,20 US-Dollar/Minute |

| Open Source | Ja (vollständiges Modell + Code) | Nein | Teilweise (Gewichtsstatus unklar) |

| Elo-Rating (T2V ohne Audio) | 1.361 | 1.247 | 1.244 |

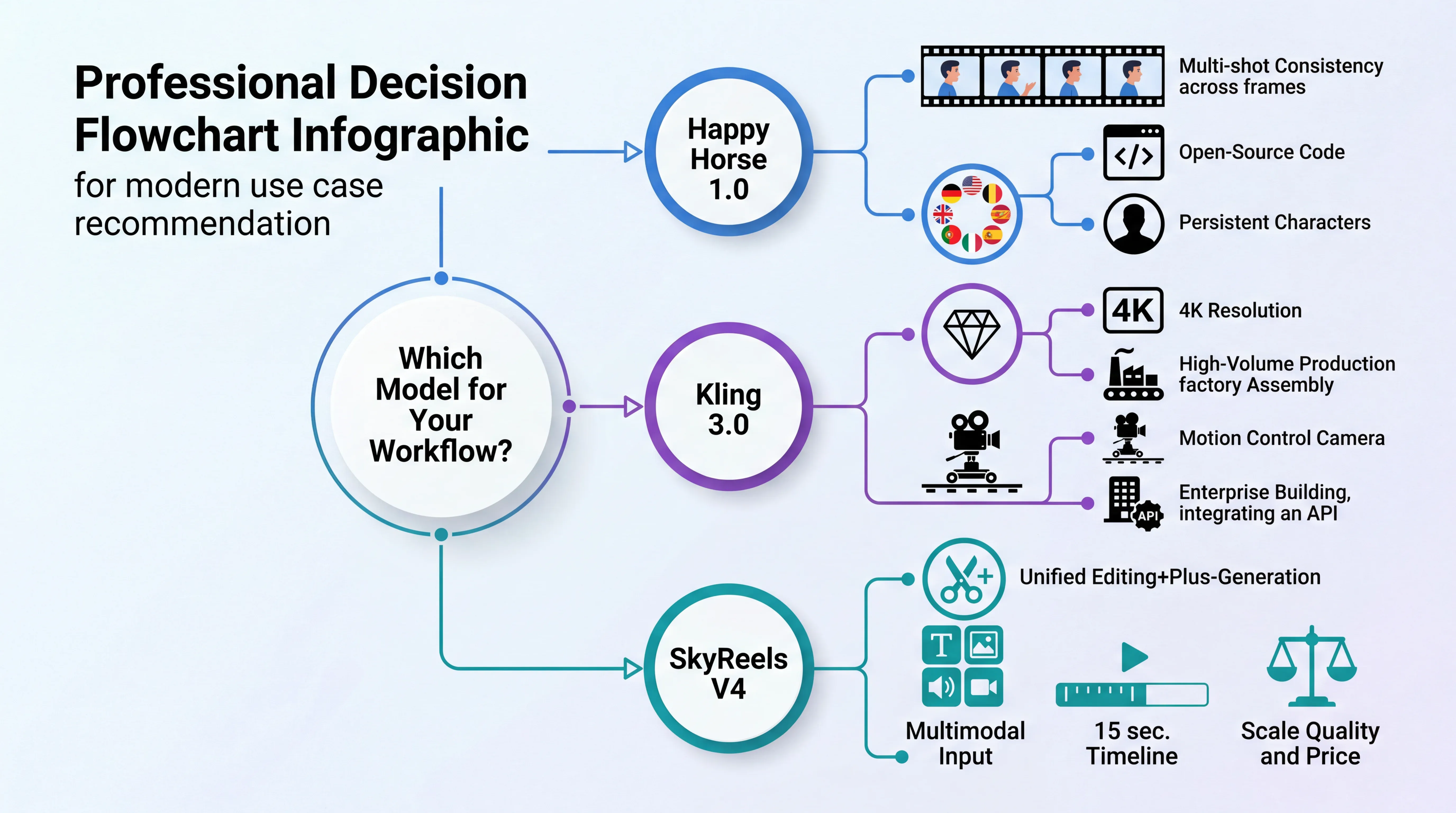

Empfehlungen nach Anwendungsfall: Welches Modell passt zu Ihrem Workflow?

Wählen Sie Happy Horse 1.0, wenn Sie Folgendes brauchen

Multi-Shot-Narrative mit stabilen Charakteren. Happy Horse 1.0 kann die Identität einer Figur über Szenenwechsel hinweg halten und eignet sich damit besonders für Kurzfilme, markengeführtes Storytelling und Bildungsserien, bei denen visuelle Kontinuität wichtiger ist als maximale Auflösung. Die native Multi-Shot-Generierung reduziert den manuellen Schnittaufwand deutlich.

Self-hosted Infrastruktur mit voller Modellkontrolle. Unternehmen mit Anforderungen an Datensouveränität, feine Anpassung visueller Stile oder On-Premise-Workflows profitieren stark vom Open-Source-Ansatz von Happy Horse 1.0. Die Möglichkeit, Architektur und Training anzupassen, ist mit reinen API-Diensten nicht erreichbar.

Mehrsprachige Inhalte mit synchronisiertem Dialog. Die sieben Sprachen mit Lip-Sync machen Happy Horse 1.0 zur stärksten Wahl für internationale Creator, Sprachlern-Apps und globale Marketingkampagnen, bei denen korrekte Mundsynchronität in mehreren Sprachen direkte Lokalisierungskosten spart.

Geduld bis zur API-Freigabe. Wenn Ihr Produktionszeitplan erst nach dem 30. April 2026 relevant wird und Sie auf offiziellen Zugang warten können, rechtfertigt die führende Qualität von Happy Horse 1.0 diese Verzögerung. Für unmittelbare Produktionsbedarfe bleiben Kling 3.0 und SkyReels V4 praktischer.

Wählen Sie Kling 3.0, wenn Sie Folgendes brauchen

Maximale Auflösung und Bewegungsschärfe. Sobald 4K bei 60fps nicht verhandelbar ist, etwa für professionelle Produktpräsentationen, High-End-Werbung, festivaltaugliche Kurzfilme oder alle Inhalte, bei denen visuelle Qualität direkt auf den Markenwert einzahlt, überwiegt Kling 3.0s nativer Auflösungsvorteil alle anderen Faktoren.

Produktion in großem Volumen. Marketingagenturen, die täglich viele Social Clips erzeugen, E-Commerce-Plattformen mit tausenden Produktvideos und Content-Studios mit wiederkehrenden Serien profitieren von Kling 3.0s Kosteneffizienz, API-Stabilität und Batch-Fähigkeit. Die Preisstruktur um 0,50 US-Dollar pro Clip macht große Stückzahlen wirtschaftlich realistisch.

Präzise Bewegungssteuerung und filmische Kontrolle. Regisseure und Kameraleute, die konkrete Kamerafahrten einsetzen, Bewegungsmuster über mehrere Einstellungen konsistent halten oder AI-generierten Content mit real gefilmtem Material kombinieren wollen, werden Kling 3.0s Motion-Control-Feature besonders schätzen. Diese Fähigkeit verbindet professionelle Filmtechnik mit generativer AI auf eine Weise, die andere Modelle derzeit nicht leisten.

Erprobte Produktionsinfrastruktur. Teams, die kundenseitige Anwendungen, SaaS-Produkte mit eingebetteter Videogenerierung oder automatisierte Content-Pipelines bauen, brauchen die operative Verlässlichkeit aus live verfügbarer API, umfassender Dokumentation und mehreren Provider-Optionen. Kling 3.0 hat sich hier als Infrastruktur etabliert, während Happy Horse 1.0 und SkyReels V4 diesen Reifegrad noch nicht vollständig erreicht haben.

Wählen Sie SkyReels V4, wenn Sie Folgendes brauchen

Vereinte Generierungs- und Editing-Workflows. Creator, die generierte Videos regelmäßig weiter verändern, etwa Hintergründe austauschen, Outfits wechseln, störende Elemente entfernen oder Szenen verlängern, profitieren enorm von SkyReels V4s integriertem Inpainting und Editing. Diese chirurgischen Änderungen im selben latenten Raum halten die visuelle Konsistenz besser als externe Editing-Tools.

Komplexe multimodale Steuerung. Projekte, die Textbeschreibungen, Referenzbilder, Videoclips, Masken und Audiohinweise kombinieren müssen, können SkyReels V4s reiche Eingabemodalitäten optimal nutzen. Das ist besonders relevant für markengeführte Inhalte mit strengen visuellen Vorgaben, charakterbasierte Narrative mit definierten Stimmen und technische Demos mit präziser Szenensteuerung.

Längere zusammenhängende Einstellungen. Mit maximal 15 Sekunden ist SkyReels V4 die stärkste Wahl für Erklärvideos, Tutorials, längere narrative Takes und alle Anwendungsfälle, bei denen häufige Schnitte die Verständlichkeit oder emotionale Wirkung stören würden.

Das beste Qualitäts-Preis-Verhältnis unter den zugänglichen Optionen. Für Teams, die nicht nur Generierung, sondern auch Editing- und Iterationskosten betrachten, führt SkyReels V4s Preis von etwa 7,20 US-Dollar pro Minute zusammen mit den integrierten Editing-Fähigkeiten oft zu geringeren Gesamtkosten als bei scheinbar günstigeren, aber rein generativen Diensten.

Performance-Benchmarks: Bewegungsqualität und Physiksimulation

Unabhängige Tests in realen Produktionsabläufen zeigen feine Unterschiede, die für bestimmte Use Cases wichtiger sein können als aggregierte Elo-Werte. Nach Bewertungen vom Februar 2026 erreicht Seedance 2.0 mit 9,2 von 10 die höchste Punktzahl für Bewegungsrealismus, dicht gefolgt von Kling 3.0 mit 9,0. Seedance ist besonders stark bei cineastischer Bewegungsweichheit, also jener subtilen Beschleunigungs- und Verzögerungskurve, die Kamerafahrten professionell wirken lässt. Kling 3.0 führt dagegen bei natürlicher Physiksimulation, vor allem bei Gravitation, Impuls und Materialverhalten wie Stoff oder Flüssigkeiten.

Happy Horse 1.0s Bewegungsqualität wurde indirekt durch Blindvergleiche bestätigt, in denen Nutzer die Outputs konsistent vor denen von Kling 3.0 und Seedance 2.0 einordneten, ohne zu wissen, welches Modell jeweils dahinterstand. Das legt nahe, dass Happy Horse 1.0 ein Bewegungsniveau erreicht, das sogar oberhalb dieser 9,0- bis 9,2-Benchmarkwerte liegen könnte, auch wenn eine numerische Bestätigung durch unabhängige Labore noch aussteht.

SkyReels V4 liegt mit seiner Bewegungsqualität ebenfalls klar in dieser Spitzengruppe. Mit Elo 1.244 liegt es einen Punkt über Kling 3.0 Pro. Auf diesem Niveau bestehen die Unterschiede nicht mehr in groben Fehlern, denn alle drei Modelle vermeiden die typischen frühen Probleme wie morphende Objekte, wandernde Gesichter oder klare Physikbrüche. Die Unterschiede stecken nun in Feinheiten: Wie natürlich verlagert eine Figur beim Drehen ihr Gewicht? Wie glaubwürdig fängt Wasser Licht ein? Wie reagiert Stofffalte auf Bewegung? Für High-End-Commercials sind diese Nuancen entscheidend, auf mobilen Social-Feeds fallen sie oft weniger auf.

Der Plattformvorteil von Happy Horse

Auch wenn sich dieser Vergleich auf das Modell Happy Horse 1.0 konzentriert, lohnt sich ein Blick auf den Plattformansatz von Happy Horse selbst. Er adressiert ein zentrales Problem in der AI-Videoproduktion: Tool-Fragmentierung. Statt Kling für 4K, Seedance für Motion und SkyReels für Editing getrennt zu abonnieren, bündelt Happy Horse mehrere führende Modelle in einem einzigen Workflow-Umfeld. Diese Konsolidierung bringt mehrere praktische Vorteile mit sich.

Erstens entfällt ein großer Teil des kognitiven Overheads, der entsteht, wenn man unterschiedliche Interfaces, Prompt-Syntaxen und Parameterlogiken lernen muss. Ein Creator kann denselben Prompt über Happy Horse 1.0, Kling 3.0 und SkyReels V4 schicken, ohne zwischen Plattformen zu springen, was schnelle Iteration und direkten Qualitätsvergleich ermöglicht. Zweitens vereinfacht sich die Kostensteuerung: ein Abo, eine Rechnung, kalkulierbarere Budgets statt verstreuter Verbrauchskosten über viele Services hinweg. Drittens ermöglicht dieser Ansatz ein gezieltes Routing nach Aufgabe: Kling 3.0 für den Hero-Shot in maximaler Auflösung, Happy Horse 1.0 für narrative Sequenzen mit Charakterkontinuität, SkyReels V4 für Szenen, die chirurgisches Editing erfordern.

Dieser Plattformansatz spiegelt eine breitere Branchenbewegung wider: die Aggregation von AI-Modellen. Genauso wie kein einzelnes Sprachmodell jeden Text-Use-Case dominiert, wird auch kein einzelnes Videomodell für jede kreative Herausforderung optimal sein. Die Zukunft professioneller AI-Videoproduktion dürfte in intelligentem Model Routing liegen, bei dem Systeme auf Basis von Promptanalyse, Budgetgrenzen und Qualitätszielen automatisch das passende Modell auswählen oder empfehlen. Happy Horse ist mit seinem integrierten Ansatz dafür gut positioniert.

Grenzen und Überlegungen, die für alle Modelle gelten

Trotz des beeindruckenden Fortschritts Anfang 2026 teilen alle drei Modelle weiterhin bestimmte Grenzen, die Creator kennen müssen, bevor sie produktive Workflows darauf aufbauen. Physiksimulation in komplexen Szenarien, darunter Feuerverhalten, Wasserdynamik mehrerer interagierender Ströme und reißende Stoffe, kann immer noch in visuell unplausible Ergebnisse kippen. Auch Multi-Character-Interaktionen, insbesondere Szenen mit drei oder mehr Figuren in koordinierten Bewegungen, erzeugen manchmal Artefakte wie sich überschneidende Gliedmaßen oder unstimmige räumliche Beziehungen.

Charakterkonsistenz über mehrere Videos hinweg bleibt ebenfalls ungelöst. Happy Horse 1.0 kann eine Figur innerhalb einer einzelnen Multi-Shot-Generierung stabil halten, und SkyReels V4 kann mit Referenzbildern die Erscheinung steuern, aber kein Modell liefert derzeit zuverlässig denselben Charakter über vollkommen getrennte Generierungssitzungen hinweg, ohne sorgfältiges Prompt Engineering und Referenzmanagement. Für Serienformate, wiederkehrende Markenfiguren und Kampagnen mit konstantem Cast ist das eine wichtige praktische Grenze.

Auch die urheberrechtliche Lage verdient Aufmerksamkeit. Im März 2026 lehnte der U.S. Supreme Court es ab, den Fall Thaler v. Perlmutter anzuhören, und ließ damit faktisch die Regelung bestehen, dass rein AI-generierte Inhalte nicht urheberrechtlich geschützt sind. Das bedeutet: Andere dürfen solche Videos rechtlich kopieren und verwenden, und man selbst kann kein vollständiges Copyright darauf geltend machen. Für Geschäftsmodelle, die auf Exklusivität setzen, entsteht daraus ein strategisches Risiko, das nur durch menschliche kreative Beteiligung, deutliche Postproduktion oder alternative Schutzmechanismen wie Marke und Trade Dress abgefedert werden kann.

Fazit: Die Zukunft der AI-Videoproduktion ist multimodell

Die Konkurrenz zwischen Happy Horse 1.0, Kling 3.0 und SkyReels V4 zeigt einen reifenden Markt, in dem Qualitätsabstände so weit geschrumpft sind, dass Workflow-Integration, Feature-Fit und Kostenstruktur oft wichtiger werden als rohe Benchmarkwerte. Happy Horse 1.0 führt bei Blindbewertungen und bietet unvergleichliche Open-Source-Flexibilität, aber bis Ende April 2026 noch keine produktionsreife API. Kling 3.0 liefert die höchste native Auflösung, die robusteste Infrastruktur und die kosteneffizienteste Lösung für hohe Produktionsmengen. SkyReels V4 bringt die reichhaltigste multimodale Eingabe, integriertes Editing und die längste Einzelclipdauer mit.

Für die meisten Teams besteht die optimale Strategie deshalb nicht darin, ein einziges Modell auszuwählen, sondern Workflows zu entwickeln, die die Stärken jedes Systems gezielt nutzen. Nutzen Sie Kling 3.0 für Hero-Shots und hochauflösende Endergebnisse. Setzen Sie Happy Horse 1.0 für narrative Sequenzen mit Charakterkontinuität ein, sobald die API verfügbar ist. Verwenden Sie SkyReels V4 für Inhalte, die chirurgisches Editing oder komplexe multimodale Konditionierung erfordern. Dieser Multi-Model-Ansatz, unterstützt durch Plattformen wie Happy Horse, die verschiedene Modelle in einer Oberfläche bündeln, ist der pragmatischste Weg in einem Markt, in dem keine einzelne Lösung jede Aufgabe dominiert.

Der Bereich AI-Video wird sich 2026 weiter rasant entwickeln. Benchmarks, die heute state of the art markieren, könnten bis Q3 2026 schon Mittelklasse sein. Die hier verglichenen Modelle werden neue Versionen veröffentlichen, neue Wettbewerber werden auftauchen, und architektonische Innovationen werden die Leistungshierarchie weiter verschieben. Konstant bleibt nur die Notwendigkeit, Werkzeuge passend zu konkreten kreativen Herausforderungen einzusetzen, den Workflow flexibel zu halten und Produktionszuverlässigkeit höher zu gewichten als reine Ranglistenplätze. Die Zukunft von AI-Video gehört nicht einem einzelnen Sieger, sondern einem Ökosystem spezialisierter Werkzeuge. Gewinnen werden jene, die lernen, sie sinnvoll zu orchestrieren.

Bereit, die Zukunft der AI-Videogenerierung selbst zu erleben? Besuchen Sie , um Happy Horse 1.0, Kling 3.0, SkyReels V4 und weitere führende Modelle in einer einheitlichen Plattform zu nutzen. Erstellen Sie noch heute Ihr erstes cinematisches Video mit integrierten Workflow-Tools und intelligentem Model Routing.